Материалы по тегу: ии

|

09.10.2024 [14:43], Руслан Авдеев

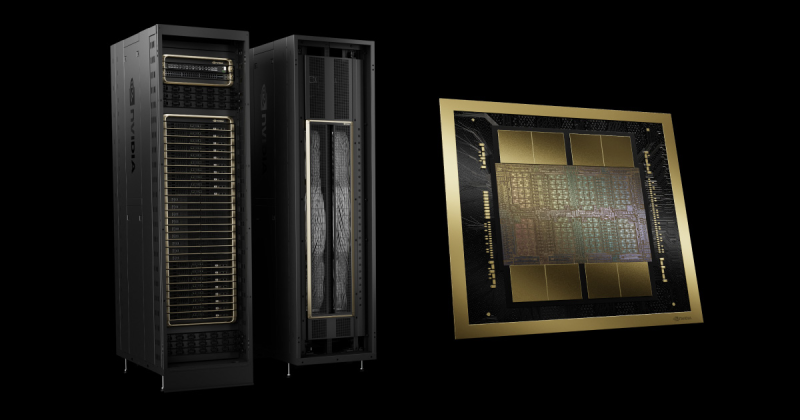

Foxconn и NVIDIA построят самый быстрый на Тайване ИИ-суперкомпьютерКомпании Foxconn и NVIDIA объединили усилия для постройки крупнейшего на Тайване суперкомпьютера. По данным пресс-службы NVIDIA, проект Hon Hai Kaohsiung Super Computing Center был представлен в ходе традиционного мероприятия Foxconn — Hon Hai Tech Day, прошедшего в минувший вторник. Вычислительные мощности будут построены на основе передовой архитектуры NVIDIA Blackwell — будет использована платформа GB200 NVL72, включающая 64 стойки. С ожидаемой производительностью ИИ-вычислений более 90 Эфлопс (FP4), машина может легко считаться самой быстрой на Тайване. Foxconn намерена использовать суперкомпьютер для исследований в области медицины, разработки больших языковых моделей (LLM) и инноваций в системах умного города. Это может сделать Тайвань одним из лидеров ИИ-индустрии. В рамках стратегии «трёх платформ» Foxconn уделяет внимание умному производству, умным городам и электрическому транспорту. Новый суперкомпьютер призван сыграть ключевую роль в поддержке инициатив компании по созданию «цифровых двойников», автоматизации робототехники и созданию умной городской инфраструктуры. Строительство уже началось в тайваньском муниципалитете Гаосюн, первая фаза должна заработать к середине 2025 года. Полностью работоспособным компьютер станет в 2026 году. Проект будет активно использовать технологии NVIDIA вроде робоплатформ NVIDIA Omniverse и Isaac для ИИ и «цифровых двойников». В Foxconn утверждают, что суперкомпьютер будет не только крупнейшим на Тайване, но и одним из самых производительных в мире. Каждая стойка GB200 NVL72 включает 36 CPU Grace и 72 ускорителя Blackwell, объединённых интерконнектом NVIDIA NVLink (суммарно 130 Тбайт/с). Технология NVIDIA NVLink Switch позволит системе из 72 ускорителей функционировать как единый вычислительный модуль — оптимальный вариант для обучения ИИ-моделей и инференса в режиме реального времени, с моделями на триллион параметров. Предполагается использование решений NVIDIA DGX Cloud Infrastructure и Spectrum-X для поддержки масштабируемого обучения ИИ-моделей. Тайваньская Foxconn (официально Hon Hai Precision Industry Co.) — крупнейший в мире производитель электроники, известный выпуском самых разных устройств, от смартфонов до серверов для популярных во всём мире заказчиков. Компания уже имеет производства по всему миру и является ключевым игроком в мировой технологической инфраструктуре. При этом производитель считается одним из лидеров в организации «умного» производства, внедряющим промышленные ИИ-системы и занимающимся цифровизацией заводов с помощью NVIDIA Omniverse Cloud. Кроме того, именно она одной из первых стала пользоваться микросервисами NVIDIA NIM в разработке языковых моделей, интегрированных во многие внутренние системы и процессы на предприятиях, создании умных электромобилей и инфраструктуры умных городов. Суперкомпьютер Hon Hai Kaohsiung Super Computing Center — лишь часть растущей общемировой сети передовых проектов на основе решений NVIDIA. Сеть включает несколько значимых проектов в Европе и Азии. Сотрудничество компаний становится всё теснее. В ходе того же мероприятия объявлено о сотрудничестве Foxconn и NVIDIA в Мексике. Первая построит завод в стране для упаковки полупроводников NVIDIA.

09.10.2024 [09:54], Сергей Карасёв

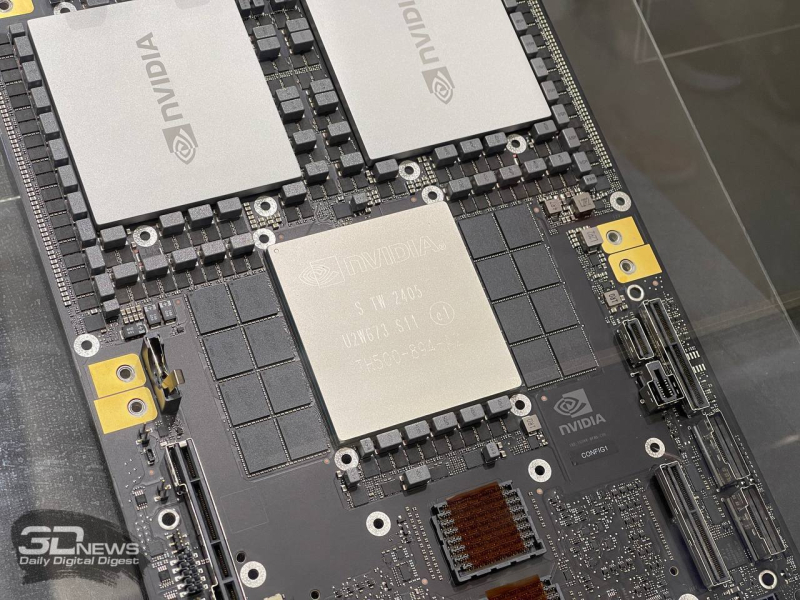

Фото дня: ИИ-система с NVIDIA GB200 и огромным радиатором для облака Microsoft AzureКорпорация Microsoft опубликовала в социальной сети Х фото новой ИИ-системы на базе ускорителей NVIDIA GB200 для облачной платформы Azure. Вычислительная стойка запечатлена рядом с блоком распределения охлаждающей жидкости (CDU), который является частью СЖО. Как отмечает ресурс ServeTheHome, вычислительная стойка содержит восемь узлов на основе GB200 с архитектурой Blackwell, а также ряд других компонентов. Точная конфигурация системы не раскрывается. На фотографии видно, что CDU-блок, расположенный по правую сторону от вычислительной стойки, имеет вдвое большую ширину. Он содержит крупноразмерный теплообменник жидкость — воздух, по сути, представляющий собой аналог автомобильного радиатора. Можно видеть насосы, элементы подсистемы питания, а также средства мониторинга. Наблюдатели отмечают, что обычно теплообменники шириной в две стойки предназначены для нескольких вычислительных стоек. Поэтому не исключено, что запечатленные на снимке изделия являются частью более крупной системы, где показанный CDU-блок будет отвечать за охлаждение сразу нескольких вычислительных стоек с ускорителями NVIDIA GB200. Напомним, ранее у Microsoft и NVIDIA возникли разногласия по поводу использования решений B200. NVIDIA настаивает на том, чтобы клиенты приобретали эти изделия в составе полноценных серверных стоек, тогда как Microsoft хочет использовать вариант стоек OCP с целью унификации инфраструктуры своих многочисленных дата-центров. Недавно также стало известно, что NVIDIA отказалась от выпуска двухстоечных суперускорителей GB200 NVL36×2 в пользу одностоечных вариантов NVL72 и NVL36. Причём Microsoft отдала предпочтение именно NVL72: корпорация начнёт получать эти системы в декабре.

09.10.2024 [09:49], Руслан Авдеев

Foxconn и NVIDIA построят крупнейший в мире завод по выпуску суперчипов GB200 в МексикеКомпания Foxconn построит в Мексике крупнейший в мире завод по упаковке суперчипов GB200 компании NVIDIA — ключевого продукта нового семейства Blackwell. По данным Reuters, Foxconn стал одним из главных выгодоприобретателей от бума ИИ, поскольку компания уже собирает серверы для систем искусственного интеллекта. По словам представителя Foxconn, речь действительно идёт о крупнейшем заводе по упаковке GB200 на планете. В мексиканском правительстве сообщили, что завод построят в городе Гвадалахара. В августе NVIDIA сообщала о начале поставок образцов чипов Blackwell партнёрам и клиентам, в период до января она рассчитывает уже заработать на новейших полупроводниках несколько миллиардов долларов. В Foxconn уверены, что сотрудничество компании с NVIDIA имеет важнейшее значение, поскольку спрос на новую платформу «ужасно огромный».

Источник изображения: Sergio Rodríguez/unsplash.com Foxconn уже активно развивает производство в Мексике и инвестировала более $500 млн в штате Чиуауа. В компании утверждают, что цепочка поставок компании уже готова к ИИ-революции и производственные возможности включают выпуск передовых систем жидкостного охлаждения и теплоотвода, необходимых для оснащения серверов с GB200. Утверждается, что в текущем квартале компания обеспечила сильные показатели. В минувшую субботу Foxconn отчиталась о рекордной выручке в III квартале — на фоне сильного спроса на ИИ-серверы. Ещё одним приоритетом Foxconn являются амбициозные планы диверсификации бизнеса. В компании не желают, чтобы она ассоциировалась исключительно со сборкой электроники для Apple и надеются использовать технологические наработки для контрактного производства других продуктов, в т.ч. электромобилей и даже собственных машин под брендом Foxconn. Также известно, что на днях Foxconn и NVIDIA объявили о совместном строительстве самого быстрого ИИ-суперкомпьютера на Тайване с использованием платформы GB200 NVL72.

08.10.2024 [12:36], Сергей Карасёв

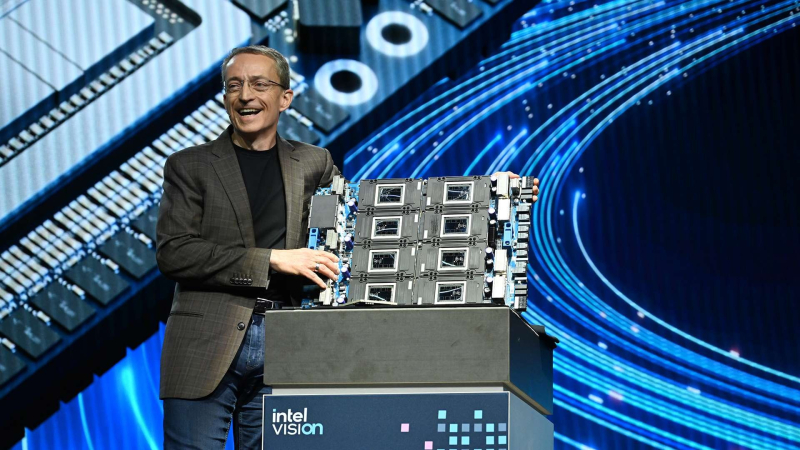

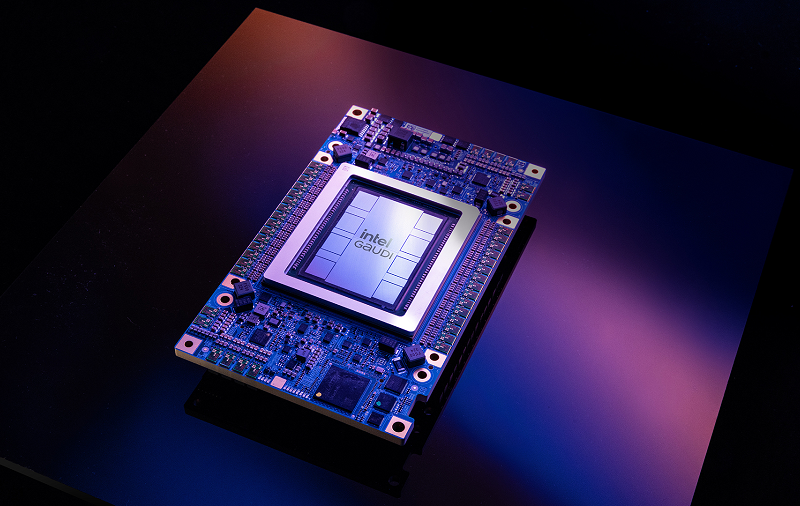

Inflection AI и Intel представили ИИ-систему на базе Gaudi3Стартап Inflection AI и корпорация Intel объявили о сотрудничестве с целью ускорения внедрения ИИ в корпоративном секторе. В рамках партнёрства состоялся анонс Inflection for Enterprise — первой в отрасли ИИ-системы корпоративного класса на базе ускорителей Intel Gaudi3 и облака Intel Tiber AI Cloud (AI Cloud). Inflection AI основана в 2022 году Мустафой Сулейманом (Mustafa Suleyman), одним из основателей Google DeepMind, а также Ридом Хоффманом (Reid Hoffman), одним из учредителей LinkedIn. Стартап специализируется на технологиях генеративного ИИ. В середине 2023 года Inflection AI получила на развитие $1,3 млрд: в число инвесторов вошли Microsoft и NVIDIA. Inflection for Enterprise объединяет Gaudi3 с большой языковой моделью (LLM) Inflection 3.0. Утверждается, что это ПО при использовании на аппаратной платформе Intel демонстрирует вдвое более высокую экономическую эффективность по сравнению с некоторыми конкурирующими изделиями. Заказчики получат LLM, настроенную в соответствии с их пожеланиями. Для удовлетворения потребностей каждого конкретного клиента применяется обучение с подкреплением на основе отзывов людей (RLHF). При этом используются данные, предоставленные самим заказчиком.

Источник изображения: Intel Отмечается, что облако AI Cloud упрощает создание, тестирование и развёртывание ИИ-приложений в единой среде, ускоряя время выхода продуктов на рынок. Тонко настроенные ИИ-модели доступны исключительно клиенту и не передаются в третьи руки. На первом этапе системы Inflection for Enterprise будут предлагаться через облако AI Cloud. В I квартале 2025 года планируется организовать поставки программно-аппаратных комплексов.

07.10.2024 [15:24], Андрей Крупин

«Лаборатория Касперского» первой в России прошла сертификацию процессов безопасной разработки«Лаборатория Касперского» сообщила о получении сертификата ФСТЭК России, подтверждающего соответствие процессов безопасной разработки программного обеспечения требованиям ГОСТ Р 56939 «Защита информации. Разработка безопасного программного обеспечения. Общие требования», Антивирусный вендор стал первым и единственным на сегодняшний день разработчиком в России, прошедшим данную сертификацию. Сертификация процессов безопасной разработки начала действовать в РФ 1 июня 2024 года — она предполагает проверку регулирующим органом соответствия ГОСТ не только на уровне отдельного ПО, но и на уровне организации. Первым аккредитованным и пока единственным органом по сертификации в данной области является Институт системного программирования им. В. П. Иванникова Российской академии наук (ИСП РАН). Требование соответствию ГОСТ Р 56939 уже включается во все проводимые заказчиками тендеры, оно прописано в документах всех значимых отраслей, таких как банковская сфера, КИИ, транспорт, медицина.

Источник изображения: kaspersky.ru «"Лаборатория Касперского" начала внедрять практики безопасной разработки задолго до того, как стали предъявлять те или иные требования по этой части регуляторы и заказчики. Мы первыми поддержали ФСТЭК России, когда требования ГОСТ 2016 года стали обязательными к выполнению при сертификации продуктов. Мы вошли в рабочую группу с ИСП РАН и испытательной лабораторией НТЦ "Фобос-НТ", апробировали новые инструменты и подходы, на практике показали, что документ выполним. Но жизнь менялась, с каждым годом запрос на безопасность растёт, и пришла пора актуализировать ГОСТ, что мы и сделали в инициативном порядке. Поэтому мы особенно гордимся тем, что первыми в отрасли получили сертификат соответствия», — прокомментировала Карина Нападовская, руководитель центра сертификации и соответствия стандартам в «Лаборатории Касперского». В планах «Лаборатории Касперского» на ближайшие месяцы — разработка стандартов, сопутствующих ГОСТ Р 56939, таких как «Руководство по внедрению процессов разработки безопасного ПО» и «Методика оценки реализации процессов разработки безопасного ПО».

07.10.2024 [15:16], Руслан Авдеев

Intel может почти на треть сократить поставки ИИ-ускорителей Gaudi 3 в 2025 годуКомпания Intel борется за выживание на рынке ИИ-решений и в конце сентября официально представила свой новейший ускоритель — 5-нм Gaudi 3. Однако по данным аналитического агентства TrendForce, IT-гигант сократил планы поставок соответствующих чипов более чем на 30 % в 2025 году. Это может повлиять на бизнес-партнёров компании из цепочки поставок на Тайване. Агентство ссылается на отчёт Economic Daily News. В нём указывается, что новые меры могут быть связаны с изменением внутренней политики Intel и спроса, что побудило компанию сократить заказы на Тайване. После снижения объёмов выпуска место IT-гиганта на фабриках TSMC займут другие клиенты. То же касается и ASE, а также её дочерней SPIL, оказывающих Intel услуги по упаковке и тестированию микросхем. Для Alchip, проектирующей специализированные ASIC для Intel Gaudi 2 и Gaudi 3, ситуация может оказаться более сложной. Unimicron, которая считается главным поставщиком подложек для чипов Intel, тоже довольно сильно зависит от объёмов заказов последней. Но в Unimicron сохраняют оптимизм, поскольку рассчитывают, что во II половине 2024 года спрос на ИИ-ускорители и оптические модули вырастет. Отраслевые источники сообщают, что изначально в 2025 году планировалось отгрузить 300–350 тыс. ускорителей Gaudi 3, но теперь речь идёт лишь о 200–250 тыс. По имеющимся данным, после покупки израильского производителя Habana Labs в 2019 году, Intel, вероятно, весьма прохладно относится к идее совместной разработки ИИ-ускорителей нового поколения со сторонними компаниями. Более того, она ускоренно сворачивает выпуск Gaudi 2. Новость об изменениях структуры производства компании отнюдь не первая в 2024 году. В мае сообщалось, что Intel отказалась от ускорителей Ponte Vecchio в пользу Gaudi и Falcon Shores. Позже появились предположения о том, что создание Falcon Shores будет свёрнуто в рамках плана по выводу компании из кризиса, но Intel поспешила развеять сомнения, сообщив, что эту серию ускорителей всё же выпустят. Вероятно и то, что в них интегрируют элементы Gaudi.

07.10.2024 [12:43], Руслан Авдеев

Техас заставит операторов ЦОД строить собственные электростанцииТехасский регулятор Public Utility Commission начал предупреждать операторов дата-центров о необходимости самостоятельно снабжать свои объекты электричеством, хотя бы частично. По данным The Register, бизнесу предлагается не пристраивать ЦОД к электростанциям, а возводить новую электростанцию одновременно с дата-центром. Представители комиссии считают, что выдача разрешений на строительство в текущей ситуации угрожает дефицитом энергии, поскольку операторы дата-центров готовы скупить всё. Техас и без того страдал от недостатка электричества в отдельные моменты новейшей истории, поэтому заявляется, что изъять ресурсы для дата-центров из общих сетей — непозволительная роскошь, особенно в долгосрочной перспективе. Многие гиперскейлеры и без того активно участвуют в энергопроектах. Например, AWS в марте согласилась потратить $650 млн на кампус ЦОД в Пенсильвании, подключенный к АЭС Susquehanna. Constellation Energy намерена заново ввести в эксплуатацию АЭС Three Mile Island для продажи энергии Microsoft. Google и Oracle тоже изучают вопрос использования АЭС или SMR для питания будущих гигаваттных дата-центров. Представители техасских властей уже заявили, что желающие подключиться к местным энергосетям операторы в ближайшие 12–15 месяцев должны будут сами поставлять некоторое количество энергии. По их мнению, IT-гиганты могут позволить себе строительство новых электростанций. А излишки энергии, если таковые будут, от этих станций можно передавать в сети общего пользования. Многие операторы рассматривают в качестве альтернативы обычным станциям малые модульные реакторы (SMR) вроде разработок NuScale. Но, хотя соответствующих проектов немало, некоторые эксперты допускают, что такие реакторы вообще не заработают — из-за высокой цены и массы технических недостатков, мешающих им заменить решения на ископаемом топливе даже в теории. Во всяком случае, в коммерческой эксплуатации их пока нет. В то же время AWS, например, рассматривала использование природного газа для электроснабжения некоторых ЦОД в Орегоне. На ирландском рынке ЦОД, где энергии тоже не хватает, Microsoft использует природный газ для питания нескольких дата-центров. Правда, по информации самой Microsoft, электростанция мощностью 170 МВт будет использовать 22 газовых генератора только временами, когда не справляется национальная энергосеть. В прошлый четверг Министерство энергетики США также анонсировало вложение $1,5 млрд в четыре проекта энергопередачи, которые увеличат ёмкость американских сетей на 7,1 ГВт, что повысит надёжность местных энергетических сетей и, в частности, позволит подключить пока что изолированную энергосеть Техаса (ERCOT) к национальным магистралям.

07.10.2024 [12:19], Сергей Карасёв

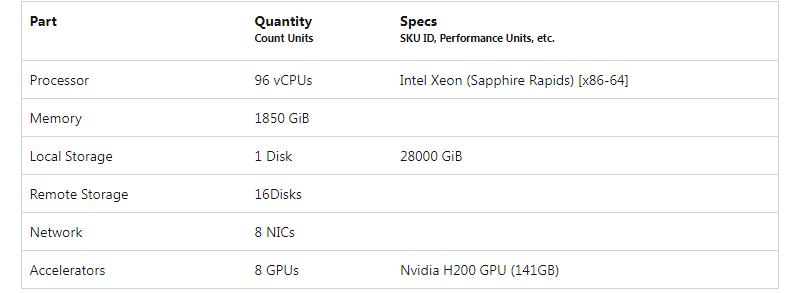

В облаке Microsoft Azure появились инстансы ND H200 v5 на базе NVIDIA H200В августе 2023 года Microsoft развернула в своём облаке Azure инстансы ND H100 v5 на базе NVIDIA H100 для HPC-вычислений и нагрузок ИИ. А теперь запущены машины ND H200 v5 с ускорителями NVIDIA H200, оптимизированные для инференса и обучения больших языковых моделей (LLM). Новые инстансы объединяют восемь ускорителей NVIDIA H200, каждый из которых содержит 141 Гбайт памяти HBM3e с пропускной способностью 4,8 Тбайт/с. По сравнению с NVIDIA H100 объём памяти увеличился на 76 %, пропускная способность — на 43 %. Для ND H200 v5 предусмотрена возможность масштабирования до тысяч ускорителей при помощи интерконнекта на базе NVIDIA Quantum-2 CX7 InfiniBand с пропускной способностью до 400 Гбит/с в расчёте на ускоритель (до 3,2 Тбит/с на виртуальную машину). В составе инстансов задействованы чипы Intel Xeon поколения Sapphire Rapids: каждая виртуальная машина насчитывает 96 vCPU. Объём памяти составляет 1850 Гбайт, вместимость локального хранилища — 28 000 Гбайт. Обеспечивается доступ к 16 облачным накопителям. Кроме того, используются восемь сетевых адаптеров (суммарно до 80 Гбит/c).

Источник изображения: Microsoft Виртуальные машины ND H200 v5 имеют предварительную интеграцию с Azure Batch, Azure Kubernetes Service, Azure OpenAI Service и Azure Machine Learning. Говорится, что инстансы обеспечивают высокую производительность при решении различных задач, связанных с ИИ, машинным обучением и аналитикой данных.

06.10.2024 [22:58], Владимир Мироненко

Cosmos для ИИ: VAST Data сформировала сообщество ИИ-специалистов, к которому уже присоединились NVIDIA, xAI, Supermicro, Cisco и др.Компания VAST Data, специализирующаяся на разработке инфраструктуры для ИИ, объявила о создании Cosmos — онлайн-сообщества, предназначенного для объединения ИИ-специалистов из разных отраслей. Учитывая стремительный темп изменений на рынке ИИ, оставаться в курсе последних достижений может быть непростой задачей, отметила VAST Data, добавив, что компании спешат внедрить ИИ, чтобы трансформировать свою деятельность. При этом ИИ-специалисты сталкиваются со сложными проблемами, требующими постоянного обучения и адаптации. VAST Data сообщила, что сообщество Cosmos предоставит специалистам по ИИ возможность общаться, делиться передовым опытом и имеющимися знаниями. Благодаря обсуждениям в реальном времени, практическим занятиям и библиотеке ресурсов Cosmos поможет компаниями добиться успеха в их проектах по развитию ИИ, независимо от их сложности. В качестве платформы для общения выбран Discord. Для обучения предлагаются практические лаборатории Cosmos Lab, где будет возможность ознакомиться с реальными примерами работы над ИИ под руководством экспертов, которые понимают аспекты развёртывания таких решений. Лаборатории призваны помочь специалистам углубить свои навыки в интерактивной среде. Центральным узлом сообщества станет форум Discourse. Это будет место для объёмного контента, включая подробные статьи, обмен знаниями, календари событий и презентации поставщиков. «Именно здесь Cosmos превращается в нечто большее, чем просто чат — это библиотека знаний, созданная сообществом для сообщества», — отметила VAST Data. VAST Data также уточнила, что Cosmos предназначено не только для тех, кто уже является экспертом: «Независимо от того, возглавляете ли вы команду ИИ, являетесь ли вы студентом, интересующимся тем, как ИИ повлияет на вашу будущую карьеру, или только начинаете развёртывать свою первую модель, Cosmos предлагает пространство, где вы можете учиться, сотрудничать и расти». Соучредитель VAST Data Джефф Денворт (Jeff Denworth) сообщил ресурсу The Register, что одной из моделей функционирования нового сообщества является организация Open Compute Project, занимающаяся разработкой оборудования и лучших практик с помощью совместных усилий организаций-членов, выкладывающих свои решения в open source. Ещё один ориентир для Cosmos — Конференция RSA (RSA Conference), на которой обсуждаются технологии современной защиты информационных систем, проблемы безопасности, тенденции развития сетевых угроз и вредоносных программ и т.д. Денворт также сообщил, что был разработан кодекс поведения участника и начался набор экспертов для руководства контентными треками. На должность менеджера сообщества назначен Джонас Росланд (Jonas Rosland), занимавший должности менеджера сообщества в VMware, CIQ и Dell EMC. К сообществу уже присоединились NVIDIA, xAI, Supermicro, Deloitte, WWT, Cisco, CoreWeave, Core42, NEA, Impetus, Run:AI и Dremio. Параллельно VAST Data объявила о новом сотрудничестве с NVIDIA, Cisco и Equinix, пишет ресурс Blocks and Files. На прошедшей неделе VAST Data представила решение VAST InsightEngine with NVIDIA для безопасного получения, обработки и извлечения всех корпоративных данных (файлов, объектов, таблиц и потоков) в режиме реального времени. В нём VAST Data интегрировала своё ИИ-хранилище и обработку данных с ускорителями NVIDIA и микросервисами NIM. Теперь ускорители могут напрямую работать с данными в массивах VAST, а микросервисы NIM работают непосредственно внутри программной среды VAST. В свою очередь, Cisco в рамках сотрудничества с VAST Data планирует предлагать ПО VAST Data Platform на некоторых серверах UCS в качестве готовой интегрированной системы. Серверы Cisco UCS с ПО VAST Data и Cisco Nexus HyperFabric AI будут доступны в I половине 2025 года. А Equinix, которая уже предлагает оборудование Dell, NetApp, PureStorage и Seagate (Lyve Cloud) в 26 объектах IBX, планирует добавить платформу VAST для систем NVIDIA DGX, включая SuperPOD, а также платформу NVIDIA AI Enterprise. Сотрудничество с NVIDIA, Cisco и Equinix позволит VAST Data расширить возможности поставок своего продукта на рынки различных стран.

05.10.2024 [15:55], Сергей Карасёв

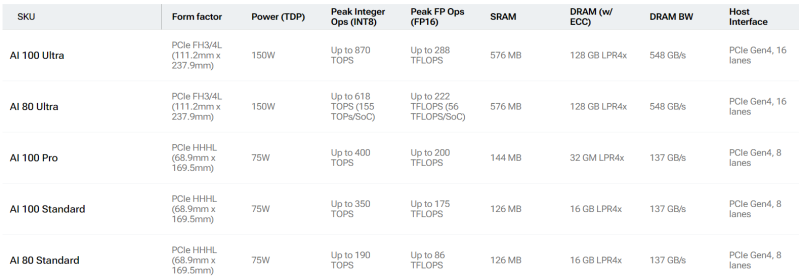

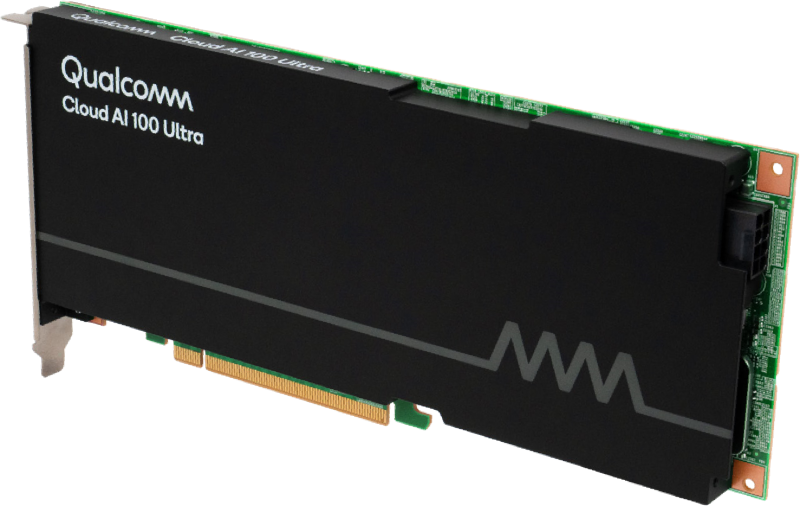

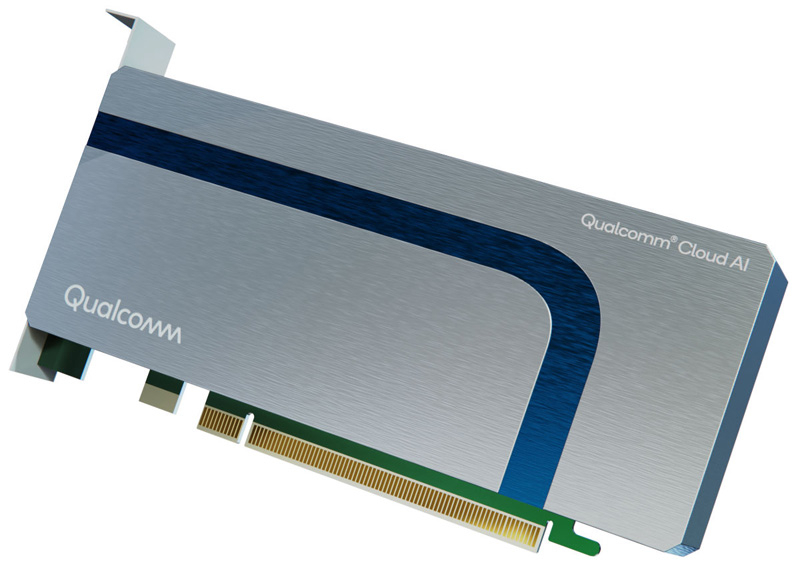

Qualcomm готовит «урезанные» ИИ-ускорители Cloud AI 80Qualcomm, по сообщению Phoronix, планирует выпустить ускорители Cloud AI 80 (AIC080) для ИИ-задач. Информация о них появилась на сайте самого разработчика, а также в драйверах Linux. Речь идёт об «урезанных» версиях изделий Cloud AI 100, уже доступных на рынке. Базовая версия Cloud AI 100 Standard выполнена в виде HHHL-карты (68,9 × 169,5 мм) с интерфейсом PCIe 4.0 х8 и пассивным охлаждением. Объём памяти LPDDR4x-2133 с пропускной способностью 137 Гбайт/с составляет 16 Гбайт. Есть также 126 Мбайт памяти SRAM. TDP равен 75 Вт. Заявленное быстродействие достигает 350 TOPS на операциях INT8 и 175 Тфлопс при вычислениях FP16. От них в своё время отказалась Meta✴, сославшись на сырость программной экосистемы и предпочтя разработать собственные ИИ-ускорители MTIA.

Источник изображений: Qualcomm Кроме того, существует решение Cloud AI 100 Ultra в виде карты FH3/4L (111,2 × 237,9 мм). Для обмена данными служит интерфейс PCIe 4.0 х16; значение TDP равно 150 Вт. В оснащение входят 128 Гбайт памяти LPDDR4x, пропускная способность которой достигает 548 Гбайт/с. Объём памяти SRAM — 576 Мбайт. INT8-производительность составляет до 870 TOPS, FP16 — до 288 Тфлопс. Сообщается, что к выпуску готовятся «урезанные» ускорители Cloud AI 80 Standard и Cloud AI 80 Ultra. Их характеристики в точности соответствуют таковым у Cloud AI 100 Standard и Cloud AI 100 Ultra. Отличия заключаются исключительно в пониженном быстродействии. Так, у Cloud AI 80 Standard производительность INT8 находится на уровне 190 TOPS, FP16 — 86 Тфлопс. У Cloud AI 80 Ultra значения равны 618 TOPS и 222 Тфлопс. Нужно отметить, что в старшее семейство также входит модель Cloud AI 100 Pro в формате карты HHHL с интерфейсом PCIe 4.0 х8 и TDP 75 Вт. Она несёт на борту 32 Гбайт памяти LPDDR4x (137 Гбайт/с) и 144 Мбайт памяти SRAM. Производительность INT8 составляет до 400 TOPS, FP16 — до 200 Тфлопс. Появится ли подобная модификация в серии Cloud AI 80, пока не ясно. |

|