Материалы по тегу: облако

|

29.07.2025 [22:26], Андрей Крупин

Selectel запустил хранилище S3 Vault — облачное решение для резервного копирования S3-бакетовПровайдер IT-инфраструктуры Selectel объявил о запуске хранилища S3 Vault — облачного решения для резервного копирования S3-бакетов (buckets) с полным контролем доступа. Сервис может представлять интерес для крупного бизнеса с высокими требованиями к сохранности и безопасности данных, поскольку хранилище изолировано и недоступно из контура организации. Это обеспечивает защиту хранящихся в S3 Vault копий от случайного удаления, сбоев и вредоносных воздействий. Решение построено на базе платформ Airflow и Kubernetes, что позволяет гибко управлять задачами резервного копирования. Доступ к данным строго ограничен и предоставляется только по запросу, что минимизирует риск компрометации. Такой подход особенно актуален для компаний, работающих с критически важной информацией, например, с персональными и платёжным данными.

Источник изображений: Selectel Для работы с большими объёмами данных в системе S3 Vault реализованы механизмы параллельной обработки и организации очерёдности задач. Это предотвращает перегрузку каналов и поддерживает стабильную производительность даже при интенсивной нагрузке. «Перед бизнесом остро стоит проблема защиты данных — особенно сегодня, в условиях участившихся кибератак. S3 Vault создаёт независимый защищённый контур для хранения резервных копий. Это позволяет компаниям не просто подстраховаться на случай сбоев, но и обеспечить бесперебойную работу ключевых IT-систем и непрерывность бизнес-процессов. Для нас это стратегически важный продукт, отвечающий актуальным потребностям рынка в надёжном хранении и восстановлении данных», — отмечает Ярослав Павлов, менеджер продукта в Selectel.

28.07.2025 [15:04], Руслан Авдеев

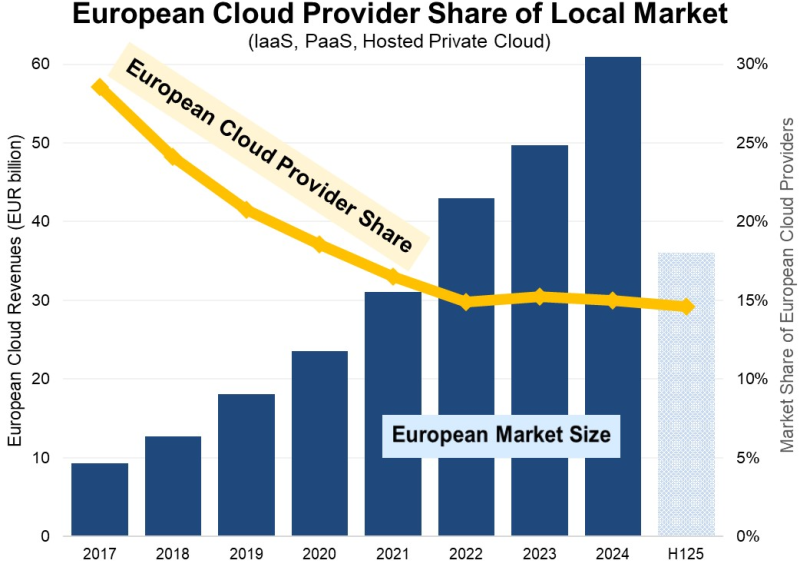

Доля европейских облачных провайдеров на местном рынке снизилась до 15 % и остаётся на этом уровне годамиКак свидетельствуют новые данные Synergy Research Group, европейские операторы облачных сервисов с 2017 по 2024 годы увеличили свои местные доходы более чем втрое. Правда, за тот же период облачный рынок вырос более чем в шесть раз, составив в 2024 году €61 млрд ($70 млрд), сообщает пресс-служба компании. При этом доля европейских облачных провайдеров на местном рынке снизилась с 29 % в 2017 году до 15 % в 2022 году, и с тех пор сохраняется на одном уровне. Основными бенефициарами стали Amazon (AWS), Microsoft и Google — на эту тройку приходится 70 % рынка региона. Среди европейских провайдеров лидируют SAP и Deutsche Telekom, но на каждого из них приходится лишь по 2 % европейского рынка. Определённую роль играют и OVHCloud, Telecom Italia, Orange, а также многочисленные игроки национального и регионального масштабов. Оставшаяся часть европейского рынка приходится на мелких облачных провайдеров из США и Азии. Как утверждают в Synergy, выручка от облачной инфраструктуры (включая IaaS, PaaS и хостинг частных облаков) в I полугодии текущего года составила €36 млрд, а за весь год она вырастет год к году на 24 %. Большая часть рынка приходится на IaaS- и PaaS-сервисы, и они растут быстрее, чем сегмент частных облаков. Драйвером рынка становится искусственный интеллект (ИИ) — рост генеративных сервисов на основе ИИ, вроде GPUaaS и GenAI PaaS, составляет 140–160 %.

Источник изображения: Synergy Research Group По статистике Synergy, крупнейшими облачными рынками в регионе являются Великобритания и Германия, но только сейчас крупнейшими рынками с самыми высокими темпами роста названы Ирландия, Испания и Италия. По словам представителя Synergy Research, на рынке облачных услуг начинающим игрокам приходится делать огромные финансовые ставки, иметь долгосрочное видение инвестиционной политики и грядущих прибылей, а также всё время совершенствовать бизнес. При этом ни одна европейская компания не соответствует этим критериям, и на рынке предсказуемо доминируют американские компании. Они ежеквартально вкладывают в европейские программы капиталовложения порядка €10 млрд — конкурировать с ними местному бизнесу буквально невозможно. В результате европейские облачные поставщики в основном обслуживают локальные группы клиентов с специфическими для региона потребностями, иногда взаимодействуя с крупными американскими провайдерами. Хотя многие европейские поставщики облачных услуг, вероятно, продолжат расти, вряд ли они смогут существенно изменить положение дел на облачном рынке. В конце мая эксперты заявили, что европейским пользователям отказаться от американских облаков сегодня уже практически невозможно. Более того, в июне SAP заявила, что не видит смысла в строительстве Европой собственной облачной инфраструктуры. Между тем, тотальное доминирование американского бизнеса в Европе грозит местным облачным провайдерам серьёзными проблемами. Так, в мае 2025 года сообщалось, что Microsoft всё ещё не создала продукта, удовлетворяющего требованиям соглашения с ассоциацией европейских облачных провайдеров CISPE. В рамках действующей под эгидой CISPE инициативы было решено, что относительно действий компании всё ещё «существуют опасения, хотя предложены меры для исправления». Кроме того, в июле Microsoft признала, что не может гарантировать суверенитет данных в Европе. Наконец, CISPE подала иск в Европейский суд общей юрисдикции, утверждая, что Еврокомиссия не выдвинула никаких условий, мешающих Broadcom злоупотреблять доминирующим положением на рынке. CISPE заявляет, что доминирование ПО VMware на рынке виртуализации означает, что обновление условий лицензирования затронут практически всех европейских облачных операторов и их пользователей. Год назад CISPE прямо заявила, что новая лицензионная политика Broadcom грозит банкротством небольшим облачным провайдерам.

27.07.2025 [23:55], Владимир Мироненко

Microsoft признала, что не может гарантировать суверенитет данных в Европе

aws

microsoft

microsoft azure

software

гиперскейлер

европа

евросоюз

закон

информационная безопасность

конфиденциальность

облако

сша

франция

Microsoft «не может гарантировать» суверенитет данных клиентам во Франции, и, как следствие, всему Европейскому союзу, если администрация Трампа потребует доступ к информации о клиентах, хранящейся на её серверах, пишет The Register. Об этом сообщил, выступая перед Сенатом Франции в рамках расследования государственных закупок и их роли в обеспечении цифрового суверенитета Европы, Антон Карньо (Anton Carniaux), директор по связям с общественностью и правовым вопросам французского отделения Microsoft. Согласно Акту о законном использовании данных за рубежом (The Cloud Act), правительство США наделено правом получать цифровые данные, хранящиеся у американских технологических корпораций, причём в независимости от того, хранятся ли эти данные на серверах внутри страны или за рубежом, и даже если эти данные принадлежат не гражданам США. Отвечая на вопрос о технических или юридических механизмах, которые могли бы помешать такому доступу в соответствии с The Cloud Act, Карньо заявил, что компания «имеет договорное обязательство перед своими клиентами, включая клиентов государственного сектора, отклонять эти запросы, если они необоснованны». Ранее Microsoft заверила, что работа облачных сервисов в ЕС будут контролироваться местным советом директоров и действовать в соответствии с местным законодательством. Карньо подчеркнул, что правительство не может делать запросы, которые не имеют чёткого определения — если такие запросы поступают, компания просит о возможности уведомить об этом соответствующего клиента. Карньо также спросили, может ли он, как представитель руководства Microsoft, в случае юридически обоснованного судебного запрета «гарантировать нашему комитету под присягой», что данные французских граждан не будут переданы американскому правительству без явного согласия французского правительства. «Нет, — сказал Карньо, — я не могу этого гарантировать, но, опять же, такого никогда раньше не случалось». Марк Буст (Mark Boost), генеральный директор облачного провайдера Civo, заявил: «Одна строка показаний только что подтвердила, что американские гиперскейлеры не могут гарантировать суверенитет данных в Европе». По его словам, Microsoft открыто признала то, что многим давно известно: согласно законам вроде The Cloud Act власти США могут принудительно запрашивать доступ к данным, хранящимся у американских провайдеров облачных услуг, независимо от того, где эти данные физически хранятся. «Это больше, чем просто формальность. Это реальная проблема, которая может повлиять на национальную безопасность, конфиденциальность персональных данных и конкурентоспособность бизнеса», — заявил Марк Буст. Параллельно на этой неделе AWS пояснила некоторые моменты реализации требований The Cloud Act в связи с ростом числа «запросов о том, как мы обрабатываем запросы государственных органов на предоставление данных». AWS утверждает, что закон не предоставляет правительству США «беспрепятственный или автоматический доступ к данным, хранящимся в облаке». The Cloud Act позволил США заключать взаимные исполнительные соглашения с доверенными иностранными партнёрами с целью получения доступа к электронным доказательствам для расследования тяжких преступлений, где бы эти доказательства ни находились, устранив препятствия, предусмотренные законодательством США. «Согласно законодательству США, провайдерам фактически запрещено раскрывать данные правительству США при отсутствии предусмотренного законом исключения», — сообщила AWS. — «Чтобы обязать провайдера раскрыть данные, правоохранительные органы должны убедить независимого федерального судью в наличии причины, связанной с конкретным преступлением, и в том, что доказательства преступления будут обнаружены там, где должен быть произведён обыск». AWS заявила, что до этого момента не раскрывала данные корпоративных или государственных клиентов в соответствии с законом The Cloud Act. По словам AWS, принципы закона «соответствуют международному праву и законам других стран»; и закон «не ограничивает технические меры и операционные средства контроля, которые AWS предлагает клиентам для предотвращения несанкционированного доступа к их данным». И последний аргумент AWS, который явно направлен против европейских конкурентов, пытающихся воспользоваться движением за суверенитет данных, заключается в том, что The Cloud Act распространяется не только на компании с головным офисом в США, но и на всех «поставщиков услуг электронной связи или удалённых вычислений», ведущих бизнес в США. То есть поставщики облачных услуг со штаб-квартирой в Европе, ведущие деятельность в США, также подпадают под его действие. Microsoft, AWS и Google пытаются заверить обеспокоенных клиентов в ЕС в том, что они смогут обеспечить суверенитет данных при не совсем дружелюбной позиции США по отношению к странам, некогда считавшимся близкими союзниками. Несмотря на это, в ЕС наблюдается тенденция на создание суверенной инфраструктуры, отметил The Register, хотя не все поддерживают эту идею. Более того, многие в Европе смирились с тем, что без американских облаков уже не обойтись. Согласно данным Synergy Research Group, доля локальных игроков на облачном рынке Европы замерла на уровне 15 %. При этом часть из них ещё и попала в зависимость от новой политики Broadcom в отношении VMware.

26.07.2025 [14:55], Сергей Карасёв

В Европе запущена первая метаоблачная ИИ-платформа Fact8raКомпания OpenNebula Systems объявила о запуске Fact8ra — это, как утверждается, первая в Европе платформа «ИИ как услуга» (AI-as-a-Service) на основе мультиоблачной архитектуры. Инициатива является важным этапом на пути формирования европейской суверенной инфраструктуры ИИ. Любопытно, что в Китае создаётся похожая платформа, но по совсем иным причинам — в результате не слишком удачного планирования значительная часть вычислительных мощностей простаивает без дела. Система Fact8ra предлагает многопользовательскую среду для развёртывания частных экземпляров больших языковых моделей (LLM) с открытым исходным кодом. Платформа объединяет НРС-мощности, публичное облако и периферийные ресурсы по всему ЕС. Fact8ra основана на суверенном облачном стеке ИИ, включающем решения OpenNebula, а также другие европейские технологии open source, такие как openSUSE и MariaDB. Поначалу Fact8ra объединит GPU-серверы в восьми странах ЕС: Франции, Германии, Италии, Латвии, Нидерландах, Польше, Испании и Швеции. Отмечается, что Fact8ra способна агрегировать ресурсы поставщиков публичных облачных сервисов, периферийных площадок, суперкомпьютерных центров и финансируемых ЕС фабрик ИИ. В частности, будут объединены мощности Arsys, CloudFerro, IONOS, Leaseweb, OVHcloud, Scaleway, StackScale и Tiscali. Говорится о расширенной поддержке ИИ-ускорителей NVIDIA. Fact8ra поддерживает работу с различными LLM, включая Mistral Nemo 12B, EuroLLM 9B, Salamandra 7B и Italia 9B. Кроме того, реализована интеграция с внешними каталогами ИИ-моделей, в том числе Hugging Face. Поначалу пользователям будут доступны возможности инференса, а затем появятся функции тонкой настройки и обучения моделей ИИ. Fact8ra реализуется как часть программы IPCEI-CIS (Important Project of Common European Interest on Next Generation Cloud Infrastructure and Services) — это европейский проект развития облачной инфраструктуры и услуг следующего поколения. Инициатива стоимостью €3 млрд была одобрена Европейской комиссией в декабре 2023 года. Проект поддерживается 12 государствами-членами ЕС и более чем 120 индустриальными партнёрами. Целями являются стимулирование исследований и увеличение инвестиций в технологии периферийных и облачных вычислений в ЕС, а также создание децентрализованной периферийной инфраструктуры. Ранее в рамках IPCEI-CIS была анонсирована суверенная облачная платформа Virt8ra.

26.07.2025 [14:46], Руслан Авдеев

Внеплановая экономика: Китай создаст мета✴облако для продажи избыточных вычислительных мощностейКНР принимает меры по формированию сети продаж вычислительных мощностей и сдерживания неконтролируемого развития рынка ЦОД. Дело в том, что тысячи поддерживаемых местными властями дата-центров, уже построенных в Китае, привели к переизбытку предложения, сообщает Reuters. Государственные органы проводят оценку соответствующего рынка в общенациональном масштабе после трёхлетнего бума строительства дата-центров. По словам одного из представителей органов местной власти, Пекин также намерен создать общегосударственный облачный сервис для использования «лишних» вычислительных мощностей. Так, Министерство промышленности и информационных технологий взаимодействует с тремя государственными телеком-компаниями Китая для разработки способов объединения ЦОД в рамках единой платформы для продаж незадействованных вычислительных мощностей. В гонке с США за лидерство в ИИ-секторе неиспользуемые мощности и финансово нестабильные ЦОД — значимая проблема Пекина, способная помешать претворению в жизнь его амбиций. По словам местных исследователей и чиновников, к 2028 году Китай намерен стандартизировать доступ к вычислительным мощностям в стране, но некоторые эксперты сулят плану технические проблемы. Бум строительства ЦОД в Китае начался в 2022 году, после запуска амбициозного проекта «Восточные данные, Западные вычисления» (Eastern Data, Western Computing), в рамках которого планировалось построить множество ЦОД в западных регионах КНР, где стоимость энергии ниже, для обработки данных восточных регионов, где сосредоточена основная экономическая деятельность страны. В июне было заявлено, что на сегодня лицензии выданы не менее 7 тыс. вычислительных центров. Согласно анализу Reuters государственных закупок, в прошлом году инвестиции Китая в эту сферу выросли на порядок — с ¥2,4 млрд юаней в 2023 году до ¥24,7 млрд ($3,4 млрд). В текущем году в эти ЦОД уже инвестировано ¥12,4 млрд юаней, большая часть из них находится в Синьцзяне. Возможно, это связано с проектом гигантского комплекса ИИ ЦОД для 115 тыс. ускорителей NVIDIA. Тем не менее, если в 2023 году отменили лишь 11 проектов строительства ЦОД, то за последние 18 месяцев таковых стало более сотни — местные власти обеспокоены окупаемостью инвестиций. По данным источников Reuters, уровень загрузки построенных ЦОД крайне низок, порядка 20–30 %. Некоторые эксперты уже заявили, что инвесторы и местные власти, ожидающие заказы от правительства и госкомпаний, строят ЦОД без учёта реальных потребностей рынка. При этом идея строительства на западе страны изначально лишена экономического обоснования, поскольку снижение расходов идёт рука об руку со снижением производительности и доступности. Ранее уже сообщалось, что многочисленные и наспех построенные дата-центры в западных регионах попросту оказались невостребованными. Проблема и в архитектуре ЦОД, и в их удалённости. В рамках проекта Eastern Data, Western Computing планировалось добиться задержки 20 мс к 2025 году — это пороговое значение, необходимое для приложений вроде сверхбыстрой алгоритмической торговли и других сервисов в финансовом секторе. Тем не менее, многие объекты до сих пор не соответствуют этому стандарту, а аренда каналов связи восток–запад всё ещё очень дорога. Фактически многие предприятия предпочитают хранить данные в дата-центрах на западе, но не обрабатывать их там. Кроме того, построенные ИИ ЦОД опираются как на ускорители NVIDIA, так и на локальные альтернативы вроде Huawei Ascend, что усложняет интеграцию различных полупроводников, требующих разного аппаратного и программного обеспечения, что затрудняет создание единого облачного сервиса. Тем не менее, власти оптимистичны и рассчитывают преодолеть эти различия — по их словам, пользователям нового сервиса достаточно будет указать свои требования вроде необходимого объёма вычислений и пропускной способности сети. Для регулирования развития сектора ЦОД комиссия NDRC, занимающаяся планированием в Китае, в начале года инициировала ужесточение контроля за новыми проектами дата-центров, строительство которых запланировано после 20 марта. Кроме того, местным органам власти запретили участвовать в мелких проектах по созданию вычислительной инфраструктуры. Предположительно, NDRC желает предотвратить нерациональное использование ресурсов, устанавливая пороговые требования — вроде наличия соглашения о покупке запланированных мощностей и минимального уровня загрузки. Таким образом предполагается отсеять «мусорные» проекты.

24.07.2025 [16:38], Владимир Мироненко

Выручка Google Cloud выросла на треть — Alphabet увеличит капзатраты до $85 млрд на фоне высокого спроса на ИИХолдинг Alphabet, включающий компанию Google, объявил финансовые результаты II квартала 2025 года, закончившегося 30 июня. Согласно пресс-релизу, консолидированная выручка Alphabet выросла в отчётном квартале на 14 % в годовом исчислении до $96,4 млрд, отражая устойчивую динамику во всем бизнесе. Это выше консенсус-прогноза аналитиков, опрошенных LSEG, в размере $94 млрд или 10,9 % увеличения. Чистая прибыль увеличилась на 19 % до $28,2 млрд, а прибыль на акцию — на 22 % до $2,31, что тоже выше прогноза от LSEG в размере $2,18 на акцию. Выручка облачного подразделения Google Cloud увеличилась на 32 % до $13,62 млрд, главным образом за счёт роста доходов Google Cloud Platform (GCP) по основным продуктам GCP, ИИ-инфраструктуре и решениям для генеративного ИИ, при прогнозе аналитиков StreetAccount в размере $13,11 млрд. На прошлой неделе OpenAI объявила о начале использования ресурсов Google Cloud для поддержки ChatGPT. «Мы очень рады сотрудничеству», — отметил генеральный директор Alphabet Сундар Пичаи (Sundar Pichai) в ходе квартального отчёта. Стремительный рост Google Cloud и сделка с OpenAI — ещё одно свидетельство того, что предприятия наконец-то осознают преимущества TPU Google, заявил Хольгер Мюллер (Holger Mueller) из Constellation Research ресурсу SiliconANGLE. «Кроме того, Google Cloud на год опережает конкурентов в плане работы с мультимодальными моделями, что во многих случаях способствует созданию более качественной и дешёвой ИИ-инфраструктуры», — отметил аналитик, добавив, что это обеспечивает Google значительное преимущество в гонке за ИИ в облаке. Аналитик Forrester Research Ли Сустар (Lee Sustar) назвал впечатляющим рост Google Cloud за последние несколько лет. По его словам, то, что когда-то считалось второстепенным направлением, приносящим одни убытки, превратилось во всё более значимый источник доходаL «ИИ — важная, но не единственная причина этого роста. Google Cloud систематически наращивает вычислительные мощности для крупных предприятий, выходя за рамки привычных решений для обработки данных, аналитики и ИИ». Он также указал на тот факт, что операционная рентабельность Google Cloud выросла за квартал вдвое до примерно 20 %, т.е. бизнес может расти, не сжигая всю выручку. Компания получает прибыль от своих огромных инвестиций в ИИ. «Эра облачных технологий, разработанных специально для ИИ, уже наступила, и это заметно по показателям Google Cloud», — сказал Сустар. В ходе телефонной конференции с аналитиками финансовый директор Alphabet Анат Ашкенази (Anat Ashkenazi) заявила, что рост выручки обусловлен растущим спросом на облачные продукты и услуги, добавив, что в 2026 финансовом году, вероятно, потребуются дополнительные расходы. «Учитывая высокий и растущий спрос на наши облачные продукты и услуги, мы увеличиваем наши капитальные вложения в 2025 году примерно до $85 млрд», — сообщается в отчёте Alphabet. Напомним, что в феврале Alphabet объявил, что в этом году выделит на капзатраты $75 млрд по сравнению с $52,5 млрд в прошлом году. Холдинг отметил, что выручка от Google Services увеличилась на 12 % до $82,5 млрд, отражая высокие показатели поисковика, подписок, платформ и устройств Google, а также рекламы в YouTube. Выручка холдинга от YouTube составила $9,8 млрд, что немного выше прогноза StreetAccount в размере $9,56 млрд. Сундар Пичаи сообщил, что у бота AI Overviews, обобщающего результаты поиска, теперь более 2 млрд пользователей в более чем 200 странах, по сравнению с 1,5 млрд пользователей в конце предыдущего квартала. А Gemini теперь насчитывает более 450 млн активных пользователей. Добавление AI Overviews в Google Search может быть одной из причин, по которой этот бизнес продолжает демонстрировать силу, отметил SiliconANGLE. Выручка поисковика за квартал составила более $54,19 млрд, что составляет значительную часть от общей выручки от рекламы в размере $71,34 млрд, превысившей прошлогодний показатель на 10,5 %. Хольгер Мюллер отметил, что эти результаты, похоже, развеяли все опасения по поводу того, что генеративный ИИ может повлиять на доминирование Google в поиске, по крайней мере, на данный момент. Холдинг не предоставил прогноз на III финансовый квартал, но Ашкенази сообщила, что выручка Alphabet в текущем квартале может «снизиться» по нескольким причинам, включая падение доходов от рекламы, которая выиграла от «значительных расходов на выборы в США» в конце 2024 года, особенно на платформе YouTube.

22.07.2025 [17:54], Владимир Мироненко

Всё своё, от «железа» до ПО: «Группа Астра» и YADRO строят полностью российское облако«Группа Астра» в сотрудничестве с YADRO строит на базе российских решений альтернативу западным облачным платформам, которая позволит российским компаниям ускорить переход на цифровые сервисы. YADRO выступает ключевым партнёром в масштабном развитии облачной инфраструктуры Astra Cloud, в основе которой лежат её серверы, СХД и сетевые решения. В частности, в инфраструктуре Astra Cloud используются серверы VEGMAN R220 G2, СХД корпоративного уровня TATLIN.UNIFIED GEN2, а также сетевые коммутаторы KORNFELD производства YADRO. В дальнейшем в рамках проекта может быть расширен спектр используемых аппаратных решений YADRO. В частности, планируется тестирование сценариев использования TATLIN.OBJECT и TATLIN.BACKUP.

Источник изображения: «Группа Астра» В рамках совместного проекта будет установлено 300 серверов VEGMAN, две СХД и 38 коммутаторов с последующим расширением инфраструктуры до тысяч серверов в ближайшие годы по мере развития сервиса. Первый этап проекта планируется завершить в III квартале 2025 года. Благодаря реализации проекта становятся более доступными в инфраструктуре Astra Cloud такие продукты «Группы Астра», как почтовый сервер RuPost, корпоративное файловое хранилище Astra Disk, платформа виртуализации рабочих мест Termidesk и другие сервисы. Astra Cloud ориентируется как на бизнес, так государственный сектор, гарантируя соответствие регуляторным требованиям, говорит компания. В зависимости от потребностей заказчиков Astra Cloud обеспечивает развёртывание изолированной и аттестованной моделей, включая возможность создания выделенных инсталляций. Сотрудничество со стратегическим партнёром создаёт прочную основу для предоставления программных решений «Группы Астра» по подписочной модели — в полностью отечественном облаке, говорит «Астра Облако». «Вместе мы создаём рынок, на котором заказчики могут быть уверены: всё, от оборудования до ПО и сервисов, разрабатывается и поддерживается в России. Такой подход позволяет клиентам строить как локальные инфраструктуры, так и надёжные облачные сервисы на единой технологической базе, сохраняя высокий уровень производительности и безопасности», — отмечает YADRO.

22.07.2025 [10:01], Владимир Мироненко

«Яндекс» купила 50 % SolidSoft, чтобы создать с ней СПYandex B2B Tech объявила о создании с SolidSoft, одним из крупнейших российских разработчиков межсетевых экранов для защиты веб-приложений (WAF, Web Application Firewall), совместного предприятия, которое будет развивать решения для обеспечения кибербезопасности, в частности, инструменты для защиты бизнесом своих веб-приложений от атак и других современных угроз. «Яндекс» и SolidSoft будут участвовать в СП в равных долях, для чего «Яндекс» приобретает 50 % SolidSoft с возможностью увеличения своей доли в будущем. Сумма сделки не разглашается. По оценке Apple Hills Digital, сообщает Forbes, стоимость SolidSoft может составлять 3–4 млрд руб., следовательно, стоимость сделки может оцениваться в 1,5–2 млрд руб. Возглавят СП основатели SolidSoft. Сделка не отразится на действующих соглашениях SolidSoft с клиентами и партнёрами, а также на её дальнейших планах по разработке собственных решений. По данным Rusprofile, выручка «Солидсофт» в 2024 году составила 903 млн руб. (рост — 46 %), чистая прибыль — 635 млн руб. (рост — 68 %). Сообщается, что сделка позволит Yandex Cloud усилить информационную безопасность, которая является одним из самых востребованных направлений на платформе. За 2024 год потребление сервисов ИБ в Yandex Cloud выросло в 2,1 раза. По оценке Yandex B2B Tech, в прошлом году объём российского рынка решений для защиты веб-приложений составлял более 30 млрд руб. В рамках сделки компании буду использовать опыт и технологии друг друга и развивать свои продукты в синергии. Сообщается, что они объединят возможности межсетевого экрана SolidWall WAF и Smart Web Security — сервиса Yandex Cloud, который защищает от DDoS-атак и ботов, для более надёжной комплексной защиты. Также СП будет использовать для усиления механизмов защиты ИИ-технологии. Решения СП будут доступны как в облаке, так и по модели on-premises. У ряда продуктов Yandex Cloud уже есть on-premise-версии: СУБД YDB, сервис для работы с генеративными моделями Foundation Models, речевые технологии Yandex SpeechKit, а также BI‑инструмент DataLens.

21.07.2025 [16:35], Андрей Крупин

MWS Cloud запустила платформу хранения больших данных для обучения ИИКомпания MWS Cloud (входит в МТС Web Services) сообщила о запуске MWS Data Lakehouse — cloud-native-платформы для хранения и обработки данных. MWS Data Lakehouse позволяет работать с любыми типами данных — структурированными, неструктурированными и векторными, что даёт возможность создания единой среды для выполнения разного типа задач: от построения аналитических отчётов до обучения и инференса ML-моделей и LLM. В качестве инфраструктуры для развёртывания платформы могут использоваться различные решения, среди которых Kubernetes и объектное S3-совместимое хранилище. Поддерживается взаимодействие с СУБД Greenplum и Postgres. В MWS Data Lakehouse также встроены инструменты централизации контроля доступа, аудита и шифрования, динамического маскирования чувствительных данных, которые полностью соответствуют современным требованиям информационной безопасности.

Источник изображения: Luke Peters / unsplash.com В числе особенностей MWS Data Lakehouse — поддержка широкого спектра данных (включая открытые форматы Apache Parquet и Iceberg) и возможность параллельного запуска нескольких вычислительных кластеров под разные продуктовые команды, приложения и типы запросов без дублирования данных и дополнительной репликации. Администрирование сервиса осуществляется через единый интерфейс, позволяющий централизованно управлять пользователями, кластерами и масштабированием. Поддерживается динамическое изменение ресурсов вычислительных кластеров. Платформа является частью комплекса сервисов MWS по работе с данными — MWS Data. Всего в него входят более 25 продуктов для хранения, обработки и трансформации данных, а также сервисы бизнес-аналитики и ИИ-агенты для работы с данными.

21.07.2025 [16:08], Руслан Авдеев

Samsung начал поиск альтернатив VMwareОсновные компании, входящие в Samsung Group, начали искать альтернативы VMware в связи со значительным ростом цен на продукты последней, причём ПО, похоже, будут дорожать и дальше, передаёт ETNews. Как сообщают источники издания, Samsung Electronics, Samsung Display и другие подразделения Samsung Group уже реализуют либо готовятся к реализации проектов по постепенному отказу от VMware. Так, Samsung Electronics рассматривает альтернативные варианты с прошлого года. При этом компания не намерена немедленно отказываться от продуктов, пока заключён контракт на закупку ПО на сумму ₩40 млрд (около $29 млн). Параллельно компания участвует в проектах по разработке open source ПО. Цель состоит в том, чтобы разработать облачную среду, избегая коммерческих инструментов вроде продуктов VMware. Привлечены специалисты по виртуализации и облачным технологиям. В 2026 году будут определены направление и масштаб внедрения новых продуктов. Samsung Electronics намерена самостоятельно создать частное облако. Для работы над ним привлекут как сотрудников самой Samsung, так и специализированные компании. Проект планируется завершить в течение года. Samsung Display также готовит проект снижения зависимости от VMware. Компании Samsung Group являются одними из крупнейших заказчиков VMware в Южной Корее. Однако смена политики VMware привела к росту цен, так что дочерние структуры Samsung Group посчитали затраты слишком высокими в сравнении с выгодами от использования VMware. В 2023 году VMware была куплена Broadcom, а в 2024-м компания повысила цены на свою продукцию. По мнению экспертов, в ближайшие два-три года цена может значительно увеличиться в сравнении с текущей. Уже есть примеры пятикратного роста стоимости лицензий и обслуживания. Утверждается, что цены будут формироваться в индивидуальном порядке. Кроме того, постоянно меняются условия сделок. Есть претензии и к политике продаж. Флагманский продукт VMware Cloud Foundation (VCF) включает ПО для виртуализации, сетевые решения и решения для хранения данных единым пакетом. При этом многим корейским компаниям нужны только продукты для виртуализации, а переплачивать за ненужные продукты они не хотят. По словам одного из источников, большинство крупных компаний, включая производственные и финансовые, ускорят движение к отказу от VMware. |

|