Материалы по тегу:

|

09.06.2026 [18:18], Владимир Мироненко

Oriole Networks и AMD успешно запустили ИИ-сеть на фотонных технологиях, но пока в лабораторных условияхБританский стартап Oriole Networks сообщил о запуске первой в мире масштабируемой ИИ-сети, основанной исключительно на фотонных технологиях, в лаборатории Scaling Inference Lab, финансируемой агентством ARIA. Система сочетает в себе сетевую платформу PRISM от Oriole с ускорителями AMD Instinct и процессорами AMD EPYC. Это первое применение технологии компании, более широкое распространение которой в отрасли запланировано на 2027 год. PRISM — это оптическая сетевая платформа (OCS) для ИИ-кластеров. PRISM полностью исключает необходимость в традиционных коммутаторах в ЦОД, заменяя их оптическими цепями с наносекундной коммутацией, что снижает энергопотребление ядра сети на 81 %. Благодаря возможности прямой передачи фотонов от чипа к чипу, время простоя GPU снижается с нынешних 60 % до менее чем 1 %. По словам компании, такой подход позволяет минимизировать потребность в охлаждении, тем самым резко сокращая потребление воды. Что также важно, PRISM не привязана к какому-либо одному производителю чипов, обеспечивая возможность достижения производительности на уровне всей системы без необходимости использования проприетарных стеков. Лаборатория Scaling Inference Lab представляет собой испытательный полигон стоимостью £50 млн ($68 млн), финансируемый правительством Великобритании через Агентство перспективных исследований и изобретений (ARIA) для решения проблем, связанных с узкими местами в крупномасштабной обработке ИИ-данных. ARIA было создано на основании парламентского акта и финансируется Министерством науки, инноваций и технологий Великобритании (DSIT). Лаборатория Scaling Inference Lab размещается на платформе CommonAI и предназначена для тестирования и оптимизации ИИ-систем в реальных условиях. Oriole сотрудничает с AMD более года. Компания, основанная в 2023 году на базе подразделения Университетского колледжа Лондона (University College London), заявила, что её технология прошла путь от исследований до производства всего за три года. «Год назад мы доказывали физику; сегодня мы доказываем бизнес. Наше сотрудничество с AMD перешло от концепции к внедрению системы на порядок большего размера, и данные подтверждают, что это уже приводит к быстрому росту производительности», — сообщил Джеймс Риган (James Regan), генеральный директор Oriole. Как отметил ресурс TNW, развёртывание сети на фотонных технологиях компанией Oriole реально, но оно ещё не работает в масштабе кластеров уровня Google, которая уже несколько лет использует оптические коммутаторы Apollo. Запуск в 2027 году определит, сможет ли PRISM пережить переход от лабораторных условий к производственным площадкам компаний. Именно на этом переходе терпят неудачу большинство стартапов, занимающихся разработкой оборудования. По данным SiliconANGLE, на сегодняшний день Oriole привлекла около $35 млн инвестиций, в последнем раунде — $22 млн. В число её инвесторов входят Plural UK Management, UCL Technology Fund, Clean Growth Fund, XTX Ventures и Dorilton Ventures.

09.06.2026 [14:31], Владимир Мироненко

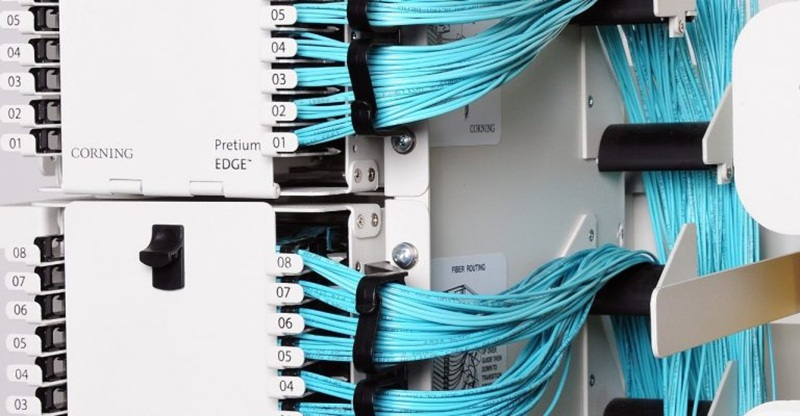

Amazon заключила многолетнее соглашение с Corning на поставку оптоволокна для своих ЦОДAmazon объявила о заключении многомиллиардного многолетнего соглашения с компанией Corning Incorporated о поставке оптического волокна, кабелей и решений для обеспечения связи, необходимых для расширяющейся инфраструктуры ЦОД AWS в США. Для Corning это третья крупная сделка в этом году с операторами ИИ ЦОД. Благодаря сделке будет создана 1 тыс. новых высококвалифицированных рабочих мест на производственных предприятиях Corning в Северной Каролине, а также сотни дополнительных рабочих мест в строительной сфере для расширения её предприятий. Кроме того, в рамках соглашения Amazon будет сотрудничать с Corning в реализации программы подготовки специалистов по волоконной оптике совместно с Общественным колледжем Катоба-Вэлли (Catawba Valley Community College). Вместе с тем сумма сделки и сроки её действия не раскрываются. Как отметил ресурс techblog.comsoc.org, в сетях ЦОД всё чаще используются архитектуры с высокой плотностью волокон, соответствующие топологиям типа Leaf-Spine и стандартам 400/800GbE, а также технологиям параллельных одномодовых волокон (PSM) и мультиплексирования (WDM). Сделка поможет Corning в строительстве завода по производству оптических кабелей в Хикори (Hickory, Северная Каролина), расширение которого, как ожидается, создаст около 1 тыс. рабочих мест. При этом Meta✴ станет для предприятия основным заказчиком. В мае NVIDIA выделила в рамках соглашения о долгосрочном партнёрстве $500 млн компании Corning на поддержку строительства трёх новых предприятий по производству оптического оборудования для ЦОД в Северной Каролине и Техасе. При выполнении определённых условий сумма сделки может быть увеличена до $3,2 млрд. Ожидается, что благодаря этим инвестициям производственные мощности Corning в США по выпуску оптического оборудования вырастут примерно в 10 раз, а внутреннее производство оптоволокна увеличится более чем на 50 %, ориентируясь на требования к интерконнектам ИИ-кластеров, характеризующихся большим количеством волокон и низкой задержкой и развивающимся экосистемам интегрированной оптики.  В январе Corning подписала соглашение с Meta✴, в рамках которого поставит до 2030 года оптоволоконные кабели для инфраструктуры ИИ ЦОД на сумму до $6 млрд. Ещё раньше, в сентябре 2025 года, Microsoft заключила соглашение с Corning и Heraeus по поводу производства полого волокна (HCF). HCF обеспечивает меньшую задержку и улучшенную производительность для чувствительных к задержке рабочих ИИ-нагрузок и передачи данных между ЦОД. До этого, в августе 2024 года, Corning и Lumen заключили соглашение о поставках волоконно-оптических кабелей следующего поколения для поддержки роста ИИ-трафика. Сделка отражает тот факт, что гиперскейлеры превращаются из потребителей оптических компонентов в активных участников развёртывания производства. Финансируя расширение мощностей, они обеспечивают себе преференции в доступе к компонентам. Это также позволяет им влиять на спецификации оптоволокна, планы развития производства и архитектуру развёртываний. Для телеком-операторов это может вылиться в ограничение доступа к поставкам в периоды дефицита в связи с приоритизацией поставок гиперскейлерам. Могут столкнуться с дефицитом и участники программы BEAD (Broadband Equity, Access, and Deploymentесли), поскольку спрос со стороны гиперскейлеров поглотит краткосрочный объём производства. Также гиперскейлеры могут диктовать направление внедрения инноваций в сторону их конкретных сценариев использования, потенциально не соответствуя традиционным потребностям сетей доступа, включая GPON, XGS-PON и новыми стандартами 25G/50G PON. Примером может служить полупроводниковая промышленность, где влияние гиперскейлеров уже изменило распределение мощностей заводов по производству чипов и приоритезацию передовых техпроцессов. Сейчас же гиперскейлеры фактически выступают в роли планировщиков оптической инфраструктуры следующего поколения. Более того, гиперскейлеры контролируют большинство международных подводных интернет-кабелей в мире, тесня традиционных операторов.

09.06.2026 [13:58], Руслан Авдеев

AMD поддержит суверенный ИИ в Великобритании, инвестировав в ИИ-отрасль страны £2 млрд

amd

dell

epyc

hardware

hpc

instinct

великобритания

ии

инвестиции

инференс

суперкомпьютер

финансы

фотоника

В следующие пять лет AMD рассчитывает инвестировать в усиление ИИ-экосистемы Великобритании до £2 млрд ($2,7 млрд), создав новую инфраструктуру, программы совместных исследований и подготовки кадров. По словам представителя техногиганта, новая стратегия согласуется с правительственным проектом AI Opportunities Action Plan и стратегией AI Hardware Strategy, с основным акцентом на суверенные ИИ-возможности, научные вычисления и передовые исследования, сообщает Converge! Digest. Ключевой компонент инициативы — расширение вычислительной ИИ-инфраструктуры. AMD и Dell Technologies поддерживают две новые суперкомпьютерные системы в Кембриджском университете. Суперкомпьютер Zenith AI, финансирование которого осуществляется Министерством науки, инноваций и технологий (DSIT) и структурой UK Research and Innovation (UKRI), строится как платформа для использования ИИ в науке. Система Sunrise создаётся совместно с Управлением по атомной энергии Великобритании для поддержки исследований в сфере термоядерных технологий. Оба суперкомпьютера будут использовать ускорители AMD Instinct, процессоры EPYC и ПО AMD для решения задач в сфере здравоохранения, климатологии, материаловедения, разработки научных ИИ-моделей и др. Также AMD анонсировала исследовательские партнёрства с Имперским колледжем Лондона и компанией Oriole Networks. В первом случае взаимодействие сосредоточено на вычислительных дисциплинах, здравоохранении, моделировании климата, ИИ-оптимизации, обработке значительных объёмов данных и др. В то же время AMD и Oriole Networks принимают участие в проекте Scaling Inference Lab британского агентства ARIA (Advanced Research and Invention Agency). Проект стоимостью £50 млн направлен на устранение ряда проблем современной ИИ-инфраструктуры. Он объединяет фотонную сетевую архитектуру PRISM компании Oriole, ускорители AMD Instinct, а также процессоры EPYC для оценки новых подходов к масштабированию задач ИИ-инференса с меньшей задержкой и повышенной энергоэффективностью.

Источник изображения: Robert Bye/unsplash.com По словам Converge!, лондонский стартап Oriole Networks намерен преодолеть традиционные ограничения классических ИИ-кластеров. Если в стандартных сетях на основе InfiniBand или Ethernet многократные преобразования оптического сигнала в электрический и обратно создают дополнительные задержки, то архитектура PRISM (Photonic Routing Infrastructure for Scalable Models) заменяет активные электронные коммутаторы «пассивным» оптическим ядром маршрутизации. Прямые оптические соединения узлов позволяют сократить время простоя GPU, связанное с ожиданием обмена данными, что мешает масштабным ИИ-нагрузкам. PRISM обеспечивает обработку динамического ИИ-трафика без использования электрических буферов пакетов данных. Многомерная коммутация каналов позволяет перенастраивать соединения в режиме реального времени и оптимизировать сеть под интенсивный обмен данными, характерный для больших языковых моделей. Кроме того, Oriole утверждает, что её технология позволяет объединять до миллиона оконечных устройств. В конечном счёте сокращение энергопотребления сетевого ядра может составить до 81 %. Ключевым элементом архитектуры PRISM является независимость от конкретного типа используемых процессоров и ускорителей. Вместо использования проприетарных интерконнектов, «привязывающих» операторов к определённой аппаратной платформе, Oriole разделяет транспортный и вычислительный уровни инфраструктуры. Компания заявляет, что её технологии интегрируются в существующие стеки ПО через стандартные драйверы PCIe и специализированные библиотеки ускорения вроде NCCL для NVIDIA или RCCL для AMD. Благодаря этому можно поддерживать разные аппаратные платформы без трансформации базовых ИИ-фреймворков. Будущее внедрение технологии в рамках ARIA Scaling Inference Lab станет значимой проверкой её жизнеспособности для отрасли и продемонстрирует, способны ли полностью фотонные сети гарантировать предсказуемую производительность и обеспечивать открытость проприетарных вычислительных систем в промышленных масштабах.

09.06.2026 [11:00], Руслан Авдеев

Сначала энергия: Google внедряет в Техасе бизнес-модель Power-First в ответ на дефицит электричества для ЦОДНа фоне того, что гиперскейлеры всё чаще сталкиваются с дефицитом электроэнергии для своих ЦОД, техасский кампус Google должен получить дата-центр с готовыми генерирующими мощностями в рамках бизнес-модели Power-First («сначала энергия»), сообщает Datacenter Knowledge. В гонке ИИ хороши все средства, и компании отходят от устаревшей модели ведения бизнеса, при которой новые нагрузки подключаются к энергосетям до того, как будут обеспечены новые генерирующие мощности. Google в своём ИИ-кампусе в Техасе рассчитывает обеспечить свой 1-ГВт ЦОД выделенной генерацией электроэнергии. Совместно с энергокомпанией Intersect реализуется план, при котором приоритет отдаётся созданию генерирующих мощностей параллельно со строительством вычислительной инфраструктуры. Инициатива появилась в критически важный момент — беспрецедентный дефицит электроэнергии испытывают энергокомпании и операторы ЦОД по всей территории США. На обновление линий электропередачи нередко уходят годы, а новые генерирующие объекты сталкиваются со сложностями при подключении к сетям даже при получении необходимых разрешений. Во многих регионах именно доступность электроэнергии определяет, где именно и когда гиперскейлеры смогут расширить свои мощности. Проблема столь серьёзна, что правительство США планирует выделить $700 млн на поддержку угольной энергетики для ИИ-инфраструктуры. По данным Google и Intersect, площадка Meitner Energy Center будет обеспечена от более 1 ГВт мощности от близлежащих новых ветровых и солнечных электростанций, а также аккумуляторных энергохранилищ в округах Грей и Робертс (Gray, Roberts). Компании заявили, что такая генерация поможет удовлетворить спрос ЦОД, снижая потребность в дополнительных поставках энергии из локальных электросетей. Наибольшая доля электроэнергии должна поступать из «чистых» источников, которые будут дополняться генераторами на самой площадке.

Источник изображения: Mick Haupt/unsplash.com Meitner — не первый проект ЦОД, взявший на вооружение модель Power-First. Google и Intersect ранее анонсировали совместное строительство в округе Хаскелл (Haskell, Техас), где объект Google возводится параллельно с так называемым Quantum Clean Energy Project компании Intersect — солнечной электростанцией мощностью 640 МВт, объединённой с аккумуляторным хранилищем ёмкостью 1,3 ГВт·ч. Энергетический проект должны ввести в эксплуатацию до конца текущего месяца, а строительство объекта Google уже ведётся. Оба проекта были анонсированы через считаные месяцы после того, как Google завершила сделку по покупке Intersect. Последняя специализируется на подключении к крупным промышленным потребителям генерирующих мощностей на основе «чистой» или газовой энергетики. Эти проекты демонстрируют стремление партнёров изменить подход к обеспечению дата-центров электроэнергией. Впрочем, вопрос о том, получит ли модель Power-First повсеместное распространение, остаётся открытым. Регулятор ERCOT (Electric Reliability Council of Texas) отказался комментировать детали, касающиеся проекта Meitner, но отметил ряд реформ в сфере присоединения к энергосетям крупных потребителей, а также наличие инициатив по планированию энергосистемы, сочетающих потребление больших объёмов электроэнергии с обязательной собственной генерацией. Ранее в этом месяце регулятор утвердил механизм Batch Zero, призванный упростить распределение пропускной способности электросетей для проектов с большими нагрузками. При этом даже объекты с собственной генерацией не могут полагаться исключительно на неё и требуют подключения к магистральным сетям и региональным системам обеспечения надёжности.

09.06.2026 [10:45], Руслан Авдеев

Как в «Безумном Максе»: Meta✴ строит в США «палаточные» ЦОД для ИИ-серверов на миллиарды долларовВместо традиционных капитальных зданий для своих ЦОД Meta✴ начала возводить в США «палатки», размещая в них чрезвычайно дорогое ИИ-оборудование. По некоторым данным, компания уже построила или находится в процессе строительства трёх дата-центров в рамках подобной концепции, уже вызвавшей ряд саркастических комментариев экспертов, сообщает Tom's Hardware. Площадка в Нью-Олбани (New Albany, Огайо) уже имеет пять зданий, на строительство которых ушло примерно 2–3 года. После этого компания решила сменить концепцию, начав устанавливать на территории пять тентов площадью более 11,6 тыс. м² каждый. Согласно местным муниципальным документам, работы стартовали в апреле 2026 года, а недавние спутниковые снимки показывают, что объекты фактически уже готовы. Технология доказала свою эффективность и сегодня применяется на двух площадках, включая одну в Теннесси. О стратегии установки «палаток» для размещения ИИ-оборудования глава Meta✴ Марк Цукерберг (Mark Zuckerberg) объявил ещё в 2025 году, вероятно, стремясь ускорить развёртывание инфраструктуры на фоне растущего спроса. Предполагается, что Meta✴ могла вдохновиться опытом xAI, построившей в 2024 году ЦОД на 100 тыс. ускорителей за 19 дней. Обычно на проекты подобного масштаба уходят годы, но в данном случае xAI задействовала помещения бывшего завода Electrolux.

Источник изображения: Cindy Chen/unsplash.com Размещение серверов «быстровозводимых структурах», которые в целом не совсем корректно называть обычными палатками — один из самых экзотических подходов к строительству ИИ-инфраструктуры. Они не так прочны, как конструкции из бетона и стали, и некоторые сравнивают такой подход с «защитой» гоночного велосипеда за $10 с помощью замка за $9. Тем не менее компания, вероятно, предварительно оценила связанные риски и сочла их приемлемыми по сравнению с потенциальными преимуществами в гонке ИИ. Ещё одним фактором, позволившим Meta✴ быстро развёртывать ЦОД, стала локальная генерация энергии «за счётчиком» с использованием собственных газовых турбин вместо подключения к магистральным электросетям. Примерно то же сделал Илон Маск (Elon Musk) с кластером Colossus в Мемфисе, изначально оснастив его газовыми генераторами, что вызвалов протесты активистов). Впрочем, в случае с Meta✴ речь идёт о постоянных установках на площадке в Огайо — она должна работать независимо от энергосетей. По имеющимся данным, сейчас ЦОД с собственной генерацией располагают приблизительно 2 ГВт энергетических мощностей, ещё 1 ГВт находится на подходе и станет доступен в текущем году. По информации Cleanview, если текущие проекты будут реализованы по графику, к концу 2027 года мощность подобных объектов может увеличиться до 13 ГВт. Сочетание временных (на первый взгляд) сооружений и генераторов на основе авиационных турбин выглядит довольно необычно и, как заявил один из журналистов, «напоминает сцену из фильма „Безумный Макс“». Стоит отметить, что Meta✴ буквально вынуждена ударными темпами строить собственную ИИ-инфраструктуру. В конце мая появилась новость, что Meta✴, возможно, сама начнёт предоставлять сторонним клиентам облачные сервисы, особенно, если у неё появятся избыточные мощности.

09.06.2026 [10:00], Сергей Карасёв

InnoGrit представила контроллер для SSD с интерфейсом PCIe 6.0 вместимостью до 256 ТбайтКитайская компания InnoGrit представила свой первый контроллер для SSD с интерфейсом PCIe 6.0 x4. Изделие IG5686 Crestone предназначено для построения накопителей для дата-центров и облачных платформ, ориентированных ресурсоёмкие ИИ-нагрузки. Контроллер поддерживает стандарт NVMe 2.3. Допускается использование чипов флеш-памяти SLC/MLC/TLC/QLC NAND и SCM. При этом сами SSD могут выполняться в различных форм-факторах, включая E1.S и E3.S. Решение IG5686 Crestone обеспечивает скорость чтения информации до 28 Гбайт/с и скорость записи до 22 Гбайт/с. Величина IOPS при произвольном чтении данных теоретически достигает 7 млн, при произвольной записи — 5 млн. Максимально допустимая вместимость накопителей — 256 Тбайт. Помимо этого, компания InnoGrit разработала контроллер Cascade IG5676 для устройств CXL 3.1 Type-3. Это решение поддерживает высокоскоростную память с низкой задержкой XL-Flash. Возможно создание накопителей ёмкостью до 2 Тбайт. В дальнейшем InnoGrit планирует повышать производительность своих контроллеров. Так, к 2027 году компания рассчитывает довести показатель IOPS в передовых устройствах до 25–50 млн путём оптимизации и более глубокой интеграции стандартов PCIe 6.0 и CXL. В 2028 году величина IOPS, как предполагается, приблизится к 100 млн. Это позволит вывести на новый уровень быстродействие платформ хранения данных для ИИ. Нужно отметить, что контроллеры для SSD с интерфейсом PCIe 6.0 проектируют и другие участники рынка. В частности, такое решение недавно продемонстрировала компания Phison. Кроме того, соответствующими разработками занимается Silicon Motion.

09.06.2026 [00:29], Владимир Мироненко

Google заказала у Intel упаковку 3 млн TPU — у TSMC спрос превысил возможности производстваХолдинг Alphabet, материнская структура Google, заключил сделку с Intel, в рамках которой та изготовит для него в 2028 году более 3 млн кастомных TPU. Сообщивший об этом ресурс The Information добавил, что Google в течение нескольких месяцев тестировала технологии Intel, прежде чем принять решение о сделке. The Information отметил, что Intel получает заказы от таких компаний, как Google, в то время как тайваньский производитель микросхем TSMC испытывает трудности с удовлетворением спроса на выпускаемую им продукцию из-за нехватки производственных мощностей. Как пишет Bloomberg, акции Intel недавно достигли рекордного уровня после того, как её прогноз продаж превзошёл ожидания Уолл-стрит, показав, что компания наконец-то извлекает выгоду из бума инвестиций в ИИ. Оптимистичный прогноз свидетельствует о том, что генеральный директор Лип-Бу Тан (Lip-Bu Tan) добился успеха в стремлении вывести компанию из стагнации. После крупных инвестиций в Intel в прошлом году, которые помогли укрепить баланс компании, он теперь выполняет обещание улучшить её операционную деятельность. По данным The Information, NVIDIA также тестирует возможность использования технологии Intel для создания будущего процессора, объединяющего четыре графических чипа в одном блоке. Однако NVIDIA никак не прокомментировала эту публикацию. Ранее стало известно о планах Илона Маска (Elon Musk) использовать техпроцесс Intel следующего поколения 14A для производства чипов на будущем заводе Terafab в Остине (Austin). Вместе с тем остаётся неясным, насколько Google и другие компании будут полагаться на бизнес Intel по производству полупроводников, по сравнению с услугой упаковки, пишет Bloomberg. Последняя услуга включает в себя помещение чипов в корпус и подготовку их к подключению к другим схемам. Intel сообщила инвесторам, что накопила многомиллиардный портфель заказов на работы по упаковке микросхем. Этот этап в производстве полупроводников традиционно имеет меньшее значение и обходится дешевле, чем процесс создания электронных компонентов из кремниевых пластин. Но его важность возросла, поскольку объединение микросхем в одном корпусе всё чаще рассматривается как способ достижения лучшей производительности, особенно в случае компонентов для ЦОД. Как отметил Bloomberg, заказ на 3 млн чипов не изменит финансовое состояние убыточного производственного бизнеса Intel в одночасье. Это эквивалентно объёму производства крупного завода за месяц или даже меньше. Тем не менее обращения крупных компаний, свидетельствующие о готовности доверять Intel реализацию важных задач, помогут укрепить позиции её технологий и повысить шансы на привлечение других клиентов.

08.06.2026 [16:06], Руслан Авдеев

Эстонская Skeleton Technologies представила суперконденсаторные ИБП GrapheneUPS для ИИ ЦОДЭстонский поставщик энергетической инфраструктуры и силовых решений различного назначения — Skeleton Technologies — представил новые ИБП на основе графеновых суперконденсаторов, разработанные специально для ИИ ЦОД, сообщает Datacenter Dynamics. Система GrapheneUPS предназначена для долговременной защиты работы дата-центров. При этом она соответствует требованиям регуляторов к подключению дата-центров к электросети. По данным компании, в отличие от традиционных ИБП, система GrapheneUPS с двойным преобразованием энергии непрерывно преобразует поступающий переменный ток (380–480 В, 50/60 Гц) в постоянный и обратно с использованием SiC/GaN-компонетов, изолируя критически важное ИИ-оборудование от помех в энергосети. Кроме того, ИБП компании способны активно стабилизировать напряжение, например при его падении, перебоях с электроснабжением и других нештатных ситуациях, обеспечивая соответствие требованиям к состоянию сети без необходимости использования дополнительных сетевых стабилизаторов. Skeleton утверждает, что использование новых ИБП благоприятно скажется на эффективности дата-центров. Компания заявляет, что система позволяет на 40 % увеличить вычислительные мощности и значительно сократить требования к энергосети. Стабилизируя кратковременные сбои и компенсируя резкие изменения нагрузки, система способна помочь снизить риск перебоев в работе, защитить чувствительное к перепадам энергии оборудование и оптимизировать энергоснабжение всё более динамичных ИИ-нагрузок. Кроме того, новинка отличается высокой энергетической плотностью — до 242 кВт/м2.

Источник изображения: Skeleton Technologies Skeleton утверждает, что система отличается гибкостью внедрения, может использоваться в «белом» и «сером» пространствах ЦОД, а также за пределами объекта в контейнерном исполнении. Кроме того, она дополняет аккумуляторные энергохранилища ЦОД, обеспечивая дополнительный уровень энергобезопасности в случае сбоев электроснабжения. Система компании способна сглаживать колебания нагрузки в электросетях и ИИ ЦОД менее чем за миллисекунду. Компания заявляет, что её решения позволяют дата-центрам выравнивать спрос на электроэнергию и снижать её потребление. Компания Skeleton была основана в 2009 году в Тарту (Tartu, Эстония). Её первым клиентом стало Европейское космическое агентство (ESA), а впоследствии решения компании стали применять в немецкой автомобильной промышленности, в том числе в автомобилях BMW серий M и i7. Своё первое производство в США компания открыла в Хьюстоне (Houston, штат Техас) ранее в этом году, а в Европе два её завода появились ещё в ноябре 2025 года — объект стоимостью $270 млн в Германии и объект стоимостью $60 млн в Финляндии. В прошлом месяце появились данные о том, что компания привлекла €33 млн ($39 млн) в преддверии планируемого IPO в США в 2027 году.

08.06.2026 [15:33], Руслан Авдеев

Стартап Windrose Electric, разрабатывающий электрические грузовики, представил концепцию ИИ ЦОД на колёсах

hardware

автомобиль

аккумулятор

ии

инференс

контейнер

микро-цод

модульный

цод

электропитание

энергетика

Бельгийский стартап, занимающийся разработкой и выпуском электромобилей, представил концепцию контейнерных мобильных ЦОД. Ранее в этом году компания уже озвучила планы по созданию контейнерных ИИ- и энергетических решений на колёсах, которые можно будет легко доставлять туда, где они необходимы, с использованием её электрогрузовика с полуприцепом — R700, сообщает Datacenter Dynamics. Windrose Electric заявила о премьере новой продуктовой линейки «ИИ в коробке» для хранения электроэнергии, а также «модульного» решения для ИИ-инференса в отдельном контейнере. Сообщалось, что контейнер с вычислительным оборудованием может обеспечить инференс-нагрузки мощностью 500 кВт, а аккумуляторный контейнер способен хранить до 4 МВт·ч. Контейнерные дата-центры и соответствующая инфраструктура уже широко представлены в отрасли ИИ-решений, но обычно они перевозятся на крупных бортовых грузовиках с последующей разгрузкой, тогда как решения Windrose не предусматривают разгрузки и остаются в кузове или на колёсной платформе. Насколько практично подобное решение, пока не вполне понятно. Вычислительный модуль мощностью 500 кВт с питанием только от аккумуляторов ёмкостью 4 МВт·ч израсходует весь запас энергии в течение одного дня, после чего ему потребуется либо новое энергохранилище, либо подключение к внешнему источнику питания.

Источник изображения: Windrose Electric В этом месяце было объявлено, что Windrose работает с китайской энергетической компанией LiFe-Younger над мобильным контейнером для обеспечения ЦОД электроэнергией. В частности, сообщалось о планах разработать контейнерный аккумуляторный модуль с грузовиком-тягачом, обеспечивающим 2 МВт мощности в 20′ контейнере, который способен помочь справиться с нехваткой энергии в электросетях. В качестве энергетического модуля будет использоваться разработка iMContainer компании LiFe-Younger. Основанная в Китае в 2022 году, компания Windrose переместила штаб-квартиру в Бельгию и выпускает мощные электрические грузовики с большим запасом хода для коммерческой логистики. В настоящее время они способны проехать более 670 км без подзарядки с грузом массой 49 т. Основанная в 2016 году компания LiFe-Younger предлагает мобильные и стационарные решения для зарядки электромобилей и системы хранения энергии.

08.06.2026 [10:43], Владимир Мироненко

В Yandex Cloud произошёл сбой в расчёте начисленийВ минувшую пятницу, 5 июня, на платформе Yandex Cloud произошёл сбой, из-за которого в расчёте начислений за ресурсы из Marketplace наблюдались ошибки, а у ряда пользователей были произведены несанкционированные списания за неиспользуемые ресурсы. В Yandex Cloud подтвердили факт сбоя и предупредили пользователей о приостановке обработки биллинга. «Обнаружена ошибка в расчёте начислений для части ресурсов. Для предотвращения некорректных списаний обработка биллинга была временно остановлена. После устранения причины будут выполнены необходимые корректировки начислений», — сообщили в компании. Как указано в описании инцидента, сбой затронул следующие зоны: ru-central1-e, ru-central1-a, ru-central1-b и ru-central1-d. Спустя несколько часов было объявлено об устранении сбоя и начале разблокировки ранее остановленных ресурсов. Компания сообщила, что «команда работает над разблокировкой ошибочно заблокированных биллинг-аккаунтов и корректным отображением детализации», а также что «формируются списки, по которым в ближайшее время будут выполнены возвраты». К концу дня, в 23:56, компания сообщила, что работа систем биллинга восстановлена. До этого Yandex Cloud объявила, что был выполнен возврат всех ошибочно списанных средств. В комментариях на сайте Хабре пользователи отметили, что ошибочные списания в Yandex Cloud были незначительными — в пределах 6–6,5 тыс. руб. Впрочем, в Сети попадаются сообщения о якобы списании заметно более крупных сумм. |

|