Материалы по тегу: software

|

09.06.2026 [22:37], Андрей Крупин

Orion soft представил платформу StarGuard AI для безопасной работы с ИИРоссийский разработчик Orion soft выпустил шлюз безопасности StarGuard AI, предназначенный для централизованной и контролируемой работы с большими языковыми моделями (LLM) в корпоративной среде. Решение может быть актуально для крупного бизнеса, финансового сектора, промышленности, государственных организаций и компаний, внедряющих корпоративных ИИ-ассистентов, агентские системы и внутренние платформы на базе искусственного интеллекта. StarGuard AI функционирует как обратный прокси-сервер (Reverse Proxy) между пользователями и LLM-провайдерами. Каждый запрос и ответ проходят через набор детекторов до выхода за пределы защищённого контура. Шлюз помогает блокировать чувствительные данные, jailbreak- и prompt-инъекции, токсичный, запрещённый или нецелевой контент в ИИ-чатах, ассистентах, сервисах поддержки и корпоративных помощниках. Благодаря этому программный комплекс снижает репутационные риски во внутренних и клиентских ИИ-сервисах, закрывает риски утечки данных, контролирует разрешённые сценарии использования, централизует доступ к нескольким моделям и даёт прозрачный аудит всех событий.

Источник изображения: Steve Johnson / unsplash.com Решение позволяет подключать облачные и локальные LLM, включая ChatGPT, Claude, DeepSeek, GigaChat, YandexGPT, а также любые локальные модели. Поддерживается интеграция с OpenWebUI, IDE, AI-агентами и корпоративными платформами. «Корпоративные ИИ-сервисы постепенно становятся частью критической IT-инфраструктуры, а значит требуют сопоставимого уровня контроля и защиты. StarGuard AI создаёт единый контур безопасной работы с LLM и позволяет организациям внедрять ИИ-инструменты без потери контроля над данными с политиками безопасности и нормативными требованиями», — поясняют разработчики продукта.

08.06.2026 [10:43], Владимир Мироненко

В Yandex Cloud произошёл сбой в расчёте начисленийВ минувшую пятницу, 5 июня, на платформе Yandex Cloud произошёл сбой, из-за которого в расчёте начислений за ресурсы из Marketplace наблюдались ошибки, а у ряда пользователей были произведены несанкционированные списания за неиспользуемые ресурсы. В Yandex Cloud подтвердили факт сбоя и предупредили пользователей о приостановке обработки биллинга. «Обнаружена ошибка в расчёте начислений для части ресурсов. Для предотвращения некорректных списаний обработка биллинга была временно остановлена. После устранения причины будут выполнены необходимые корректировки начислений», — сообщили в компании. Как указано в описании инцидента, сбой затронул следующие зоны: ru-central1-e, ru-central1-a, ru-central1-b и ru-central1-d. Спустя несколько часов было объявлено об устранении сбоя и начале разблокировки ранее остановленных ресурсов. Компания сообщила, что «команда работает над разблокировкой ошибочно заблокированных биллинг-аккаунтов и корректным отображением детализации», а также что «формируются списки, по которым в ближайшее время будут выполнены возвраты». К концу дня, в 23:56, компания сообщила, что работа систем биллинга восстановлена. До этого Yandex Cloud объявила, что был выполнен возврат всех ошибочно списанных средств. В комментариях на сайте Хабре пользователи отметили, что ошибочные списания в Yandex Cloud были незначительными — в пределах 6–6,5 тыс. руб. Впрочем, в Сети попадаются сообщения о якобы списании заметно более крупных сумм.

02.06.2026 [12:00], Сергей Карасёв

«Базис» реализовал нативную интеграцию с печатными устройствами «Катюша»Компания «Базис», лидер российского рынка ПО управления динамической ИТ-инфраструктурой, добавила в свою флагманскую платформу виртуализации рабочих мест Basis Workplace нативную интеграцию с многофункциональными устройствами (МФУ) российского производителя печатной техники «Катюша». Реализация проекта проходила в инфраструктуре банка ВТБ, который перевёл на решения «Базиса» более 60 тысяч сотрудников. В сотрудничестве с производителем печатного оборудования было реализовано техническое решение, обеспечивающее совместимость между протоколом TWAIN, используемым устройствами по умолчанию, и протоколом WIA 2, применяемым в виртуализированной инфраструктуре для взаимодействия через программные интерфейсы. Это позволило обеспечить трансляцию вызовов между протоколами и интеграцию сканирующих функций МФУ в контур виртуальных рабочих мест. Итоговое тестирование подтвердило корректную работу сканеров МФУ «Катюша» в Basis Workplace и их полную совместимость с виртуализированной инфраструктурой. «Одним из ключевых преимуществ российских вендоров является работа в тесной связке с заказчиками и оперативная адаптация продуктов под их прикладные требования. Нативная интеграция нашей VDI-платформы с устройствами "Катюша" в инфраструктуре ВТБ является примером такого практического взаимодействия, когда запрос заказчика трансформируется в рабочий и тиражируемый результат. Подчеркну, что после реализации такую связку продуктов можно без опасений рекомендовать другим заказчикам, как уже проверенную», — прокомментировал Дмитрий Сорокин, технический директор «Базиса». «Для нас сотрудничество с "Базисом" – это не разовая интеграция, а системная работа. Когда два российских производителя — платформы виртуализации и печатной техники — эффективно взаимодействуют в работе с протоколами, выигрывает прежде всего заказчик. Он получает готовую, проверенную связку, где не надо ничего "допиливать" своими силами. Банк ВТБ уже оценил это на практике. Уверены, что наш опыт будет востребован и другими компаниями, которые строят собственные VDI-инфраструктуры на российском стеке», — отметил генеральный директор компании «Катюша» Максим Виноградов. «Для нас как для заказчика важно, чтобы сотрудники банка работали с удобным и надёжным инструментом, не уступающим иностранным аналогам. Проведённое тестирование подтвердило нативное взаимодействие МФУ "Катюша" с Basis Workplace, в том числе корректную работу функций сканирования в инфраструктуре виртуальных рабочих мест. Данная связка продуктов российских вендоров может успешно применяться в масштабной корпоративной инфраструктуре», — прокомментировал заместитель руководителя департамента развития инфраструктуры, вице-президент ВТБ Николай Шуткин.

01.06.2026 [08:41], Руслан Авдеев

Наш SQL: фанаты MySQL основали фонд OurSQL Foundation, чтобы давить на OracleСообщество, выступающее от имени пользователей и разработчиков СУБД MySQL, основало фонд с говорящим названием OurSQL Foundation. Он призван помочь выступить единым фронтом против Oracle, владеющей интеллектуальной собственностью, связанной с MySQL и open source, сообщает The Register. Новая НКО намерена помочь сообществу разработчиков и пользователей MySQL получать доступ к знаниям и обеспечить прозрачную обратную связь по будущим разработкам. Организация поддержит использование MySQL как СУБД с откытым исходным кодом и рассчитывает сотрудничать со всеми участниками рынка, включая Oracle, чтобы обеспечить успех ПО на рынке. Меры вызваны опасениями того, что СУБД теряет популярность и рыночную долю в сравнении с конкурентом — PostgreSQL. Кроме того, MariaDB от автора MySQL также пользуется популярностью.

Источник изображения: Rod Long/unsplash.com В открытом письме энтузиасты отметили, что после перехода MySQL под контроль Oracle после покупки Sun Microsystems в 2009 году разработка ведётся без необходимой прозрачности, доработки осуществляются «за закрытыми дверями», а информация о планах развития ПО и процессе принятия решений ограничена. В марте Oracle предложила новый подход к привлечению разработчиков и обещала добавить функции, обеспечивающие векторный поиск, объявив, что MySQL имеет приоритетное значение для компании. По словам представителя Percona — одной из компаний, стоящих за OurSQL Foundation, речь не идёт о попытке противостоять Oracle. В состав совета директоров также вошли представители PlanetScale, PingCAP, VillageSQL и Alibaba. Кроме того, в совет входит и независимый эксперт — Жан-Франсуа Ганье (Jean-François Gagné).

29.05.2026 [20:30], Руслан Авдеев

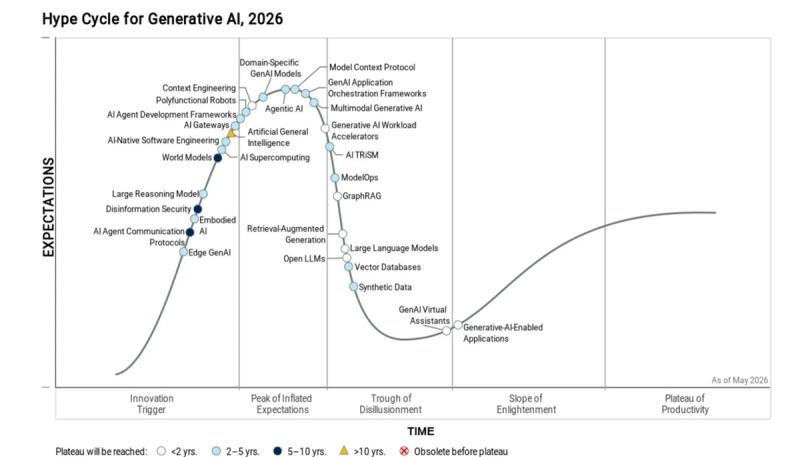

Gartner: большинство кастомных ИИ-моделей и проектов генеративного ИИ ожидает провалПо мнению Gartner, не менее половины всех проектов в сфере генеративного ИИ и создателей большинства ИИ-моделей ожидает неудача. Расходы на проекты будут выше планируемого из-за неудачных архитектурных решений и недостатка ноу-хау, а разработчики собственных моделей столкнутся с высокими затратами и другими сложностями, сообщает The Register. В докладе «Цикл хайпа вокруг генеративного ИИ» (Hype Cycle for Generative AI), в котором эксперты рассмотрели 30 ИИ-технологий, сообщается, что ни одна из них не достигла т.н. «плато производительности». На этом этапе продукты и технологии уже пережили два или три этапа эволюции, стабильны и приносят ощутимые выгоды. До достижения этого плато ИИ-технологии в своём развитии поднимаются до «Пика завышенных ожиданий» (Peak of Inflated Expectations), после чего следует спад в «Долину разочарований» (Trough of Disillusionment) и медленный подъём по «Склону просветления» (Slope of Enlightenment). По мнению Gartner, в областях вроде здравоохранения, финансов, юриспруденции и др. будут обеспечивать лучшие результаты модели, специально созданные «с нуля» под конкретную тематику, либо специально доработанные — в сравнении с универсальными моделями «общего назначения». Впрочем, подчёркивается, что создание специальных моделей требует значительных вычислительных ресурсов, специальных знаний и постоянного обслуживания. На достижение достаточной зрелости для массового применения таким моделям потребуется минимум 2–5 лет.

Источник изображения: Gartner Безусловный успех, по мнению Gartner, ожидает лишь ИИ-приложения вроде помощников в подготовке программного кода, создании графики и видео, а также обобщения контента. Впрочем, из-за проблем с интеллектуальной собственностью и склонностью ИИ к ошибкам, нишу ожидают некоторые проблемы. Тем не менее, Gartner уверена, что такие приложени довольно зрелые и они уже освоили более половины целевого рынка. Наименее зрелыми называются протоколы связи ИИ-агентов друг с другом и окружающей средой. Впрочем, этот сегмент довольно быстро развивается и даже уже имеется пара фаворитов. Наибольший потенциал по мнению экспертов имеют технологии защиты от дезинформации (Disinformation Security) и «Модели мира» (World Models). Технологии Disinformation Security помогают распознавать дипфейки, случаи кражи личности и создание другого фейкового контента, направленного на дискредитацию людей и организаций, а также на создание контента для кибератак и совершения других преступлений. По оценкам Gartner, до достижения зрелости этим технологиям ещё 5–10 лет. Модели мира позволяют ИИ выполнять сложные задачи прогнозирования и планирования, имитируя и понимая динамику окружающей среды. Это позволяет принимать обоснованные решения даже в условиях недостатка информации и непредвиденных обстоятельств. Такие инструменты также полезны для навигации робототехники в человеческом мире или создания видеоконтента с реалистичным отображением физики. Также Gartner считает, что организации, намеренные создавать ИИ-системы на основе открытых моделей, не получат доступ к самым передовым технологиям… если не готовы применять китайские разработки. Утверждается, что коммерциализация открытых LLM оказалась весьма сложной для их разработчиков. Многие западные технологические компании избирательно делают модели открытыми, благодаря чему все инновации в данной сфере пока сосредоточены в КНР, хотя развитие идёт и за пределами Китая.

29.05.2026 [16:19], Руслан Авдеев

Project Lightwell: IBM и Red Hat предложили корпорациям скинуться на патчи безопасности для open source ПО и сами вложат $5 млрдIBM и Red Hat объявили о начале реализации Project Lightwell, в рамках которого компании инвестируют $5 млрд в развитие ПО с открытым исходным кодом. Проект станет опираться на передовые ИИ-возможности и команду из более 20 тыс. разработчиков со всего мира. Это позволит задать новую модель работы корпоративных пользователей с open source — от разработки до промышленной эксплуатации. В рамках Project Lightwell создадут доверенный «клиринговый» информационный центр, а международная сеть разработчиков поможет в устранении уязвимостей. Эта платформа станет «координационным уровнем» для обеспечения безопасности, использующим передовые ИИ-возможности для проверки и тестирования патчей для огромных объёмов открытого исходного кода. Возможности будут доступны в рамках платных подписок, что позволит корпоративным клиентам интегрировать обновления безопасности в существующие цепочки поставок ПО. При этом им будет доступен корпоративный уровень валидации и управления жизненным циклом ПО. IBM и Red Hat подчеркнули, что именно open source лежит в основе современной IT-инфраструктуры, открытый код используют более 90 % компаний из списка Fortune 500. При этом развитие передовых ИИ-технологий ускоряет как поиск, так и использование уязвимостей. Например, специальная модель Mythos Preview компании Anthropic выявила в ПО open source почти 3,9 тыс. уязвимостей высокого и критического уровней. IBM и Red Hat начали сотрудничать с Bank of America, BNY, Citi, Goldman Sachs, JPMorganChase, Mastercard, Morgan Stanley, Royal Bank of Canada, State Street, Visa и Wells Fargo — одними из первых участников Project Lightwell. Предполагается, что опыт этих структур поможет сформировать протоколы обнаружения, проверки и устранения уязвимостей в сложных цепочках поставок открытого ПО.

Источник изображения: IBM Проект опирается на уже имеющиеся компетенции IBM и Red Hat в сфере open source, корпоративных ИИ-продуктов и кибербезопасности. Также на вооружение берётся опыт инициатив вроде Anthropic Project Glasswing и OpenAI Trust Access for Cyber. В частности, проект предусматривает использование агентных ИИ-инструментов для защиты основных компонентов open source, лежащих в основе современных корпоративных и ИИ-систем. Ключевым элементом станет создание «клирингового» центра для обеспечения безопасности open source. Модели открытого ПО компаний IBM и Red Hat расширяются за пределы их собственных платформ. IBM уже использует более 62 тыс. пакетов open source, а также имеет большой опыт, связанный с 10 тыс. из них. Компании оперируют одними из крупнейших в отрасли открытых экосистем, управляя жизненными циклами, валидацией и выпуском патчей для их компонентов, применяя технологии на базе Linux, Java, Kubernetes, Kafka, Ansible, Terraform, Flink, Cassandra и др. Теперь предполагается применять аналогичный подход при работе с открытым исходным кодом из независимых источников. Клиенты смогут сообщать об уязвимостях в активных версиях ПО для их устранения с помощью доверенного посреднического механизма, получать проверенные патчи для решений Red Hat и независимого кода, координировать раскрытие информации об устранении уязвимостей. Пока многие компании используют ИИ для сокращения своего персонала, IBM и Red Hat делают ставку на использование базы из более 20 тыс. разработчиков, усиленной ИИ-инструментами. В задачи этой международной команды войдёт сопровождение продуктов вместе с лидерами open source сообществ; анализ, сортировка и построение иерархии уязвимостей; разработка обновлений безопасности и релиз-инжиниринг. Заявлено, что Project Lightwell поддерживает государственные (естественно, американские) приоритеты по защите цифровой инфраструктуры, критически важных систем и повышению устойчивости экосистем open source в целом. Примечательно, что ещё в январе сообщалось о том, что Евросоюз делает ставку на open source, чтобы избавиться от зависимости от IT-гигантов из США. Теперь получается, что блок в некоторой степени может попасть в зависимость, но уже от других американских IT-гигантов.

29.05.2026 [13:36], Руслан Авдеев

Meta✴ раздумывает, не потягаться ли с AWS и другими облакамиMeta✴, вероятно, попытается выйти на рынок облачных вычислений, составив конкуренцию таким опытными игроками как AWS, Microsoft Azure и Google Cloud, сообщает Datacenter Dynamics. По данным CNBC, информацию подтвердил в ходе ежегодного собрания акционеров глава компании Марк Цукерберг (Mark Zuckerberg), объявив, что руководство техногиганта «определённо обсуждает» выход на новый рынок. По его словам, почти еженедельно компания сталкивается с запросами со стороны бизнесов относительно возможной доступности API-сервисов для клиентов и вычислительных мощностей в аренду. Пока Meta✴ не предлагает никому со стороны облачные сервисы, хотя капитальные затраты на вычислительные мощности сопоставимы с аналогичными расходами известных облачных провайдеров. Во время последнего финансового отчёта Meta✴ сообщала, что прогнозы по капзатратам на год выросли до $120–135 млрд. Это связано с ожиданиями роста цен на комплектующие в текущем году и, в меньшей мере, дополнительными затратами для поддержки мощностей ЦОД в будущем году. Дополнительно заключено соглашение с Nebius на $27 млрд и с CoreWeave — на $21 млрд. Есть и многомиллиардное соглашение с AWS касательно Arm-процессоров Graviton5.

Истчоник изображения: Meta✴ Дополнительно планируется сократить многих сотрудников, высвободив средства для инвестиций в ИИ ЦОД. Ранее компания уже заявила, что намерена уволить 10 % персонала, после чего без работы останутся порядка 8 тыс. человек. Дополнительно компания отказалась от найма 6 тыс. человек, а ещё 7 тыс. будут вынуждены сменить профиль деятельности для участия в новых ИИ-инициативах. В начале года Meta✴ сформировала подразделение Meta✴ Compute, занимающееся наращиванием мощностей своих дата-центров. По словам Цукерберга, в текущем десятилетии компания намерена построить десятки гигаватт, а в будущем — сотни гигаватт или даже более. Впрочем, по словам Цукерберга, сейчас компания не занимается подготовкой облачных решений, а выход на рынок станет актуальным лишь тогда, когда у Meta✴ появится избыток мощностей — отчасти именно это якобы вселяет в топ-менеджмент уверенность при принятии решений об инвестициях в новые ЦОД.

28.05.2026 [23:48], Владимир Мироненко

Yandex B2B Tech, Selectel и MetaMentor представили ИИ ПАК по подпискеYandex B2B Tech совместно с Selectel и MetaMentor представила AIaaS (AI-as-a-Service) ПАК для on-premise развёртывания по подписке платформы Yandex AI Studio. Рещение позволит компаниям быстро развернуть ИИ-проект с размещением инфраструктуры в собственном контуре и соблюдением регуляторных требований и внутренних политик. ПАК включает три компонента: ИИ-платформу Yandex AI Studio, GPU-серверы Selectel и услуги MetaMentor по внедрению, настройке и интеграции решения в ИТ-контур компании. Как сообщается в пресс-релизе, в новом формате доступны все основные возможности Yandex AI Studio: генеративные модели, инструменты для работы с данными и файлами, файловый поиск и визуальные интерфейсы для создания ИИ-агентов даже без навыков программирования. Также в решение могут быть включены ИИ-инструменты для офисной работы. Selectel предоставляет в аренду GPU-инфраструктуру с размещением на площадке заказчика и обязательством по обслуживанию и обновлению оборудования. В частности, доступны платформы NVIDIA HGX A100/B200/B300, RTX PRO 6000 и др., а также ИИ-сервер собственной разработки Selectel. На подготовку и доставку оборудования клиенту уйдёт до пяти рабочих дней. На MetaMentor лежит задача помочь подготовить решение к запуску, включая интеграцию платформы с корпоративными системами заказчика и помощь в создании ИИ-агентов под его задачи. В дальнейшем MetaMentor продолжит системно сопровождать проект, оказывая техническую и клиентскую поддержку по всем вопросам, а также обновляя ПО. Yandex Cloud, Selectel и MetaMentor выводят новый продукт на рынок on-premises платформенного ПО на базе ИИ, который, по данным совместного исследования Yandex Cloud и AHD, составил в России в 2025 году около 16 млрд руб. Значительная часть компаний уже развёртывает ИИ в локальном контуре, поэтому новое решение может вызвать интерес среди заказчиков.

28.05.2026 [09:00], Сергей Карасёв

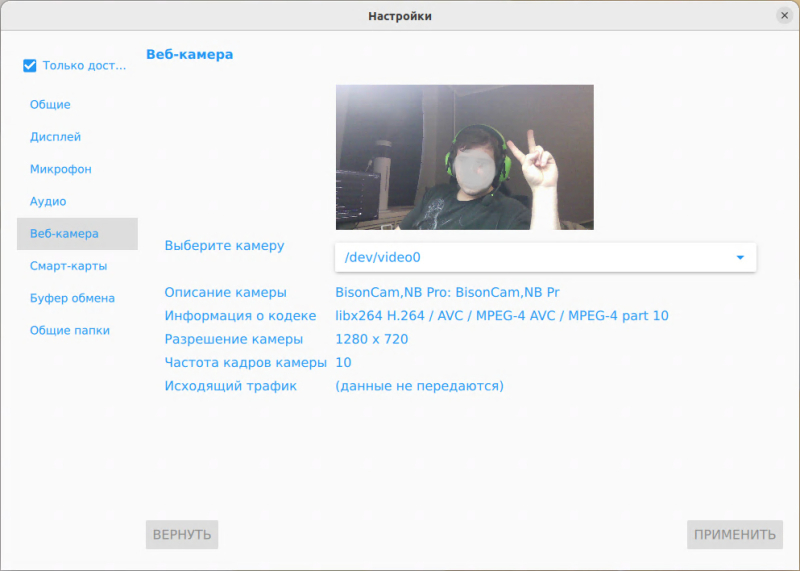

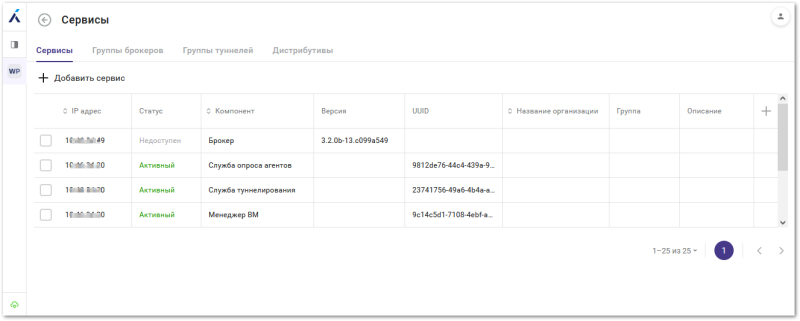

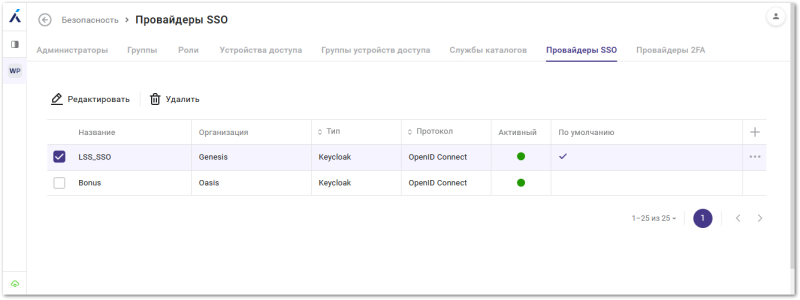

«Базис» представляет Basis Workplace 3.3 с собственным протоколом доставки Basis Connect и интеграцией с Basis SDNКомпания «Базис», лидер российского рынка ПО для управления динамической инфраструктурой, выпустила обновление платформы для управления инфраструктурой виртуальных рабочих столов (VDI) — Basis Workplace 3.3. Главным событием релиза стала нативная интеграция протокола передачи данных Basis Connect, разработанного «Базис» для расширения возможностей VDI-платформы и упрощения её развёртывания. Помимо этого в версии 3.3 появились новые возможности для работы в крупных и территориально распределённых инсталляциях, добавлена поддержка программно-определяемых сетей Basis SDN при работе с Basis Dynamix Enterprise, а также реализован ряд улучшений в области администрирования, безопасности и интеграции с корпоративными системами. Собственный протокол доставкиКлючевым нововведением Basis Workplace 3.3 стала интеграция Basis Connect — собственного протокола передачи данных между клиентом и виртуальным рабочим местом. При этом «Базис» сохраняет поддержку сторонних протоколов доставки, среди которых RX и Loudplay — это одно из востребованных у заказчиков преимуществ платформы. Качество и скорость обмена данными напрямую определяют уровень комфорта пользователя при работе в виртуальной среде: сможет ли он использовать ресурсоёмкие приложения, периферийные устройства и участвовать в видеоконференциях без потерь качества. Для обеспечения необходимого уровня комфорта могут использоваться проприетарные протоколы, требующие отдельных лицензий, либо open-source протоколы, нуждающиеся в доработке и поддержке. Наличие собственного протокола передачи данных в составе Basis Workplace позволяет избежать зависимости от сторонних решений, упростить внедрение платформы и обеспечить заказчикам более предсказуемую эксплуатацию. В первой публичной версии Basis Connect реализована передача изображения и звука, работа с буфером обмена (текст, файлы, папки, изображения), поддержка клавиатуры, мыши, принтеров, сканеров и других периферийных устройств, включая USB-токены для использования сертификатов внутри виртуального рабочего места. Нативная интеграция с Basis SDNВ новой версии продолжается развитие модульной архитектуры драйверов, которая в Basis Workplace 3.2 обеспечила нативное подключение к Basis Dynamix Enterprise и OpenStack. Теперь платформа виртуализации на основе Basis Dynamix Enterprise может работать в связке с Basis SDN — решением, отвечающим в экосистеме «Базиса» за управление сетевой инфраструктурой. Это позволяет заказчикам построить полностью отечественный стек инфраструктуры виртуальных рабочих мест на продуктах «Базис»: от серверной виртуализации и управления сетью до VDI-платформы. Усиленная отказоустойчивость крупных инсталляцийВ Basis Workplace 3.3 была реализована возможность установки резервного бэкенда: при неисправности основного, система автоматически переключается на резервный, обеспечивая непрерывность работы. Добавлена балансировка нагрузки на брокеров через механизм Global Server Load Balancing (GSLB). Появилась возможность задавать в параметрах службы каталогов сразу несколько IP-адресов и портов: при недоступности одного из них система переключается на следующий по списку, что исключает зависимость от единственного контроллера домена. Развитие получила и реализация геораспределённой VDI. Теперь каждая площадка такой конфигурации имеет собственный сертификат для безопасного доступа, а ключи площадок генерируются непосредственно в списке площадок — это упрощает процедуру их подключения и обеспечивает изоляцию доверия между ЦОД. Дополнительный механизм надёжности — возможность отката на предыдущую версию сервиса. Если после обновления возникают непредвиденные проблемы, администратор может вернуться к работоспособной версии без сложных операций восстановления. Новые инструменты администрированияВ Basis Workplace 3.3 был расширен набор средств управления и мониторинга платформы. Появились новые инструменты для визуализации текущего состояния системы и анализа исторических данных о работе виртуальных машин, в результате администраторы получили более полную картину происходящего в инфраструктуре. Также была ускорена повседневная работа — ряд операций теперь можно выполнять над несколькими пулами и виртуальными машинами одновременно, а часть задач по управлению инфраструктурой переведена в панель управления. Дополнительно, были расширены возможности аудита: по основным сценариям работы пользователей и администраторов теперь можно формировать отчёты за произвольный период. В версии 3.3 расширен список поддерживаемых служб каталогов и провайдеров аутентификации, а также добавлены инструменты для интеграции с корпоративным контуром информационной безопасности. В результате повысилось удобство управления подключениями, улучшился контроль доступа администраторов и пользователей. «При создании Basis Connect мы ориентировались на запросы заказчиков на нативный протокол передачи данных в составе Basis Workplace. Он позволяет обеспечивать высокое качество работы в виртуальной среде, не требует отдельных лицензий на проприетарные протоколы и упрощает эксплуатацию платформы. Что касается интеграции с Basis SDN, то здесь мы считаем принципиально важным, чтобы возможности нашего программно-определяемого решения были доступны в других продуктах экосистемы. Для заказчиков это означает более удобное управление сетевой частью виртуальной инфраструктуры, более быстрое развёртывание рабочих мест и более высокий уровень контроля над безопасностью и сегментацией среды», — прокомментировал Дмитрий Сорокин, технический директор компании «Базис».

27.05.2026 [22:48], Владимир Мироненко

Avanpost открыла публичное тестирование облачного сервиса Avanpost Identity CloudКомпания Avanpost объявила о запуске облачного сервиса Avanpost Identity Cloud и о старте его публичного тестирования. Его участникам предоставляется пробный период с доступом ко всем функциям сервиса до 1 сентября, с неограниченным числом пользователей и возможностью выстроить защиту корпоративного доступа: от базовой многофакторной аутентификации до тарифа E-Passport. Компания отметила, что Avanpost Identity Cloud построен как продолжение on-premise практики Avanpost, при этом возможности и архитектурные принципы корпоративного решения перенесены в облако без потери уровня защиты. Для каждого клиента разворачивается независимое окружение со степенью изоляции, сопоставимой с выделенным on-premise решением. Защищённую интеграцию платформы с корпоративными системами заказчика обеспечивает компонент Access Bridge. Сервис отличается гибкостью развёртывания с возможностью адаптации под любую архитектуру. Поддержка офлайн-аутентификации обеспечивает непрерывность работы даже при сбоях связи, а централизованное управление из единой административной консоли упрощает эксплуатацию — благодаря использованию принципа plug-and-play нет надобности в ручной настройке локальных компонентов. Критически важные секреты приложений (LDAP, RADIUS) обрабатываются внутри контура заказчика, обеспечивая высокий уровень безопасности. Пользователям Avanpost Identity Cloud предлагаются четыре тарифных плана с возможностью перехода по мере расширения числа и сложности выполняемых задач: Start, Expert, E-passport и Zero Trust. С 1 сентября 2026 года будет доступна выгодная ежемесячная тарификация по уникальным пользователям с оплатой по факту использования сервиса. |

|