Материалы по тегу: ix

|

29.03.2025 [10:57], Владимир Мироненко

SK hynix распродала почти всю память HBM, которую выпустит в 2026 годуНа этой неделе состоялось ежегодное собрание акционеров компании SK hynix, на котором Квак Но-чжун (Kwak Noh-jung) заявил, что переговоры компании с клиентами о продажах памяти HBM в 2026 году близки к завершению. Как пишет The Register, заявление гендиректора было воспринято как знак того, что, как и в прошлом году, SK hynix распродаст весь объём выпуска HBM на год вперёд. На мероприятии было объявлено, что в последние недели наблюдается всплеск заказов на поставки HBM, поскольку компании стремятся заключить контракты до ожидаемого увеличения США пошлин на импортируемые полупроводники. Напомним, что в феврале президент США Дональд Трамп (Donald Trump) заявил о намерении ввести тарифы на импорт полупроводников на уровне 25 % и выше, добавив, что в течение года они могут вырасти до 50 % и даже 100 %.

Источник изображений: SK hynix Квак также сообщил акционерам, что SK hynix ожидает «взрывного» роста продаж HBM. На вопрос о том, представляет ли угрозу планам компании то, что DeepSeek использует для обучения своих ИИ-моделей сравнительно небольшие вычислительные мощности, глава SK hynix заявил, что достижения китайского стартапа станут стимулом для более широкого внедрения ИИ, что повлечёт за собой ещё больший спрос на продукцию SK hynix со стороны большего количества покупателей. Такой ответ стал почти стандартным для руководителей компаний, предоставляющих оборудование для обработки рабочих ИИ-нагрузок, на вопрос о том, формируется ли на ИИ-рынке «ценовой пузырь» и что может произойти, если он лопнет, отметил The Register. На прошлой неделе компания заявила, что отправила клиентам первые образцы 12-слойной памяти HBM4, отметив, что «образцы были доставлены с опережением графика» и что «она намерена завершить подготовку к массовому производству 12-слойной продукции HBM4 во второй половине года».

24.03.2025 [20:02], Владимир Мироненко

ИИ в один клик: NVIDIA и Equinix предложат готовые к использованию кластеры DGX GB300 и DGX B300 в 45 регионах по всему мируЧтобы удовлетворить растущий спрос на ИИ-инфраструктуру, NVIDIA представила NVIDIA Instant AI Factory — управляемый сервис на базе платформ NVIDIA DGX SuperPOD с ускорителями Blackwell Ultra и ПО NVIDIA Mission Control. NVIDIA сообщила, что её партнёр Equinix станет первой компанией, которая предложит новые системы DGX GB300 и DGX B300 в своих предварительно сконфигурированных ЦОД с жидкостным или воздушным охлаждением, готовых к обработке ИИ-нагрузок и расположенных на 45 рынках по всему миру. Как пишет SiliconANGLE, Тони Пейкдей (Tony Paikeday), старший директор NVIDIA по маркетингу продуктов и систем ИИ, заявил, что партнёрство с Equinix позволит компании выйти на более чем 45 рынков по всему миру «с предварительно настроенными объектами, которые готовы в зависимости от спроса клиентов масштабировать, эксплуатировать и управлять ИИ-инфраструктурой». NVIDIA отметила, что сервис предоставит предприятиям полностью готовые ИИ-фабрики, оптимизированные для обучения современных моделей и рабочих нагрузок моделей рассуждений в реальном времени, что избавит от многомесячного планирования инфраструктуры перед развёртыванием. Поскольку Equinix предоставляет средства и инфраструктуру для разработки ИИ, Пейкдей возлагает большие надежды на платформу SuperPOD и считает, что она окажет позитивное влияние на развёртывание ИИ компаниями. «Equinix — ключевой компонент этой платформы, потому что вам нужно жидкостное охлаждение, вам нужны ЦОД следующего поколения, вам нужны сверхскоростные соединения с внешним миром, чтобы передавать эти данные», — заявил он.

20.03.2025 [13:14], Сергей Карасёв

Micron, Samsung и SK hynix представили компактные модули памяти SOCAMM для ИИ-серверовКомпании Micron, Samsung и SK hynix, по сообщению ресурса Tom's Hardware, создали модули оперативной памяти SOCAMM (Small Outline Compression Attached Memory Modules) на основе чипов LPDDR5X. Изделия ориентированы на ИИ-системы и серверы с пониженным энергопотреблением. Модули SOCAMM имеют размеры 14 × 90 мм, что примерно в три раза меньше по сравнению с традиционными решениями RDIMM. В состав SOCAMM входят до четырёх 16-кристальных стеков памяти LPDDR5X. Изделия нового формата спроектированы специально для дата-центров, оптимизированных для приложений ИИ. Micron разработала модули SOCAMM ёмкостью 128 Гбайт, при производстве которых используется техпроцесс DRAM 1β (пятое поколение 10-нм техпроцесса). Скоростные показатели не раскрываются. Но Micron говорит о производительности на уровне 9,6 GT/s (млрд пересылок в секунду). В свою очередь, SK Hynix на конференции NVIDIA GTC 2025 представила модули SOCAMM, для которых заявлена скорость в 7,5 GT/s. Отмечается, что на оперативную память приходится значительная доля энергопотребления серверов. Например, в системах, оснащённых терабайтами DDR5, энергопотребление ОЗУ может превышать энергопотребление CPU. Компания NVIDIA учла это при разработке чипов Grace, выбрав для них память LPDDR5X, которая потребляет меньше энергии, чем DDR5. Однако в случае GB200 Grace Blackwell пришлось использовать впаянные блоки LPDDR5X, поскольку самостоятельные стандартные модули LPDDR5X не соответствовали требованиям в плане ёмкости. Изделия SOCAMM, массовое производство которых уже началось, позволяют решить данную проблему. На первом этапе модули SOCAMM будут применяться в серверах на основе суперчипов NVIDIA GB300. Но пока не ясно, станут ли решения SOCAMM отраслевым стандартом, поддерживаемым JEDEC, или останутся фирменным продуктом, разработанным Micron, Samsung, SK hynix и NVIDIA для серверов, построенных на чипах Grace и Vera.

14.02.2025 [14:27], Руслан Авдеев

Equinix построит в Саудовской Аравии ЦОД за $1 млрд, стартапы получат поддержку в объёме $494 млнEquinix намерена инвестировать более $1 млрд в строительство кампуса ЦОД в Саудовской Аравии. Новый объект призван удовлетворить спрос на облачные вычисления, искусственный интеллект и корпоративные рабочие нагрузки, сообщает The National. Изначально он будет иметь ёмкость 100 МВт. ЦОД позволит создать рабочие места на самом объекте и будет способствовать их появлению в смежных отраслях — в секторах технологий и услуг. Как заявляют в Equinix, дата-центр облегчит работу клиентам компании из числа гиперскейлеров и «розничных» пользователей в Саудовской Аравии и за её пределами. Кроме того, его появление привлечёт клиентов на Ближний Восток. Equinix уже присутствует в регионе, ведя бизнес в Омане, Дубае и Абу-Даби. Свой вклад в сектор ЦОД наращивает и Microsoft. Она объявила об открытии в Саудовской Аравии «академии ЦОД», которая будет построена при участии Национальной академии информационных технологий в Даммаме. Техностартапы королевства тоже получат почти полмиллиарда долларов на развитие. Венчурные фонды и инвесторы, включая STV, Rua Ventures, Beco Capital, Waed Capital и других, анонсировали финансовые обязательства для секторов ИИ, логистики и других направлений на сумму $494 млн. Также запущены новые бизнес-акселераторы и инкубаторы.

Источник изображения: Akil Imran/unsplash.com Huawei открыла кластер Future Skills Centre, призванный обучить в течение следующих пяти лет 25 тыс. человек в сфере ИИ, облачных технологий и больших данных. Собственную «академию ИИ» откроет и консалтинговая Accenture — совместно с Министерством связи и информационных технологий Саудовской Аравии. Инициатива призвана устранить разрыв между теорией и её реальным применением. Accenture также откроет академию ИИ в Саудовской Аравии в сотрудничестве с Министерством связи и информационных технологий. Венчурная компания HandsOn Global Investment намерена потратить в Саудовской Аравии $300 млн на разработку и запуск игр — страна продолжает курс на диверсификацию экономики и снижение зависимости от нефтяного сектора. В понедельник местные и мировые инвесторы в совокупности обязались вложить более $7,4 млрд в развитие ИИ и ЦОД в стране — помимо обязательств на $14,9 млрд, объявленных в воскресенье. Планирует построить новый кампус ЦОД в «городе будущего» Неоме и саудовский девелопер DataVolt. Речь идёт об объекте ёмкостью 1,5 ГВт.

10.02.2025 [11:15], Сергей Карасёв

Equinix открыла в Париже дата-центр мощностью почти 30 МВтКомпания Equinix, по сообщению ресурса Datacenter Dynamics, официально открыла новый ЦОД в Париже (Франция). Объект PA13x, располагающийся в коммуне Мёдон в регионе Иль-де-Франс, является частью сети дата-центров xScale гиперскейл-уровня. Затраты на строительство комплекса PA13x составили около €350 млн. Объект общей площадью 20 745 м2 состоит из 12 машинных залов, которые предлагают 7330 м2 колокейшн-пространства. Суммарная мощность достигает 28,8 МВт. Комплекс PA13x располагается на земельном участке, на котором ранее находились заброшенные сооружения промышленной застройки. Проект предполагает монтаж 350 м2 солнечных панелей для генерации чистой энергии. Сам дата-центр получил крышу и стены со звукопоглощающими изоляционными панелями, которые снижают уровень шума. Избыточное тепло от объекта будет направляться в местную отопительную сеть благодаря партнёрству с французской энергетической и газовой компанией Engie.

Источник изображения: Equinix Фактически создание и ввод площадки PA13x в эксплуатацию выполнены в два этапа.Первая очередь мощностью 14 МВт была без громких анонсов запущена ещё в IV квартале 2023 года. Вторую очередь примерно такой же мощности планировалось ввести в строй во II четверти 2025 года, но выполнить работы удалось с опережением графика. На сегодняшний день по всему Парижу Equinix управляет десятью центрами обработки данных — тремя комплексами xScale и семью объектами International Business Exchange (IBX): их суммарная площадь достигает 61 тыс. м2. По состоянию на III квартал 2024 года Equinix сдала в аренду или заключила предварительные соглашения о сдаче 385 МВт из 442 МВт мощностей в своей сети xScale.

02.02.2025 [23:59], Руслан Авдеев

Сети — это модно: Equinix и дизайнер Максимилиан Рейнор создали платье из отслуживших кабелейДизайнер Максимилиан Рейнор (Maximilian Raynor) и оператор ЦОД Equinix объединили усилия для создания необычной одежды из переработанного оборудования одного из лондонских дата-центров компании. По данным Equinix, на изготовление наряда, созданного преимущественно из отслуживших своё оптоволоконных кабелей, ушло около 640 часов. По словам Рейнора, «вам не нужен доступ к лучшим материалам, чтобы создать что-то прекрасное» — можно использовать нетрадиционные материалы, ведь важнее сам подход к дизайну. Платье получилось действительно нетрадиционным — оно состоит из 3600 м «оптики» и весит порядка 25 кг. Как заявил представитель Equinix, устраняя границы между материальным и виртуальным, партнёры хотели создать нечто «осязаемое», что послужило бы темой для обсуждения, чтобы подчеркнуть важность многих тысяч связей, созданных Equinix для ежедневной поддержки компаний и людей. В компании подчеркнули, что дизайн «отдаёт дань уважения» материальной природе жизненно важной инфраструктуры, лежащей в основе интернет. Речь идёт не о некой странной магии или необъяснимой силе, а о физической, сложной сети кабелей, пересекающей сушу, моря и создающую физические связи в ЦОД по всему миру. По данным представителей Equinix, компания хочет продемонстрировать реальное влияние интернета на повседневную жизнь и бизнес, а также его жизненно важную роль в экономике Великобритании. Компания стремится повысить глобальную осведомлённость о стремительно развивающейся и важной отрасли.

24.01.2025 [02:05], Владимир Мироненко

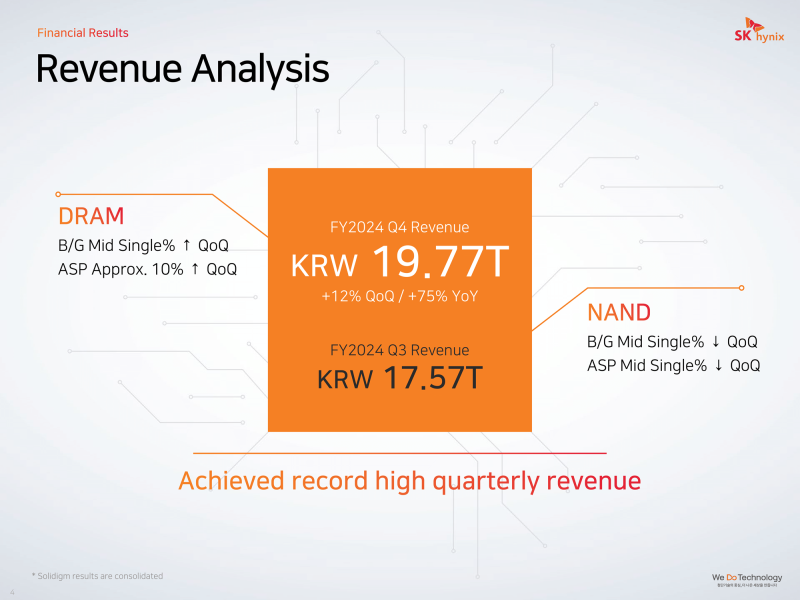

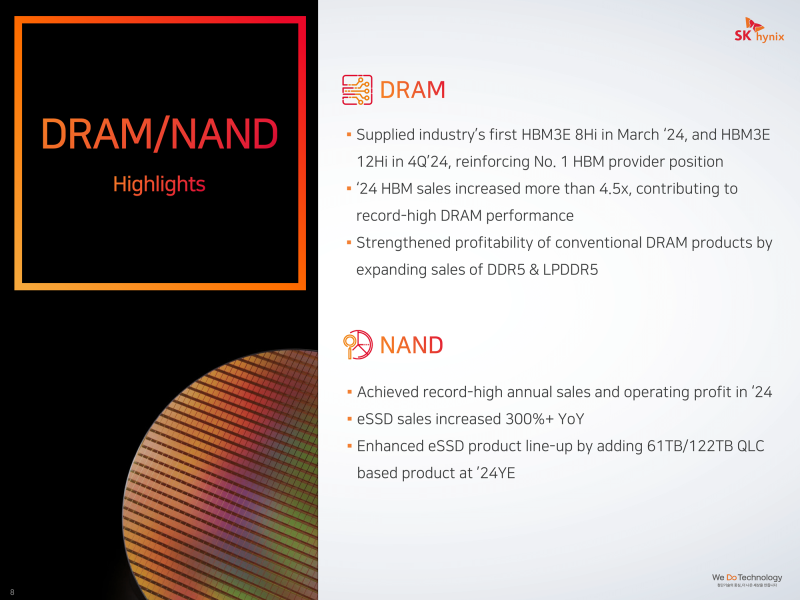

В IV квартале 2024 года SK hynix получила самую большую операционную прибыль в Южной Корее, опередив SamsungКомпания SK hynix, один из крупнейших производителей микросхем памяти в мире, объявила финансовые результаты IV квартала и 2024 года в целом. Компания отметила, что были достигнуты рекордные показатели благодаря высокому спросу на ряд её продуктов, в том числе на память HBM, которая используется в ИИ-ускорителях. SK hynix объявила, что были достигнуты лучшие финансовые показатели за год за всю её историю — по выручке, операционной прибыли и чистой прибыли. Выручка SK hynix за IV квартал составила ₩19,76 вон ($13,76 млрд), что на 74,7 % больше год к году и на 12 % последовательно при консенсус-прогнозе аналитиков, опрошенных LSEG, в ₩19,76 трлн вон, а операционная прибыль подскочила на 2236 % до ₩8,08 трлн (около $5,6 млрд) или на 15 % последовательно. Прогноз Уолл-стрит, согласно данным LSEG, равен ₩8,08 трлн. Чистая прибыль в размере ₩8 трлн (около $5,56 млрд) заметно контрастирует с убытком в ₩1,38 трлн (около $960 млн) годом ранее. По словам SK hynix, чипы HBM принесли ей 40 % от общего дохода от производства DRAM. Согласно данным ресурса The Korea Times, SK hynix впервые опередила по квартальной операционной прибыли своего конкурента и крупнейший бизнес страны Samsung Electronics, став лидером по этому показателю в Южной Корее. За 2024 год выручка SK hynix составила ₩66,19 трлн (около $45,97 млрд), превысив показатель предыдущего года на 102 %. Операционная прибыль равняется ₩23,47 трлн (около $16,4 млрд) по сравнению убытками в 2023 году и чистая прибыль — ₩19,8 трлн (около $13,8 млрд, в 2023 году — убытки). Выручка SK hynix от HBM увеличилась в 2024 году более чем в 4,5 раза по сравнению с 2023 годом. Компания отметила, что «сектор памяти трансформируется в рынок высокопроизводительной и высококачественной памяти с ростом спроса на память для ИИ». Также в 2024 году продажи серверных SSD подскочили на 300 % благодаря высокому спросу со стороны провайдеров ЦОД. Однако акции SK hynix упали на 4,7 % после того, как финансовый директор Ким У-хен (Kim Woo-hyun) предупредил о слабом спросе, растущей конкуренции и растущей рыночной неопределённости, пишет Reuters. «В этом году рынок микросхем памяти остается неопределённым, поскольку растёт торговый протекционизм и углубляются геополитические риски, в то время как производители ПК и смартфонов корректируют запасы», — сообщил финансовый директор в ходе отчёта о финансовых результатах. До объявления финансовых результатов акции SK hynix выросли с начала года примерно на 30 %. Вместе с тем SK hynix прогнозирует рост спроса на HBM и высокоплотную серверную DRAM для HPC-нагрузок «по мере роста инвестиций крупных мировых технологических компаний в ИИ-серверы и повышения значимости инференса», пишет Blocks & Files. Korean Times сообщает, что SK hynix ожидает, что её продажи памяти HBM удвоятся в 2025 году. Вместе с тем компания заявила, что поставки чипов DRAM и NAND снизятся на 10–20 % в I квартале по сравнению с предыдущим. Согласно Reuters, компания сообщила аналитикам, что её капитальные расходы в 2025 году вырастут лишь незначительно год к году, и этот консервативный план усилил опасения рынка по поводу замедления спроса. В комментарии к финансовому отчёту SK hynix говорится, что в I половине этого года на чипы HBM3E будет приходиться более половины дохода от памяти HBM. Компания полагает, что 12-ярусная HBM4 станет её флагманским продуктом в 2026 году. В этом году SK hynix планирует завершить её разработку и начать подготовку к массовому производству во II полугодии. Поставки HBM4 начнутся с чипов 12-Hi, а затем последуют и 16-Hi. «Ожидается, что 16-ярусные чипы будут поставляться в соответствии с требованиями клиентов, вероятно, во II половине 2026 года», — сообщила компания.

20.01.2025 [07:53], Владимир Мироненко

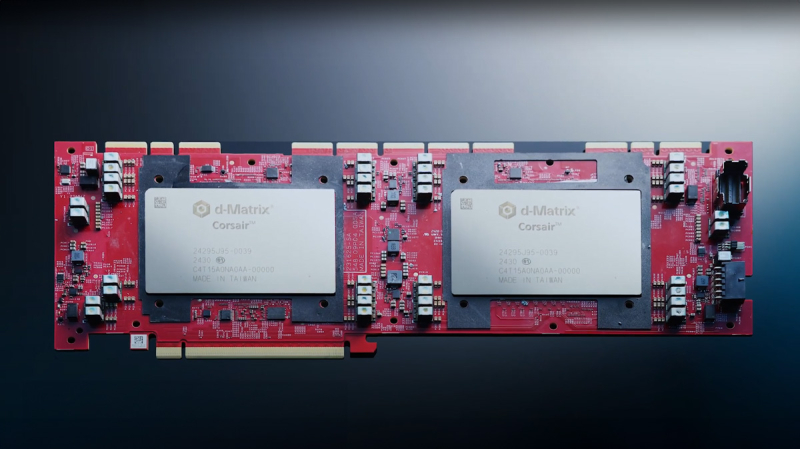

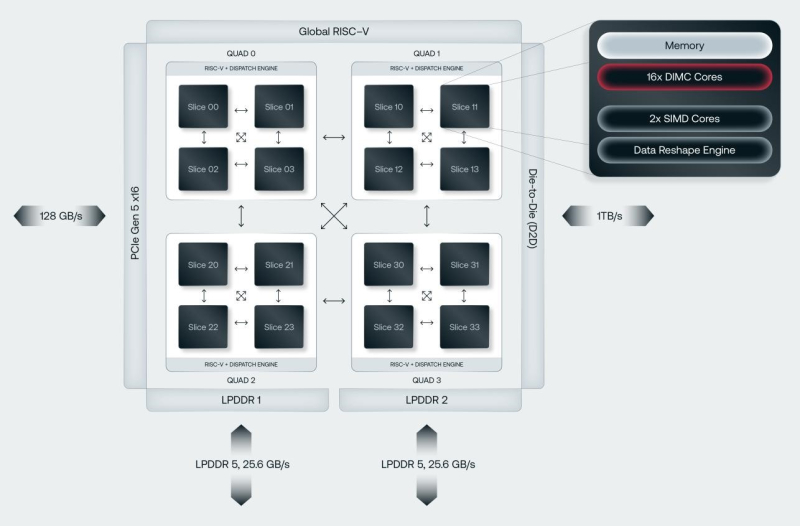

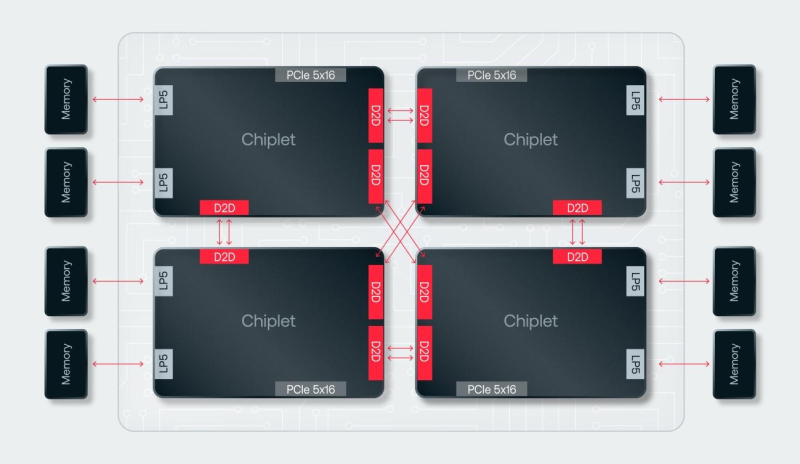

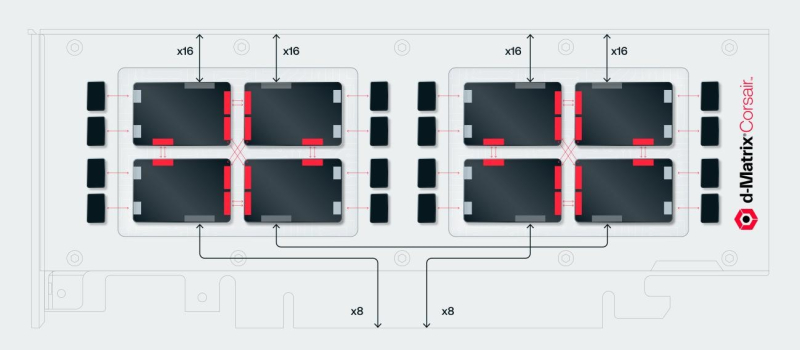

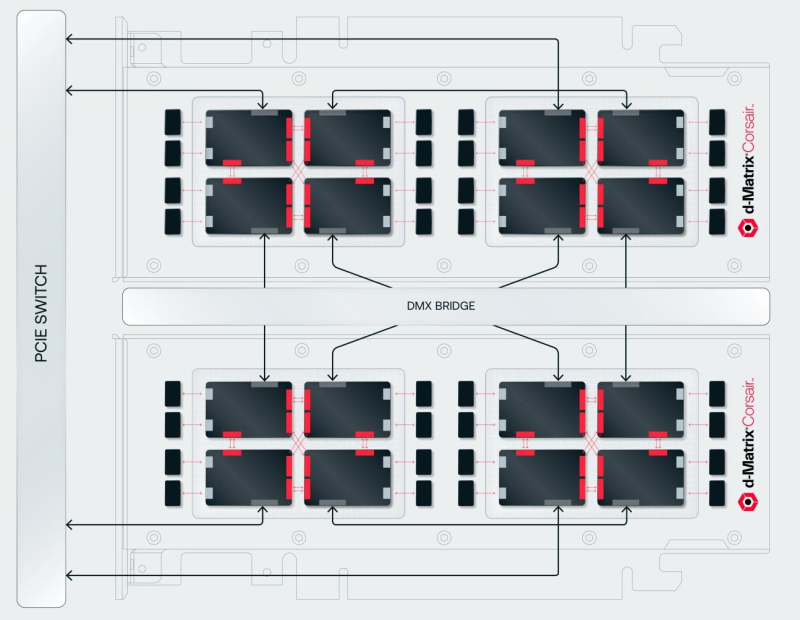

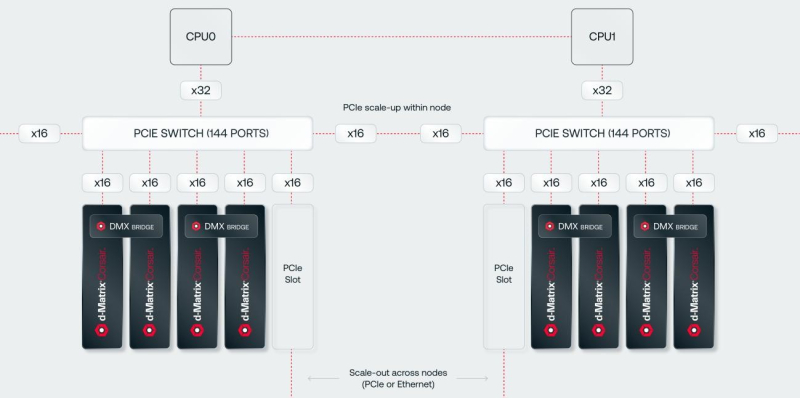

SRAM, да и только: d-Matrix готовит ИИ-ускоритель CorsairСтартап d-Matrix создал ИИ-ускоритель Corsair, оптимизированный для быстрого пакетного инференса больших языковых моделей (LLM). Архитектура ускорителя основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости порядка 150 Тбайт/с. Новинка, по словам компании, отличается производительностью и энергоэффективностью, пишет EE Times. Массовое производство Corsair начнётся во II квартале. Среди инвесторов d-Matrix — Microsoft, Nautilus Venture Partners, Entrada Ventures и SK hynix. d-Matrix фокусируется на пакетном инференсе с низкой задержкой. В случае Llama3-8B сервер d-Matrix (16 четырёхчиплетных ускорителей в составе восьми карт) может производить 60 тыс. токенов/с с задержкой 1 мс/токен. Для Llama3-70B стойка d-Matrix (128 чипов) может производить 30 тыс. токенов в секунду с задержкой 2 мс/токен. Клиенты d-Matrix могут рассчитывать на достижение этих показателей для размеров пакетов порядка 48–64 (в зависимости от длины контекста), сообщила EE Times руководитель отдела продуктов d-Matrix Шри Ганесан (Sree Ganesan). Производительность оптимизирована для исполнения моделей в расчёте до 100 млрд параметров на одну стойку. По словам Ганесан, это реалистичный сценарий использования LLM. В таких сценариях решение d-Matrix обеспечивает 10-кратное преимущество в интерактивности (время до получения токена) по сравнению с решениями на базе традиционных ускорителей, таких как NVIDIA H100. Corsair ориентирован на модели размером менее 70 млрд параметров, подходящих для генерации кода, интерактивной генерации видео или агентского ИИ, которые требуют высокой интерактивности в сочетании с пропускной способностью, энергоэффективностью и низкой стоимостью. Ранние версии архитектуры d-Matrix использовали MAC-блоки на базе SRAM-ячеек, дополненных большим количеством транзисторов для операций умножения. Сложение же выполнялось в аналоговом виде с использованием разрядных линий, измерения тока и аналого-цифрового преобразования. В 2020 году компания выпустила чиплетную платформу Nighthawk на основе этой архитектуры. «[Nighthawk] продемонстрировал, что мы можем значительно повысить точность по сравнению с традиционными аналоговыми решениями, но мы всё ещё отстаем на пару процентных пунктов от традиционных решений типа GPU», — сказал EE Times генеральный директор d-Matrix Сид Шет (Sid Sheth). Однако потенциальным клиентам не понравилось, что при таком подходе возможно снижение точности, так что в Corsair компания вынужденно сделала выбор в пользу полностью цифрового сумматора. ASIC d-Matrix включает четыре чиплета, каждый из которых содержит по четыре вычислительных блока, объединённых посредством DMX Link по схеме каждый-с-каждым, и по одному планировщику и RISC-V ядру. Внутри каждого вычислительного блока есть 16 DIMC-ядер, состоящих из наборов SRAM-ячеек (64×64), а также два SIMD-ядра и движок преобразования данных. Суммарно доступен 1 Гбайт SRAM с пропускной способностью 150 Тбайт/с. ASIC объединён со 128 Гбайт LPDDR5 (до 400 Гбайт/с) посредством органической подложки (без дорогостоящего кремниевого интерпозера). Хотя текущее поколение ASIC включает только четыре чиплета именно из-за ограничений подложки, в будущем их количество увеличится. Внешние интерфейсы ASIC представлены стандартным PCIe 5.0 x16 (128 Гбайт/с) и фирменным интерконнектом DMX Link (1 Тбайт/с) для объединения чиплетов. FHFL-карта Corsair включает два ASIC d-Matrix (т.е. всего восемь чиплетов) и имеет TDP на уровне 600 Вт. Ускоритель работает с форматами данных OCP MX (Microscaling Formats) и обеспечивает до 2400 Тфлопс в MXINT8-вычислениях или 9600 Тфолпс в случае MXINT4. Две карты Corsair можно объединить посредством 512-Гбайт/с мостика DMX Bridge. Их, по словам компании, достаточно для задействования тензорного параллелизма. Дальнейшее масштабирование возможно посредством PCIe-коммутации. Именно поэтому d-Matrix работает с GigaIO и Liqid. В одно шасси можно поместить восемь карт Corsair, а в стойку, которая будет потреблять порядка 6–7 кВт — 64 карты. d-Matrix уже разрабатывает ASIC следующего поколения Raptor, который должен выйти в 2026 году. Raptor будет ориентирован на «думающие» модели и получит ещё больше памяти за счёт размещения DRAM непосредственно поверх вычислительных чиплетов. SRAM-чиплеты Raptor также перейдут с 6-нм техпроцесса TSMC, который используется при изготовлении Corsair, к 4 нм без существенных изменений микроархитектуры. По словам компании, она потратила два года на работу с TSMC, чтобы создать 3D-упаковку для нового поколения ASIC. Как отмечает EETimes, команда разработчиков ПО d-Matrix в два раза больше команды разработчиков оборудования (120 против 60). Стратегия компании в области ПО заключается в максимальном использовании open source экосистемы, включая PyTorch, OpenAI Triton, MLIR, OpenBMC и т.д. Вместе они образуют программный стек Aviator, который отвечает за конвертацию моделей в числовые форматы d-Matrix, применяет к ним фирменные методы разрежения, компилирует их, распределяет нагрузку по картам и серверам, а также управляет исполнением моделей, включая обслуживание большого количества запросов.

26.12.2024 [16:50], Руслан Авдеев

Equinix предложил ИИ-фабрики на базе систем Dell с ускорителями NVIDIAОператор ЦОД Equinix совместно с Dell Technologies предложил частные ИИ-облака на базе Dell AI Factory. Использование комплекса Dell AI Factory with NVIDIA в ЦОД IBX позволяет комбинировать различные продукты, решения и сервисы на нейтральной площадке, где клиенты смогут безопасно и экономически эффективно объединить ресурсы публичных облаков, колокейшн-объектов, а также собственных облачных и локальных инфраструктур. Dell AI Factory with NVIDIA включает серверы Dell PowerEdge XE9680 с ускорителями NVIDIA, Ethernet-решения NVIDIA Spectrum-X и BlueField-3, а также СХД Dell PowerScale F710. Кроме того, будут доступны и 4U-серверы PowerEdge XE9680L, поддерживающие до восьми новейших ускорителей NVIDIA Blackwell. Решение будет доступно в более чем 260 ЦОД Equinix IBX. В Equinix объявили, что намерены обеспечить клиентов передовой ИИ-инфраструктурой, отвечающей самым высоким стандартам производительности, безопасности и надёжности, а сотрудничество с Dell и NVIDIA позволит использовать максимум ресурсов систем генеративного ИИ, сохраняя контроль над данными и поддерживая собственные корпоративные цели достижения экоустойчивости. Наличие площадок Equinix в более 70 мегаполисах мира, время бесперебойной работы 99,999 %, масштабируемость проектов и сотрудничество с тысячами сетей и провайдеров, а также обеспечение ЦОД на 96 % возобновляемой энергией (100 % на ключевых рынках) в сочетании с платформой Dell AI Factory with NVIDIA, которая уже доступна в ЦОД Equinix в большинстве регионов мира, позволит заказчикам повысить удобство, безопасность и экологичность работы с генеративным ИИ.

25.12.2024 [00:55], Владимир Мироненко

Netflix подал в суд на Broadcom, заявив, что VMware нарушает его патенты в области виртуализацииСтриминговый гигант Netflix подал в понедельник иск к Broadcom в окружной суд США по Северному округу Калифорнии с обвинением принадлежащего ей дочернего предприятия VMware в нарушении пяти патентов, связанных с работой виртуальных машин («патент 424», «патент 707», «патент 891», «патент 893» и «патент 122»). Как сообщает SiliconANGLE, три из этих патентов касаются использования CPU в виртуальных машинах, а два — запуска по крайней мере одной виртуальной машины с использованием балансировщика нагрузки. Согласно иску, нарушения патентов были допущены в VMware vSphere Foundation, VMware Cloud Foundation, VMware Cloud on AWS и облачных решениях, предлагаемых Microsoft, Google, Oracle, IBM и Alibaba. В частности, в вышеуказанных продуктах, по словам Netflix, допущены нарушения «патента 424». Netflix заявил, что VMware умышленно нарушает авторские права с 2012 года, когда она узнала об этом патенте. «Патент 424 был процитирован экспертом Бюро по патентам и товарным знакам США при отклонении заявки VMware, которая в конечном итоге была оформлена как патент США № 8 650 564», — указал Netflix в иске. Учитывая осведомлённость VMware об этом патенте, Netflix утверждает, что Broadcom и VMware занимались «умышленным нарушением», и попросила суд обязать Broadcom возместить убытки, размер которых в иске не указан. Патентная война Netflix и Broadcom началась в 2018 году, когда Broadcom подала в суд на Netflix, обвинив его в нарушении своих патентов на технологию потокового видео. Дела были возбуждены в Калифорнии, Германии и Нидерландах. Судебное разбирательство по иску Netflix запланировано на июнь 2025 года. |

|