Материалы по тегу: цод

|

21.07.2022 [17:27], Руслан Авдеев

Жители Северной Вирджинии жалуются на «катастрофический шум» от дата-центровКак сообщает портал Data Center Dynamics, домовладельцы и гражданские активисты округа Принс-Уильям (Prince William County) в Северной Вирджинии (США), пожаловались на «катастрофический» шум, издаваемый местными ЦОД. Шум доносится из принадлежащих Amazon дата-центров, расположенных на территории кампуса Tanner Way. Сейчас техногигант ведёт строительство в городе Манассасе, но речь идёт не о шуме стройки. По словам активистов, непрекращающийся шум вызван работой систем воздушного охлаждения на крышах ЦОД, создающих неблагоприятную среду обитания для жильцов района Great Oak, состоящего из 291 домохозяйства.

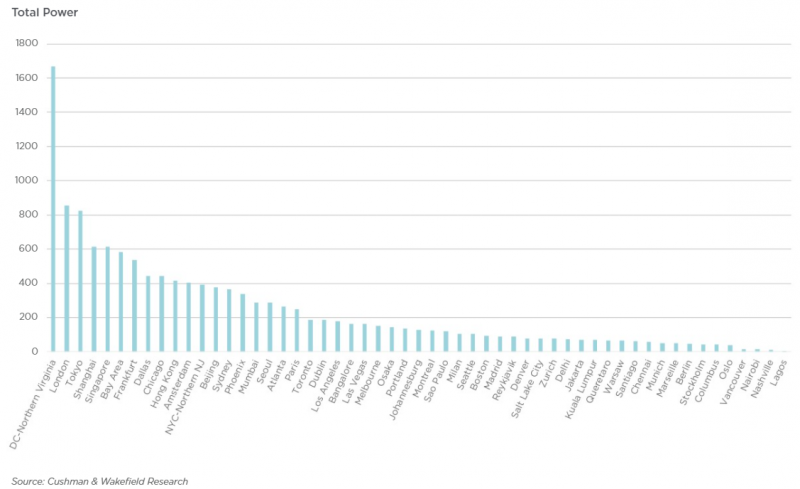

Источник изображения: Elyas Pasban/unsplash.com Круглый стол ассоциации домовладельцев округа совместно с ассоциацией города Манассас направили жёсткую жалобу в Наблюдательный совет округа, сообщив о «чрезвычайном промышленном шуме», продолжающемся круглосуточно и без выходных, никаких мер по устранению которого не принимается. По словам местных активистов, шум загрязняет окрестности непрерывно, чему есть аудио- и видеодоказательства. От наблюдательного совета требуют найти решение проблемы. Активисты напоминают о прецедентах — аналогичные жалобы в Аризоне в 2018 году привели к прекращению развития ЦОД в регионе решением местных властей. По данным активистов, пока руководство совета не смогло напрямую решить проблему с ЦОД, и теперь жители требуют приостановки разрешений на работу дата-центров в округе Принс-Уильям до тех пор, пока проблема не будет устранена. Основная беда в том, что Наблюдательный совет округа намеренно исключил шум от промышленных кондиционеров из правил 1989 года, в соответствии с которыми и строились дата-центры, в результате чего округ потерял законную возможность контролировать работу ЦОД в этом отношении, независимо от того, какой громкости звук издают объекты. Местные жители жалуются на проблемы как с собственным здоровьем, так и с состоянием домашних питомцев. Благодаря местным регуляциям Северная Вирджиния крайне привлекательна для строителей и операторов дата-центров. Текущая ёмкость ЦОД в штате составляет порядка 1,7 ГВт, а через два года, как ожидается, она достигнет 2 ГВт. И это самый крупный в мире рынок ЦОД. Для сравнения — суммарная ёмкость сразу четырёх европейских рынков FLAP только-только добралась до 2 ГВт. Та же Amazon за последний десяток лет вложила в постройку дата-центров в Северной Вирджинии более $35 млрд.

20.07.2022 [15:56], Владимир Мироненко

Аномальная жара привела к сбоям в лондонских дата-центрах Google и Oracle

google cloud platform

hardware

oracle cloud infrastructure

великобритания

облако

охлаждение

сбой

цод

Во вторник, 19 июля, в ЦОД Google Cloud Platform (GCP) в Лондоне произошёл сбой в системе охлаждения, в связи с чем несколько сервисов компании временно вышло из строя. В лондонском регионе облака Oracle тоже возникли проблемы с охлаждением оборудования ЦОД. Сбои произошли из-за рекордной жары в Великобритании — температура превысила +40°C. Некоторые операторы дата-центров были вынуждены принять нестандартные меры, начав обрызгивать водой внешние модули систем кондиционирования, установленные на крыше. Отключение ряда сервисов Google произошло в 18:13 по местному времени (20:13 мск). В журнале статуса оборудования сбой описан как «связанный с охлаждением». Google заявила, что сбой затронул лишь небольшое количество клиентов. В частности, отключение коснулось сервисов Persistent Disk и Autoscaling. Хотя Google утверждает, что сбой продолжался до 22:00 BST (24:00 мск), в означенное время всё ещё поступали жалобы на ошибки в работе Persistent Disk. С подобными проблемами в Лондоне столкнулась и облачная служба Oracle. Проблемы с перегревом у неё начались примерно в 17:00 по местному времени (19:00 мск). Oracle ранее арендовала ресурсы в ЦОД Equinix в лондонском кампусе Слау, но сейчас не раскрывает местонахождение своих мощностей. «В результате несезонных температур в регионе возникла проблема с частью инфраструктуры охлаждения в центре обработки данных на юге Великобритании (в Лондоне), — говорится в сообщении компании. — Это привело к тому, что часть нашей сервисной инфраструктуры пришлось отключить, чтобы предотвратить неконтролируемые сбои оборудования».

20.07.2022 [00:56], Владимир Мироненко

Из-за жары лондонские дата-центры вынуждены охлаждать оборудование на крыше, поливая его водой из шланговВ этом году в Великобритании наблюдается аномальная жара. 19 июля температура воздуха в стране установила новый рекорд, превысив 40° С. Как сообщает Bloomberg, в некоторых британских ЦОД выбрали оригинальный способ борьбы с перегревом оборудования, используя обрызгивание водой внешних модулей систем кондиционирования, установленных на крыше. По словам Адриана Тревельяна (Adrian Trevelyan), директора по послепродажному обслуживанию компании Airedale International, которая поставляет и обслуживает системы охлаждения для ЦОД, многие лондонские дата-центры вынуждены прибегнуть к такому необычному способу охлаждения. Небольшие ЦОД в густонаселённых городских районах, работающие почти на полную мощность, просто требуют экстренного орошения во время жары. Тревельян сообщил, что орошение позволяет снизить температуру воздуха вокруг змеевиков внешнего контура охлаждения, чтобы они продолжали эффективно рассеивать тепло. Он отказался назвать конкретные компании, применяющие такой способ охлаждения, но сказал, что это делают «в пределах (кольцевой автомагистрали) M25 и в городе». Однако от жары страдают не только малые, но и крупные дата-центры, которые всё же имеют запас по охлаждению ключевых подсистем — 10 июля в лондонском ЦОД AWS произошёл перебой питания из-за так называемого «теплового события» (thermal event). Использование полива шлангами может выручить в очень жаркий день, но негативно отразится на сроке службы оборудования, сообщила София Флюкер (Sophia Flucker), директор консалтинговой фирмы Operational Intelligence, отметив, что если используется вода повышенной жёсткости (как в Лондоне), это может привести к накоплению накипи. Флюкер также рассказала, что многие операторы колокации, сдающие мощности в аренду третьим лицам, сталкиваются со штрафами за несоблюдение температурного режима в машинных залах.

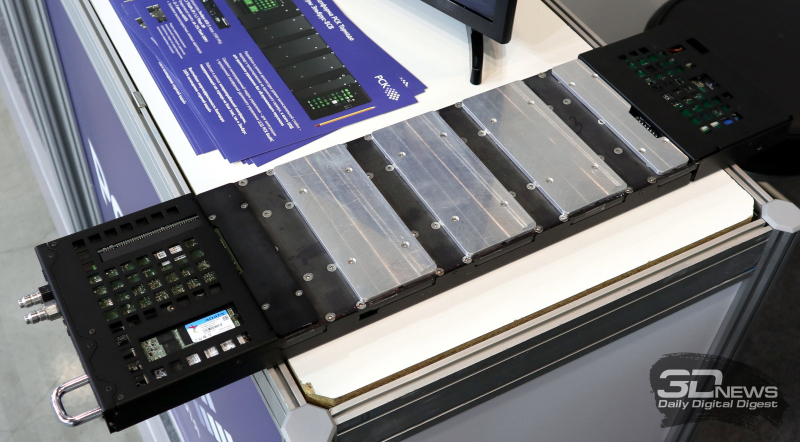

12.07.2022 [00:28], Игорь Осколков

Суперкомпьютер в дорогу: РСК показала на Иннопроме обновлённый мобильный ЦОДГруппа компаний РСК, ведущий российский разработчик суперкомпьютеров и систем для высокопроизводительных вычислений (HPC), дата-центров, облачных платформ и систем хранения данных (СХД) показала на выставке Иннопром-2022 обновлённую версию своей платформы для автономных периферийных вычислений, которая позволяет оперативно, в течение часа силами двух человек, развернуть HPC-кластер практически в любом месте. Решение упаковано в несколько контейнеров (0,7 × 0,7 × 1,1 м), которые можно транспортировать независимо друг от друга и собирать уже на месте. Один контейнер вмещает собственно вычислительную часть, второй — полностью интегрированный модуль распределения теплоносителя с узлом управления, а третий, опциональный — ИБП с инвертором. Дополняет их компактный внешний модуль охлаждения. Вся система имеет весьма солидный запас по возможности отвода тепла — до 60 кВт. Правда, сейчас столько и не требуется. Вычислительный блок фактически является уменьшенной копией платформы «РСК Торнадо»: 2 колонны по 10 слотов. Поэтому мобильная платформа позволяет совмещать в одной системе серверы «Торнадо» с процессорами x86-64 (AMD EPYC и Intel Xeon) и «Эльбрус» (сейчас 8С/8СВ, в перспективе 16С) с любым уровнем TDP, GPGPU-серверы (по два PCIe-ускорителя на сервер, без ограничений по TDP) и серверы хранения (до 12 × M.2 All-Flash). В текущем варианте платформы каждый слот рассчитан на 2 кВт тепловой нагрузки (и столько же по питанию), хотя нынешние серверы укладываются в среднем в 700–800 Вт, а серверы следующего поколения потребуют чуть больше 1 кВт. Подсистема питания имеет два домена, по одному на колонну, и требует однофазный ввод AC 230 В/50 Гц, хотя фактически может работать в диапазоне 105–280 В. Запитать систему можно от генератора, а подстраховать — ИБП. Но возможно и специсполнение с поддержкой 48 В DC. Сетевая подсистема может быть представлена ToR-коммутаторами как двойной (на обе колонны) ширины, так и одиночной. В том числе есть варианты с жидкостным охлаждением. Доступен даже InfiniBand — у Mellanox есть коммутаторы в подходящем форм-факторе, рассчитанные на промышленное применение. Также предоставляется 1 GbE-коммутатор для развёртывания служебной сети. Самая интересная часть — это охлаждение. Как и в «большой» версии платформы здесь используется фирменная СЖО, которая покрывает все компоненты серверов, так что вычислительная часть не требует активного воздушного охлаждения и способна работать даже с закрытыми крышками контейнера. Защиты по какому-либо классу IP в стандартном варианте не предусмотрено, но опять-таки по заказу возможно специсполнение. СЖО всё так же поддерживает охлаждение горячей водой, причём на всех компонентах температура не превышает +45 °C. Для запуска вычислительного модуля необходимо, чтобы он находился в помещении с плюсовой температурой и чтобы не было образования конденсата. А вот внешний контур охлаждения менее прихотлив и способен работать при температурах от -65 °C. Верхний же предел — не менее +40 °C. Требования по питанию у него те же, что и у серверов. Узел управления автоматически отслеживает и регулирует параметры всех компонентов системы во время запуска и работы. По умолчанию используется сценарий защиты оборудования, так что при неблагоприятных условиях серверы могут выключаться. Но возможны и другие сценарии, например, «работа до последнего», когда потеря данных оказывается дороже потери оборудования. Управляется мобильная платформа фирменной системой оркестрации «РСК БазИС», которая позволяет задействовать все возможности компонуемой, программно определяемой инфраструктуры, в том числе для реализации HCI-платформы. «РСК БазИС» предлагает GUI, CLI, открытые API и SDK для интеграции с другими приложениями. Таким образом, заказчик получает полностью интегрированное программно-аппаратное решение, готовое к быстрому развёртыванию и использованию. Изначально платформа создавалась для нужд добывающего сектора, но этой сферой её возможности не ограничиваются. Она также подходит для научных экспедиций и промышленных предприятий (срочная обработка больших массивов данных), медиасферы и обслуживания массовых мероприятий (рендеринг, стриминг с множества камер) и т.д. В общем, везде, где на время требуется действительно мощная, но компактная и удобная в доставке, развёртывании и эксплуатации вычислительная платформа.

17.06.2022 [17:04], Руслан Авдеев

Отголоски Brexit: фондовая биржа Euronext переехала из британского ЦОД в итальянскийФондовая биржа Euronext завершила проект по переносу своего дата-центра из британского Базилдона в кампус IT3 компании Aruba Global Cloud, расположенный в итальянском Бергамо. Миграция планировалась не первый год в связи с несколькими факторами, включая покупку итальянской Borsa Italiana Group, а также Brexit. Компания заявила о наличии «веских оснований» разместить основной дата-центр в стране, где у Euronext имеется большой бизнес. В частности, руководство биржи говорит о предсказуемой нормативной среде — после Brexit перспективы правовых отношений между Великобританией и ЕС остаются неясными. По словам руководства Euronext, миграция мощностей в Италию через год с небольшим после закрытия сделки по приобретению итальянской фондовой биржи Borsa Italiana Group является важной вехой в переносе инфраструктуры на территорию Евросоза. В 2011 году Euronext перенесла ЦОД из Парижа в Лондон, но после приняла решение уйти из Великобритании. Теперь главный ЦОД компании обслуживает 25 % объёмов общеевропейских торгов. Общая площадь дата-центра в Бергамо составит 200 тыс. м2, мощность — 60 МВт. По данным Euronext, новый дата-центр будет полностью запитан от возобновляемых источников, так что будут задествованые солнечная и гидроэнергетика, а также геотермальные источники. В ЦОД используется система динамического естественного охлаждения.

13.06.2022 [16:34], Руслан Авдеев

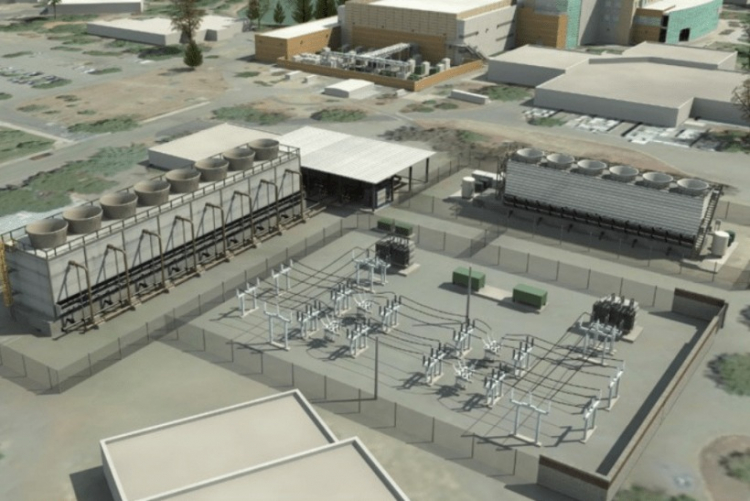

Площадка для будущего 2-Эфлопс суперкомпьютера El Capitan готова: 85 МВт + мощная система охлажденияНациональное управление ядерной безопасности (NNSA) при Министерстве энергетики США официально закончило реконструкцию ЦОД при Ливерморской национальной лаборатории (LLNL) в рамках проекта Exascale Computing Facility Modernization. Обновлены энергетическая система и система охлаждения местного вычислительного центра для использования вычислительных мощностей экзафлопсного уровня. Первой новой действующей системой NNSA станет 2-Эфлопс суперкомпьютер El Capitan, предназначенный для выполнения задач Ливерморской лаборатории, Лос-Аламосской национальной лаборатории и Сандийской национальной лаборатории. По словам представителя NNSA, экзафлопсные вычисления помогут стране в важных, неотложных проектах модернизации вооружений.

Источник изображения: Department of Energy Обновление позволит Ливерморской лаборатории выполнять ресурсоёмкие задачи, 3D-моделирование и симуляцию процессов, связанных с реализацией военных проектов — это необходимо для того, чтобы соответствовать требованиям к сертификации Программы сопровождения ядерного арсенала, реализуемой под эгидой NNSA, основной миссией которой декларируется расширение возможностей американских средств ядерного сдерживания. Сейчас стадия обновления ЦОД завершена и намечен переход к следующим этапам. В результате реализации проекта более, чем удвоилась охлаждающая мощность объекта — теперь он способен ежедневно поглощать количество тепла, достаточного для того, чтобы растопить 28 тыс. тонн льда. Энергетическая мощность ЦОД увеличена с 45 до 85 МВт, а в процессе строительства были обновили линии электропередач, подстанции и управляющее оборудование. Ожидается, что итоговая производительность El Capitan составит более 2 Эфлопс, а потреблять он будет порядка 30–35 МВт. Проработать он должен до 2029 года, однако параллельно будет строиться ещё один суперкомпьютер нового поколения. Некоторые предполагают, что подобные площадки станут последними в своём роде, в первую очередь из-за проблем с электропитанием.

25.05.2022 [16:02], Руслан Авдеев

Microsoft построит в США фабрику Circular Center по переработке серверов и компьютеровКомпания Microsoft подала заявку на строительство специального объекта Circular Center в городке Куинси штата Вашингтон. После ввода в эксплуатацию здесь планируется перерабатывать старые серверы и компьютеры. Городские власти пошли навстречу компании, подтвердив, что проект не должен оказать значительно негативного влияния на окружающую среду. Проект MWH90 CC предусматривает строительство здания площадью 1905 м2 для переработки бывших в эксплуатации компьютеров, серверов и комплектующих. Для этого в Куинси будет расширен и доработан кампус компании, на территории которого уже имеется функционирующий ЦОД. К 2025 году Microsoft планирует перерабатывать 90 % своего облачного оборудования, а к 2030 году этот показатель должен достигнуть 100 %. При этом в докладе за прошлый год упомянуто, что расширение инфраструктуры ЦОД и продажи Xbox привели к росту выбросов класса Scope 3 на 23 % — такие выбросы не являются прямым результатом деятельности компании, но она своей деятельностью косвенно влияет на их объёмы. Новый Circular Center будет очередным из специальных центров, строительство которых началось в 2020 году. В переработку там идут облачные серверы и прочее оборудование, причём некоторые компоненты могут быть использованы заново, перепроданы или перепрофилированы для использования в иных целях. Например, отдельные части могут использоваться даже в электронных игрушках и игровых системах. В 2020 году работу начали три Circular Center в Амстердаме, Дублине и американском Бойдтоне. В компании утверждают, что она уже получила возможность заново использовать 83 % критически важных комплектующих, снизив выбросы на 145 тыс. т. В обозримом будущем планируется строительство ещё нескольких центров аналогичного назначения по всему миру — от США до ЕС и Австралии. Прочие облачные компании, включая Google, Oracle и AWS реализуют похожие проекты, причём часть бывших в употреблении комплектующих используется в инфраструктуре самих компаний, а часть продаётся на вторичном рынке. Так, только Google и только в 2020 году продала 8,2 млн уже использовавшихся компонентов. А ITRenew, известный игрок на рынке утилизации оборудования гиперскейлеров, предлагает б/у серверы для микро-ЦОД и даже для отопления. Похожие решения есть и у Qarnot. Ранее сообщалось, что у Microsoft довольно необычный подход к защите природы. В январе появилась информация, что компания намерена вырубить более 2500 деревьев в Техасе для строительства дата-центра. В качестве компенсации компания обещала высадить более 800 новых и заплатить в фонд защиты деревьев около $1,5 млн.

24.05.2022 [14:09], Андрей Крупин

Selectel приступила к строительству в Москве нового 20-МВт дата-центра на 2 тыс. стоекКомпания Selectel, являющаяся специализированным поставщиком IT-решений на базе собственной сети дата-центров в Москве, Санкт-Петербурге и Ленинградской области, планирует ввести в эксплуатацию ещё один вычислительный комплекс. Новый центр обработки данных под названием «Юрловский» будет развёрнут в Москве и рассчитан на 2 тыс. серверных стоек. Дата-центр проектируется в соответствии с уровнем надёжности Tier IV. Основная ёмкость центра обработки данных будет задействована для предоставления облачных сервисов Infrastructure as a Service (IaaS). Особенностью ЦОД станет самый большой единый машинный зал в России площадью 4500 м2, в котором компания планирует разместить до 80 тыс. серверов. Общая подведённая мощность объекта составит 20 МВт, средняя мощность на стойку — 8 кВт. Selectel уже получила технические условия на подключение к ближайшему питающему центру с верхним уровнем напряжения 500 кВ, который расположен в 700 м от кампуса. Подключение будет выполнено по второй категории надёжности, то есть будет проложено две линии от независимых ячеек на подстанции, а между ними на стороне подстанции будет организован автоматический ввод резерва. Дата-центр «Юрловский» будет построен с применением технологии охлаждения без использования фреоновых систем, что позволит минимизировать воздействие на окружающую среду. ЦОД будет охлаждаться наружным воздухом (технология фрикулинга), а в качестве доохлаждения будут использоваться адиабатические маты. Предполагается, что эти и другие меры позволят Selectel экономить электроэнергию и занимать меньше полезной площади машинного зала. Среднегодовой коэффициент эффективности использования энергии (Power Usage Effectiveness, PUE) будет в диапазоне от 1,1 до 1,15. Таким образом, «Юрловский» станет самым «зелёным» дата-центром Selectel. В инфраструктуре дата-центра «Юрловский» будет задействована схема резервирования 6/5N — для каждой части на 1000 стоек будет выделено пять рабочих кластеров и один резервный. Фактически работать будут все шесть, но один можно в любой момент отключить. Кроме того, такой подход позволяет добиться физической изоляции резервируемых кластеров друг от друга. А автоматизации бесперебойной подачи питания и непрерывное охлаждение обеспечат возможность проводить любые профилактические и ремонтные работы без приостановки оказания услуг. Для поддержания связности новый ЦОД будет подключен несколькими независимым ВОЛС к MSK-IX (M9) и ЦОД «Берзарина», который уже имеется независимые подключения к нескольким IX. Вопрос с закупкой оборудования компания намерена решать в конце текущего года, поскольку в текущей ситуации прогнозировать что-либо затруднительно. На текущем этапе Selectel занимается проектированием и выполняет общестроительные работы. Ввод объекта в коммерческую эксплуатацию запланирован на 2023 год, однако сроки могут быть скорректированы в зависимости от ситуации на рынке. Инвестиции в проект оцениваются в миллиарды рублей.

29.04.2022 [22:04], Алексей Степин

Meta✴ синхронизирует время в своих дата-центрах с помощью модулей Orolia Spectratime на базе рубидиевых атомных часовТакой масштабный проект, как метавселенная, создаваемая ныне Meta✴, будет включать в себя огромное количество серверов в дата-центрах по всей планете, которые будут обслуживать единое виртуальное пространство. Функционирование столь сложного проекта, естественно, не может не зависеть от точной синхронизации часов, и чем точнее этот процесс, тем лучше. С целью обеспечения идеальной точности синхронизации Meta✴ будет использовать в своих серверах «карты времени» Orolia. Они используют открытый протокол и разработаны в сотрудничестве с самой Meta✴. Модули Orolia Spectratime mRO-50 пользуются компактными рубидиевыми атомными часами, чья точность уступает лишь гораздо более дорогим цезиевым собратьям, используемым в качестве первичного стандарта частоты.

Плата Orolia/Meta✴ имеет форм-фактор FHHL и интерфейс PCI Express x4 Благодаря использованию новых плат синхронизации Meta✴ надеется добиться снизить максимальное расхождение часов в разных ЦОД до уровня менее 100 мкс. Ранее Meta✴ удалось снизить этот параметр с 10 мс до 100 мкс благодаря использованию сигналов GNSS. В 2021 году был показан прототип PCIe-адаптера, которым компания поделилась с инициативой Time Appliance Project (TAP), действующей в рамках Open Compute Project (OCP).

Модуль рубидиевых атомных часов Orolia mRO-50 На основе разработок Meta✴ Time Card в итоге и был создан адаптер точного времени Orolia ART Card. Сейчас пришло время для второго поколения, которое получило название ART2. Сам модуль Orolia Spectratime mRO-50 генерирует стабильный сигнал частотой 10 МГц, отклонения которой не превышают 4×10-10 при изменении температуры и 1×10-11 в день в процессе трёхмесячной эксплуатации.

29.04.2022 [21:35], Руслан Авдеев

Новые дата-центры Meta✴ для метавселенной будут построены из «зелёного» бетона, созданного с помощью ИИКомпания Meta✴ приступила к расширению кампуса дата-центров DeKalb в штате Иллинойс (США), которые, как предполагается, будут применяться для дальнейшего развития метавселенной. Для того, чтобы разработать материал для новых построек, Meta✴ прибегла к помощи искусственного интеллекта — специально подобранные «зелёные» компоненты позволят частично заменить традиционный бетон. Цемент является основой множества современных строительных материалов, применяемых в промышленных масштабах — по имеющейся статистике на его производство приходится порядка 8 % всех углеродных выбросов в мире. Для того, чтобы создать более приемлемую для экологии альтернативу, Meta✴ объединила усилия с Университетом Иллинойса в Урбане-Шампейне (UIUC), Массачусетским технологическим институтом (MIT) и IBM.

Источник изображения: tech.fb.com При участии системы искусственного интеллекта была обработана база данных со сведениями о характеристиках и компонентах бетонов. В результате проведённой работы была подобрана смесь летучей золы и шлака, способная частично заменить классический цемент. Полученные данные были переданы поставщику бетона — компании Ozinga, которая оптимизировала смесь исходя из своего опыта и доступности материалов, сохранив при этом необходимую прочность. Новый «зелёный» бетон, по оценкам Meta✴, обеспечивает на 40 % меньший углеродный выброс при создании. Помимо двух уже строящихся зданий для кампуса будут построены ещё три с использованием новых технологий. По имеющимся сведениям, новую смесь уже применили при строительстве второстепенных объектов. Общая площадь зданий ЦОД составит более 222 тыс. м2.

Источник изображения: tech.fb.com Как и многие штаты, Иллинойс предложил в 2019 году налоговые льготы на ЦОД-оборудование для привлечения операторов. Meta✴ так и не воспользовалась данными преимуществами, но от послаблений при расчётах налога на собственность не отказалась. После введения объектов в эксплуатацию новые ЦОД не только будут способствовать расширению метавселенной, но и обеспечат работой более 200 человек. На момент первого анонса проекта Meta✴ обещала, что кампус будет использовать 100 % возобновляемой энергии, а строения получат золотой сертификат Leadership in Energy and Environmental Design (LEED) за экологическую безопасность конструкции. Общий объёмы инвестиций в кампус в Иллинойсе составят более $1 млрд. Ранее сообщалась, что Meta✴ активно наращивает инвестиции в строительство ЦОД и сетевую инфраструктуру по всему миру. |

|