Материалы по тегу: cloud

|

29.04.2026 [15:46], Владимир Мироненко

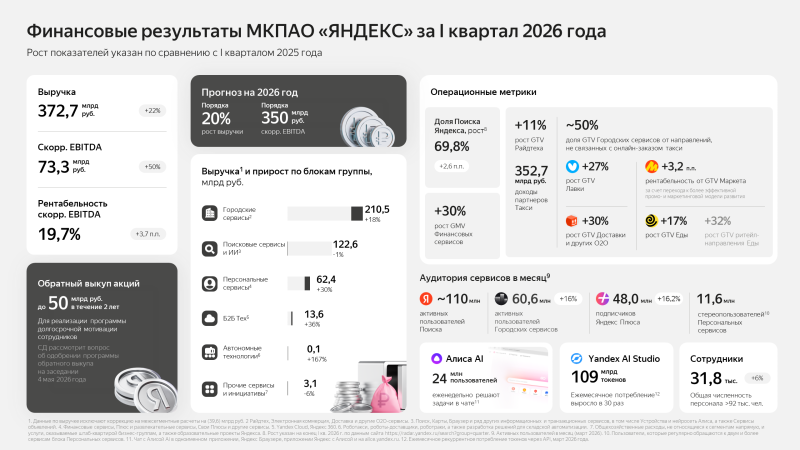

Yandex B2B Tech увеличила выручку на 36 % на фоне растущего спроса на ИИ-решения«Яндекс» сообщила финансовые результаты за I квартал 2026 года. Выручка компании выросла на 22 % год к году до 372,7 млрд руб. Скорректированная чистая прибыль увеличилась в 2,7 раза, составив 34,7 млрд руб., скорректированный показатель EBITDA — в 1,5 раза до 73,3 млрд руб., составив 19,7 % от выручки (рост — на 3,7 п.п.). Выручка бизнес-блока «Б2Б Тех» (Yandex B2B Tech) выросла на 36 % год к году до 13,6 млрд руб. Как отметила компания, росту способствовало продолжающееся расширение клиентской базы и увеличение объёма потребления сервисов в корпоративном сегменте. Важную роль играет и растущий спрос на ИИ-решения, а также развитие сервисов безопасности, инструментов для работы с данными и решений для автоматизации бизнес-процессов. Скорректированный показатель EBITDA вырос на 49 % год к году до 2,6 млрд руб. на фоне увеличения доли PaaS- и SaaS-решений в выручке. Компания прогнозирует дальнейший рост маржинальности во II половине года. «Яндекс» сообщила, что аудитория Yandex Cloud выросла до 60 тыс. клиентов. Более трети крупнейших компаний России из рейтинга РБК‑500 используют для работы цифровых сервисов технологии Yandex Cloud. При этом более половины корпоративных клиентов Yandex Cloud из крупного и среднего сегмента используют её решения для обеспечения информационной безопасности. Всего на крупные компании приходится больше половины совокупной выручки направления. Одним из ключевых драйверов роста Yandex Cloud компания назвала платформу для разработки ИИ-агентов и приложений Yandex AI Studio. Ежемесячное рекуррентное потребление токенов через API на ней увеличилось примерно в 30 раз год к году до 109 млрд токенов в марте 2026 года. На платформе было создано более 16 тыс. ИИ-агентов, на которые в марте 2026 года приходилось 29 % всего клиентского потребления в Yandex AI Studio. Также компания отметила, что ИИ- и ИБ-сервисы остаются фокусными направлениями бизнеса. Выручка от них выросла в два раза год к году. По второму направлению — «Яндекс 360» — у компании насчитывается 175 тыс. организаций-клиентов. Общее количество платных учётных записей «Яндекс 360» выросло до 8,3 млн на конец I квартала 2026 года. Аудитория «Яндекс Телемоста» выросла в три раза год к году, превысив 8,3 млн пользователей. Также сообщается, что «Яндекс 360» продолжает внедрять ИИ и расширять список сервисов, доступных по модели on-premise. Компания сообщила, что сохраняет прогноз на 2026 год: рост выручки порядка 20 % год к году и скорректированный показатель EBITDA порядка 350 млрд руб. Уровень капитальных затрат в 2026 году, как ожидается, составит 10-12 % от выручки, что соответствует среднегодовому значению за последние пять лет — 11 % от выручки.

16.04.2026 [15:12], Андрей Крупин

Yandex B2B Tech и SolidLab разработали решение для киберзащиты ИИСовместное предприятие Yandex B2B Tech и SolidLab представило SolidWall AI Security Gateway — решение для защиты приложений на базе искусственного интеллекта и используемых ими программных интерфейсов (API). SolidWall AI Security Gateway выступает барьером между внешней сетью и ИИ‑приложением. Продукт отслеживает, какие данные передаются в ИИ-системы, и защищает от основных видов атак на ИИ-приложения из перечней OWASP LLM Тор-10 Risks и OWASP Тор-10 for Agentic Applications, в том числе от атак инъекций запросов к большим языковым моделям (prompt injection), нарушения ограничений LLM (jailbreak), утечек чувствительной информации. В дополнение к этому решение обеспечивает контроль действий пользователей на основе анализа и хранения легитимных транзакций, а также использования механизмов контроля бизнес-логики.

Источник изображения: Bolivia Inteligente / unsplash.com В числе прочих отличительных особенностей SolidWall AI Security Gateway разработчиком отмечаются возможность интеграции с SIEM-системами и аналитическими платформами с помощью механизмов Syslog, SQL, REST API, средства загрузки спецификаций OpenAPI в качестве действий модели бизнес-логики, модуль интеграции со сканером защищённости приложений SolidPoint и возможность мониторинга работоспособности программных и аппаратных компонентов с использованием систем мониторинга Zabbix и Prometheus. SolidWall AI Security Gateway можно развернуть в инфраструктуре заказчика или использовать по облачной модели. По данным Gartner, в 2025 году 29 % организаций столкнулись с атаками на инфраструктуру корпоративных ИИ-приложений, а 32 % — на сами приложения. На этом фоне компании начинают выделять защиту ИИ-сервисов в отдельное направление информационной безопасности.

08.04.2026 [22:38], Владимир Мироненко

Alibaba и China Telecom запустили ИИ-кластер на базе 10 тыс. ИИ-ускорителей ZhenwuAlibaba объявила о развёртывании в сотрудничестве с мобильным оператором China Telecom вычислительного ИИ-кластера из 10 тыс. ИИ-ускорителей Zhenwu, разработанных подразделением Alibaba T-Head. По словам Alibaba Cloud, передовые вычислительные мощности Китая «переходят от высокопроизводительных прорывов к крупномасштабному промышленному внедрению». ИИ-кластер размещён в дата-центре оператора China Telecom в Шаогуане (Shaoguan, провинция Гуандун). Как отметило облачное подразделение Alibaba, этот «полностью отечественный» кластер стал первым проектом такого масштаба на базе чипов Zhenwu в районе Большого залива (Greater Bay Area, GBA) — одном из ключевых стратегических регионов в планах национального развития Китая. По данным Alibaba Cloud, новый кластер обеспечивает сверхнизкую задержку в 4 мс и позволяет 10 тыс. чипам работать как единая система, способная обучать ИИ-модели с сотнями миллиардов параметров. China Telecom и Alibaba заявили, что вычислительный ИИ-кластер может использоваться в различных отраслях, от здравоохранения до разработки передовых материалов. Также сообщается, что в дальнейшем он будет расширен до 100 тыс. чипов. Запуск ИИ-кластера на базе чипов Zhenwu является ещё одним свидетельством того, что Китай удваивает усилия по развитию собственной инфраструктуры для ускорения быстро развивающихся ИИ-технологий и удовлетворения растущего спроса на фоне обострения конкуренции в области ИИ с американскими соперниками, включая Meta✴, Microsoft и xAI, пишет South China Morning Post. Объявление Alibaba о создании ИИ-кластера последовало за запуском в конце прошлого месяца первого в стране интеллектуального вычислительного кластера на базе 10 тыс. чипов Huawei Ascend 910C общей ИИ-производительностью 11 Эфлопс в Шэньчжэне (Shenzhen, провинция Гуандун). В прошлом году компания запустила ИИ-кластер с производительностью 3 Эфлопс. По данным Shenzhen Special Zone Daily, почти 50 организаций подписали рамочные соглашения на использование вычислительных мощностей нового кластера, в результате чего общий уровень бронирования по обоим кластерам достиг 92 %.

01.04.2026 [21:02], Владимир Мироненко

У Huawei на порядок замедлился рост выручки по итогам 2025 годаКомпания Huawei Technologies сообщила финансовые результаты за 2025 год. Выручка компании выросла по сравнению с 2024 годом на 2,2 % до ¥880,9 млрд ($127,5 млн), что является резким замедлением темпов её роста, поскольку в 2024 году рост выручки составил 22,4 %. Чистая прибыль за 2025 год составила ¥68 млрд ($9,9 млрд), что на 8,7 % больше, чем в 2024 году (¥62,6 млрд). Объём выручки в 2025 году стал вторым по величине в истории Huawei, уступая рекордному показателю в ¥891 млрд, достигнутому в 2020 году. Бизнес Huawei по производству смартфонов столкнулся с резким падением после введения санкций США, ограничивших доступ к передовым чипам и ОС Android от Google, что привело к снижению общей выручки на 29 % в 2021 году. 2025 год стал четвёртым годом подряд роста выручки после того спада.

Источник изображения: Huawei Общая выручка от облачных услуг выросла на 4,8 % до ¥72,8 млрд ($10,6 млрд), в то время как выручка этого подразделения от внешних клиентов упала на 3,5 % до ¥32,16 млрд ($4,7 млрд). Компания является вторым по величине поставщиком облачных услуг в материковом Китае. При этом Alibaba, крупнейший поставщик услуг облачных вычислений по доле рынка в материковом Китае, сообщил о росте выручки Alibaba Cloud на 36 % до ¥43,28 млрд ($6,3 млрд) в 2025 году. Tencent заявила, что рост доходов от облачных сервисов внутри страны и за рубежом способствовал увеличению выручки от бизнес-услуг на 22 % в годовом исчислении в 2025 году. Слабый рост доходов от облачных сервисов Huawei наблюдается на фоне быстрого расширения отрасли во всём мире и замедления экономического роста в Китае, отметил ресурс CNBC. По данным Omdia, в глобальном масштабе расходы на облачные инфраструктурные услуги выросли на 29 % в IV квартале 2025 года, что стало шестым подряд кварталом роста рынка более чем на 20 %. Аналитическая компания прогнозирует рост затрат на облачные вычисления в 2026 году на 27 %.

Источник изображения: Huawei В сегменте потребительской электроники выручка Huawei в прошлом году выросла на 1,6 % до ¥344,47 млрд ($50,1 млрд), тогда как годом ранее рост составил 38,3 %. Сегмент ИКТ — крупнейший источник дохода — показал рост продаж на 2,6 % до ¥375 млрд ($54,6 млрд) по сравнению с 4,9 % роста в 2024 году. Подразделение интеллектуальных автомобильных решений, которое помогает традиционным автопроизводителям разрабатывать «умные» автомобили, показало рост выручки на 72,1 % до ¥45 млрд ($6,6 млрд), тогда как в 2024 году рост составил 474,4 %. Расходы Huawei на НИОКР выросли до ¥192,3 млрд ($28,0 млрд) в 2025 году, что составляет 21,8 % от годовой выручки компании, поскольку она активно инвестировала в ПО и вычислительные решения, предназначенные для использования в ИИ-системах, пишет AFP News.

31.03.2026 [14:48], Руслан Авдеев

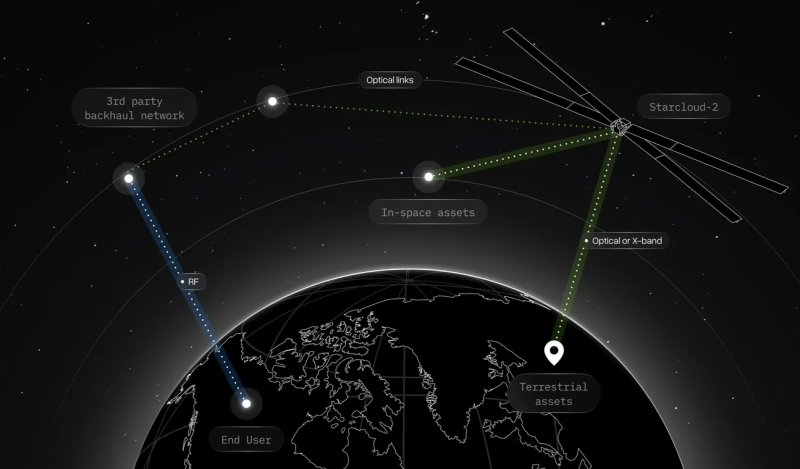

Разработчик космических ЦОД Starcloud привлёк $170 млн, став «единорогом» всего за полтора годаStarcloud, занимающаяся созданием космических ЦОД, привлекла $170 млн в рамках раунда финансирования Series A при оценке капитализации на уровне $1,1 млрд. Участнице бизнес-акселератора Y Combinator удалось добиться статуса «единорога» через 17 месяцев после первой презентации. Пока это самый быстрорастущий стартап в истории Y Combinator, сообщает HPC Wire. Раунд возглавили Benchmark и EQT. Статус «единорога» обычно получают компании с капитализацией выше $1 млрд, при этом ещё не вышедшие на биржу и не принадлежащие крупным корпорациям. Общий объём привлечённого компанией капитала увеличился до $200 млн. Новые средства позволят быстро масштабировать орбитальную инфраструктуру и удовлетворить спрос на экобезопасные ИИ-мощности, говорит компания. Новые инвестиции ускорят проектирование и строительство спутников нового поколения Starcloud-3, создание специализированного производства, расширение штата и заключение новых контрактов на вывод ЦОД в космос. Поскольку ИИ стимулирует спрос на вычислительные мощности, наземной инфраструктуры для него не всегда достаточно, тем более что на получение разрешений на строительство новых ЦОД и получение электропитания может уйти до пяти лет. Starcloud предложила обойти эти ограничения, построив ЦОД на низкой околоземной орбите с доступом к практически неограниченной солнечной энергии.

Источник изображения: Starcloud Starcloud запустила первый спутник Starcloud-1 с NVIDIA H100 на борту в ноябре 2025 года — он приблизительно в 100 раз производительнее всех предыдущих вычислителей на орбите. Компания первой дообучила ИИ-модель в космосе и успешно запустила инференс LLM Gemini. Имея всего $3 млн предварительного финансирования, Starcloud спроектировала, построила и запустила первый спутник за рекордный срок — всего 21 мес. В конце 2026 года ожидается запуск спутника Starcloud-2. Его оснастят самым крупным коммерческим радиатором из когда-либо отправленных в космос, а сам спутник получит в 100 раз больше энергии в сравнении со Starcloud-1. Starcloud-2 станет первым спутником компании, выполняющим коммерческие периферийные и облачные вычисления. Первым клиентом стала Crusoe, также заключены партнёрства с AWS, Google Cloud и NVIDIA. Раунд финансирования прошёл в два этапа. Первый и основной возглавила Benchmark (при участии EQT), дополнительный второй этап совместно возглавили оба инвестора. EQT представляет собой второй по величине фонд прямых инвестиций в мире, управляющий активами стоимостью более $100 млрд. Компания владеет более 70 ЦОД. Benchmark — один из наиболее успешных в мире фондов венчурных инвестиций. В новом раунде финансирования спрос значительно превысил предложение. В нём также приняли участие крупнейший в мире инфраструктурный фонд Macquarie Capital, фондв NFX, Nebular, Y Combinator, Adjacent, 776 Ventures, Fuse Ventures, Manhattan West, Monolith Power Systems и частные инвесторы. Помимо прочих, в космосе желают разместить огромное количество микро-ЦОД компании SpaceX и Blue Origin.

27.03.2026 [00:07], Андрей Крупин

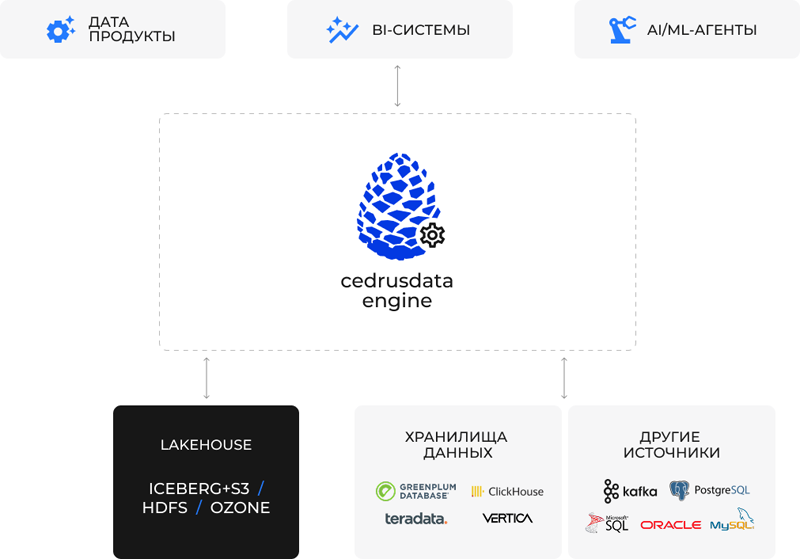

VK Tech усилила дата-направление технологиями CedrusDataПоставщик корпоративного программного обеспечения VK Tech (входит в экосистему VK) и разработчик решений для работы с большими данными CedrusData объявили о сотрудничестве. Сделка направлена на развитие и усиление продуктовой линейки VK Tech в области хранения, обработки, анализа данных и систем искусственного интеллекта. VK Tech развивает lakehouse-платформу VK Data Platform на базе S3-совместимого хранилища VK Object Storage и колоночной базы данных Tarantool Column Store. Интеграция CedrusData усилит её за счёт высокопроизводительного массивно-параллельного SQL-движка CedrusData Engine и каталога метаданных CedrusData Catalog с поддержкой открытого табличного формата хранения и обработки больших массивов данных Apache Iceberg.

Источник изображения: cedrusdata.ru По словам партнёров, объединённое решение позволит сформировать единый стек хранения/обработки данных и обеспечит взаимодействие с ними без дублирования информации и реализации сложных процессов ETL (Extract, Transform, Load). Такая архитектура позволит клиентам эффективно управлять цифровыми активами любого объёма, обеспечивая мгновенный доступ к аналитике и строгий порядок в структуре хранения как в облаке (On-Cloud), так и в периметре организации (On-Premise). В результате клиенты получат масштабируемую lakehouse-платформу для работы с данными любого объёма с единым управлением, высокой производительностью и готовностью к AI/ML-нагрузкам.

26.03.2026 [15:36], Андрей Крупин

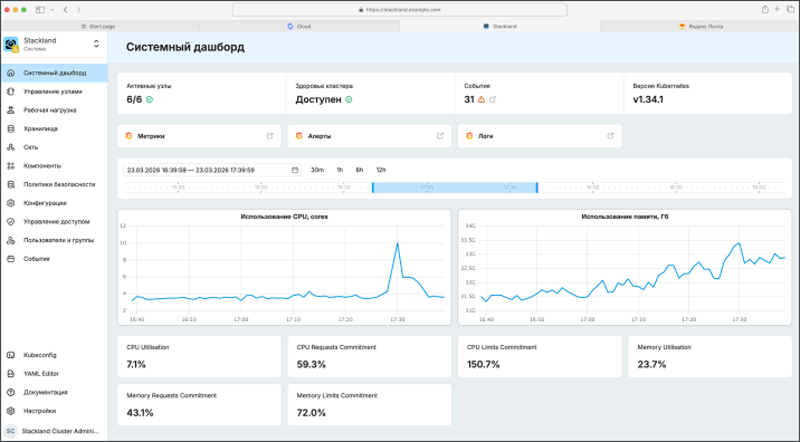

Yandex B2B Tech запустила Cloud Stackland — платформу контейнеризации с интегрированными PaaS‑сервисами Yandex CloudYandex B2B Tech (бизнес-группа «Яндекса», объединяющая технологии и инструменты компании для корпоративных пользователей, включая продукты Yandex Cloud и «Яндекс 360») вывела на рынок Cloud Stackland. Yandex Cloud Stackland представляет собой инфраструктурное решение со встроенными управляемым сервисами Yandex Cloud, предназначенное для развёртывания в закрытом контуре организации и объединяющее все необходимые компоненты для централизованного управления микросервисными и ИИ‑приложениями. Платформа поставляется со встроенными управляемыми базами данных, контейнерным оркестратором и объектным хранилищем. Для работы с ИИ-нагрузками предусмотрены инструменты управления доступом к графическим ускорителям для задач инференса. Также в продукт интегрированы средства безопасности и ограничения доступа разработчиков к тем или иным проектам.

Источник изображения: Yandex B2B Tech / yandex.cloud Cloud Stackland позволяет не только разворачивать и настраивать среду для разработки продуктов, но и быстро внедрять сервисы Yandex Cloud. Уже сейчас на платформе доступны инструмент для речевой аналитики Yandex SpeechSense и BI-система Yandex DataLens. В ближайшее время добавятся ещё несколько решений, в том числе флагманский продукт «Яндекса» для разработки ИИ-приложений и агентов — Yandex AI Studio. Платформа зарегистрирована в реестре отечественного ПО и находится в процессе сертификации по четвёртому уровню ФСТЭК России.

24.03.2026 [23:10], Владимир Мироненко

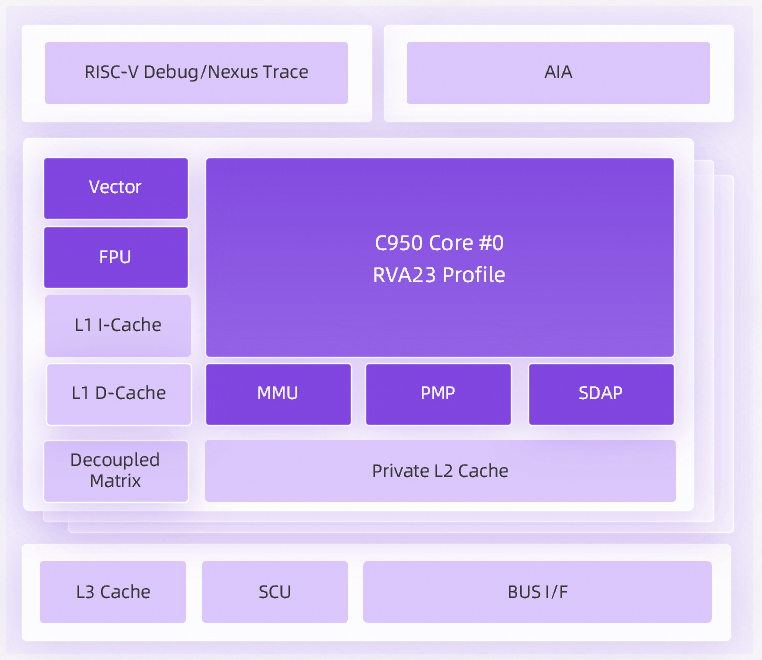

Alibaba представила самый производительный в мире процессор на базе RISC-V — XuanTie C950Alibaba представила серверный процессор XuanTie C950 с частотой 3,2 ГГц, созданный на основе открытой архитектуры RISC-V и изготовленный по 5-нм техпроцессу, сообщил ресурс SCMP. Как заявила компания, процессор оптимизирован для облачных вычислений и ИИ-нагрузок, и сможет обрабатывать многоэтапные задачи, выполняемые ИИ-агентами. По словам компании, это «самый высокопроизводительный процессор с архитектурой RISC-V в мире». Мэн Цзяньи (Meng Jianyi), главный научный сотрудник DAMO Academy, исследовательского подразделения Alibaba, заявил, что производительность C950 более чем в три раза больше, чем у C920 прошлого поколения. «Открытая природа RISC-V позволяет разработчикам микросхем настраивать наборы инструкций и ускорять выполнение конкретных задач ИИ без или с низкими лицензионными сборами. Это особенно важно для разработки ИИ-агентов», — приводит Reuters сообщение компании.

Источник изображения: Alibaba Подразделение DAMO Academy, разработавшее дизайн чипа, сообщило, что XuanTie «могут быть настроены под конкретные шаблоны инференса, помогая клиентам адаптировать чипы под свои нужды». Alibaba добавила, что по сравнению с некоторыми массовыми продуктами её процессор обеспечивает более чем 30 % «улучшение производительности благодаря гибкости в настройке для конкретных сценариев использования». На разработку C950 потребовалось два года, и это первый чип в линейке XuanTie, разработанный с нуля с учётом выполнения инференса LLM как базовой рабочей нагрузки. Предыдущий серверный чип, C930, был представен в феврале 2025 года, его поставки стартовали спустя месяц. Его предшественник, C920, поставляется с 2024 года. XuanTie C950 — это 64-бит процессор с декодером шириной 8 инструкций и 16-стадийным конвейером, предсказателем ветвлений TAGE и настраиваемым механизмом предвыборки, соответствующий профилю RVA23 и дополненный некоторыми другими инструкциями. Заявленная производительность в SPECint2006 составляет 22/ГГц. Чип включает 256-бит векторные регистры и поддержку FP16/BF16/FP32/FP64/INT8/INT16/INT32/INT64. Типовой объём кеша инструкций составляет 64 Кбайт с опциональной проверкой чётности, кеша данных — тоже 64 Кбайт, ECC опционально. L2-кеш собственный у каждого ядра — типовой объём составляет 1 Мбайт, ECC опционально. Типовой кластер состоит из 8 ядер. Для внутренней связи используется шина CHI.E/CHI.F, для внешней — AMBA ACE4.0/AXI4.0. Благодаря совместной оптимизации программного и аппаратного обеспечения, C950 обеспечивает высокую производительность в облачных вычислениях, включая запуск MySQL, Redis, Nginx и OpenSSL, инференс больших языковых моделей, включая Qwen и DeepSeek, а также при использовании вместе с разработанными компанией интегрированными ИИ-движками — Alibaba Vector Acceleration Engine и Matrix Acceleration Engine. Оба движка разработаны совместно с CPU-ядрами, а не «прилеплены» к ним. C950 — первый процессор RISC-V, который изначально поддерживает инференс LLM с миллиардом параметров на аппаратном уровне, утверждает компания. Расширения набора инструкций и аппаратные блоки разработаны для выполнения основных операций таких моделей, как Qwen3 и DeepSeek V3, без накладных расходов. C950 является флагманом портфолио чипов Alibaba.

21.03.2026 [13:15], Владимир Мироненко

Alibaba сообщила об отгрузке 470 тысяч чипов, признав, что они пока уступают решениям NVIDIA и AMDКитайская технологическая компания Alibaba Group Holding сообщила финансовые результаты III квартала 2026 финансового года, закончившегося 31 декабря 2025 года. В ходе телефонной конференции по итогам квартала, генеральный директор Alibaba У Юнмин (Wu Yongming), также известный как Эдди У (Eddie Wu), сообщил, что по состоянию на февраль 2026 года совокупный объём поставок чипов собственного производства достиг 470 тыс. ед., а годовая выручка от их продаж превысила ¥10 млрд. У Юнмин также сообщил о 36-% росте квартальной выручки облачного подразделения Alibaba Cloud, поскольку спрос на ИИ-сервисы резко возрос, а компания ускорила усилия по монетизации своих инвестиций в ИИ. Он отметил, что выручка от продуктов, связанных с ИИ, демонстрирует трехзначный рост в годовом исчислении уже десятый квартал подряд. Потребление токенов на публичном рынке MaaS (модель как услуга) на платформе Bailian MaaS за последние три месяца увеличилось в шесть раз. Как пишет ресурс The Register, гендиректор Alibaba не уточнил разбивку по поставкам наименований чипов. Разработкой и производством чипов занимается собственное подразделение Alibaba — T-Head Semiconductor (Pingtouge Semiconductor). Ресурс сообщил, что T-Head создало несколько чипов, включая, по крайней мере три чипа, предназначенных для рабочих ИИ-нагрузок, в том числе XuanTie C908, TH1520 для периферийного ИИ и Pingtouge Zhenwu 810E. Последний дебютировал в январе и, как считается, может конкурировать с NVIDIA H20, урезанной версией ускорителя на базе архитектуры Hopper 2023 года. Если речь идёт только о 810E, то 470 тыс. отгруженных с января чипов впечатляют, поскольку это ставит темпы производства Alibaba на один уровень с NVIDIA, отметил The Register. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) в прошлом году заявил, что компания отгрузила 6 млн ускорителей с архитектурой Blackwell за год. Как пишет EE Times China, согласно данным, опубликованным на официальном сайте Pingtouge, GPU Zhenwu 810E полностью разработан собственными силами, как в программном, так и в аппаратном отношении, и демонстрирует производительность, сравнимую с NVIDIA H20 и превосходящую A800 и другие популярные отечественные GPU. Он уже развёрнут в нескольких кластерах на платформе Alibaba Cloud, обслуживающей таких клиентов, как Государственная электросетевая компания, Китайская академия наук, XPeng Motors, Sina Weibo и др. Chinastarmarket.cn со ссылкой на гендиректора Alibaba пишет, что производственные мощности по выпуску высококачественных ИИ-чипов планируется расширить в 2026–2027 гг. По словам гендиректора, продукция T-Head пользуется высоким спросом у внешних коммерческих клиентов, на которых приходится более 60 % поставок чипов. А ИИ-чипы компании используют для обработки ИИ-нагрузок более 400 корпоративных клиентов из различных сегментов, включая интернет, финансовые услуги, автономное вождение и интеллектуальное производство.

Источник изображения: T-Head У Юнмин подчеркнул: «В ближайшие 3–5 лет глобальные вычислительные мощности для ИИ будут крайне дефицитными. Будучи единственной компанией на китайском рынке облачных вычислений, способной разрабатывать собственные чипы, T-Head имеет решающее значение для Alibaba Group». Отметим, что Huawei давно разрабатывает собственные ускорители Ascend и имеет облачное подразделение Huawei Cloud. Вместе с тем У Юнмин признал, что чипы компании пока не могут конкурировать с ускорителями NVIDIA и AMD. «Учитывая, что наши чипы по-прежнему отстают от зарубежных аналогов по производительности в различных аспектах, мы стремимся к более глубокому сотрудничеству с облачной инфраструктурой Alibaba и моделью Qwen для повышения экономической эффективности, — сообщил гендиректор. — Это одно из ключевых отличий и наш подход к проектированию чипов в T-Head, которое выделяет нас среди других компаний-производителей чипов. Наша главная цель — создание возможностей для ИИ, обеспечивающих превосходное соотношение цены и качества». Он отметил, что разработка собственных чипов гарантирует Alibaba «достаточное количество вычислительных мощностей для ИИ», что, по его словам, необходимо, учитывая «уникальные обстоятельства, с которыми в настоящее время сталкивается индустрия ИИ в Китае» — вероятно, имея в виду экспортные ограничения США касательно поставок в Китай передовых ускорителей. У Юнмин также выразил мнение, что разработка собственной технологической платформы поможет Alibaba снизить затраты на инференс, и это позволит облачной платформе получать значительную прибыль по мере роста спроса на ИИ. В ответ на слухи в отрасли о возможном выделении T-Head в отдельную компанию и проведении IPO, У Юнмин заявил: «T-Head не исключает проведения IPO в будущем, но чётких сроков пока нет». В ходе телефонной конференции Alibaba объявила о своих бизнес-целях в рамках стратегии в области ИИ: достичь в течение следующих пяти лет годового дохода более $100 млрд от коммерциализации облачных технологий и ИИ, включая MaaS. Отметим, что в минувшем квартале выручка Alibaba Cloud составила $6,2 млрд. У Юнмин сообщил, что основными драйверами роста Alibaba станут три области. Во-первых — сервисы MaaS. Рост, обусловленный инициативами MaaS, как ожидается, станет ключевым фактором роста будущей выручки как для ИИ, так и для облачных сервисов. Во-вторых, в значительном числе крупных, средних и малых предприятий будет расти спрос на внутреннее обучение и инференс на корпоративном уровне — это новый рынок. «В-третьих, есть ещё один важный фактор, важная возможность, которую, как мне кажется, часто игнорируют. Я говорю об облачных вычислениях, ориентированных на ЦП, о традиционных облачных вычислениях, которые всё ещё имеют значительный потенциал для расширения в эпоху ИИ», — сообщил глава компании. Согласно его прогнозу, в будущем могут появиться миллиарды агентов, созданных большими ИИ-моделями и их операционными средами. Операционные среды этих агентов также потребуют существенной поддержки со стороны традиционных облачных вычислений. Им нужны традиционные CPU, базы данных, хранилища и большие объёмы памяти для поддержки долгосрочного решения проблем и устойчивой работы. Задача состоит в трансформации традиционного рынка облачных вычислений, в переходе от облачной платформы, разработанной для пользователей-людей, ИТ-инженеров, к платформе, оптимизированной для вызова на основе агентов. «Я считаю, что здесь есть огромный потенциал для роста», — заявил У Юнмин. «Ключевой задачей для нас в этом году является трансформация традиционных облачных вычислений в платформу, которая лучше подходит для использования агентами. Это ключевой аспект обновления Alibaba Cloud», — добавил он.

13.03.2026 [23:19], Владимир Мироненко

VK Tech нарастила выручку в 2025 году на 38,0 %, а облако VK Cloud — на 13,5 %Разработчик корпоративного программного обеспечения VK Tech (входит в экосистему VK) опубликовал аудированные финансовые результаты за 2025 год. Выручка компании выросла на 38,0 % год к году — до 18,8 млрд руб. Наиболее высокий рост показали сервисы продуктивности VK WorkSpace (+75,1 % год к году) и бизнес-приложения (+65,7 % год к году). Компания сообщила, что рекуррентная (не связанная с оказанием единоразовых услуг клиентам) выручка выросла более чем в два раза год к году — до 12,8 млрд руб. (68 % от общего объёма выручки), что связано как с увеличением количества клиентов, использующих сервисы по модели On-Cloud, так и с ростом выручки от технической поддержки в рамках модели поставки On-Premise. Скорректированная EBITDA увеличилась на 21,6 % — до 4,8 млрд руб., рентабельность по скорректированной EBITDA составила 26 %. Количество клиентов выросло в 2,7 раза — до 31,9 тыс. VK Tech отметила, что среди них есть крупные, средние и малые компании из всех отраслей экономики. Выручка облачной платформы VK Cloud, объединяющей более 50 облачных сервисов для разработки и работы с данными в рамках направления «Облачная платформа», выросла на 13,5 % — до 6,5 млрд руб., в том числе выручка от продаж по модели On-Cloud увеличилась на 51,3 %. Выручка направления «Дата-сервисы» увеличилась на 15,5 % год к году — до 2,5 млрд руб., в том числе выручка от продаж в формате On-Premise — на 16,1 %. Драйвером роста стали решения Tarantool и VK Data Platform, выручка от которых увеличилась на 61,8 %. Компания отметила, что в 2025 году был запущен первый в России облачный Data Lakehouse. Также была представлена новая версия Tarantool DB 3.0 с механизмом «охлаждения данных», а решение для обработки и хранения данных Tarantool подтвердило соответствие требованиям ФСТЭК России (№ 11). VK Tech в 2026 году усилит направление дата-сервисов за счёт ИИ-сервисов и инструментов аналитики больших данных на базе решений VK Predict, которые включают сервисы аналитики и системы поддержки принятия решений на основе анализа больших данных, технологий машинного обучения и ИИ. |

|