Материалы по тегу: охлаждение

|

01.12.2022 [18:11], Сергей Карасёв

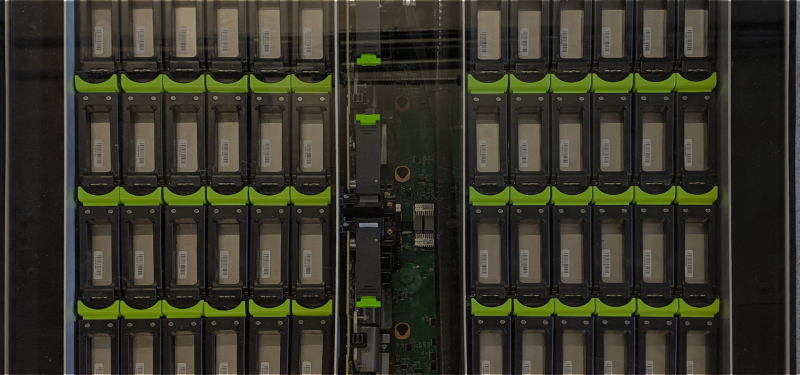

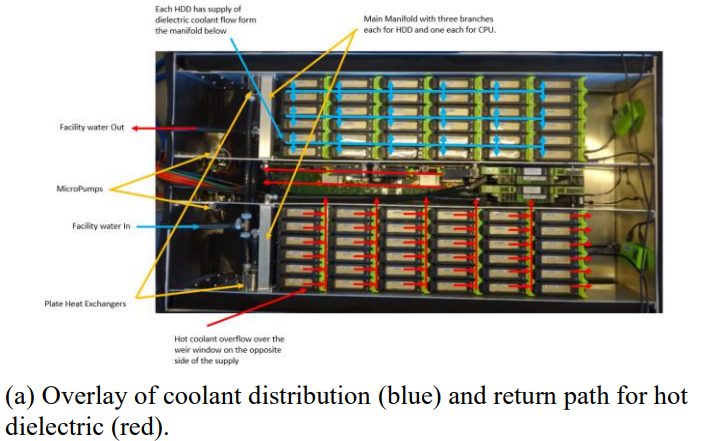

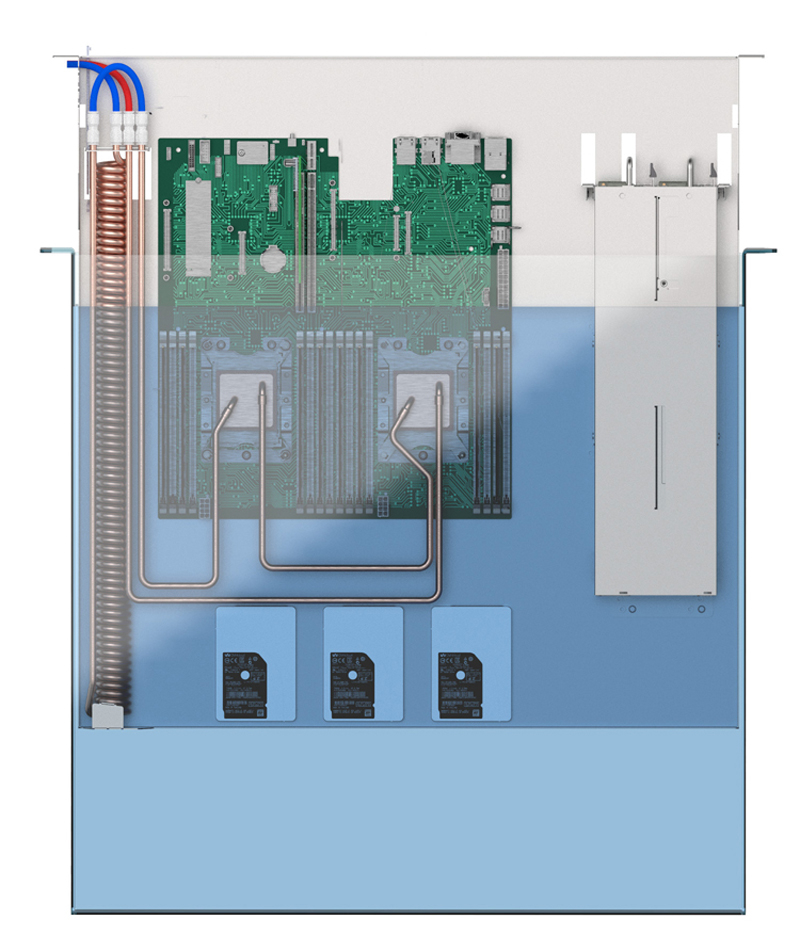

Iceotope и Meta✴ показали возможность иммерсионного охлаждения HDDКомпании Iceotope и Meta✴ продемонстрировали возможность иммерсионного (погружного) охлаждения систем хранения данных (СХД) на основе HDD. В ходе эксперимента было показано, что такой подход обеспечивает ряд преимуществ перед традиционным воздушным охлаждением. В тесте использовалась стандартная коммерческая СХД высокой плотности формата 4OU, содержащая 72 жёстких диска, два односокетных серверных узла, две платы расширения SAS, сетевую карту, модуль распределения питания и другие компоненты. При этом система охлаждения была модифицирована путём добавления специального диэлектрического контура, теплообменника и насоса. Накопители были погружены в непроводящую жидкость.  ✴/Iceotope/ASME " height="441" width="709" /> ✴/Iceotope/ASME " height="441" width="709" />

Источник изображения: Meta✴/Iceotope/ASME Говорится, что применение иммерсионного охлаждения для HDD возможно благодаря тому, что современные диски с заполнением гелием имеют герметичную конструкцию. Результаты эксперимента показали, что в случае погружного охлаждения разница температур между всеми 72 накопителями составила всего 3 °C — независимо от расположения HDD в шасси. Накопители способны надёжно функционировать при температуре жидкости на входе в стойку до +40 °C. Другим преимуществом иммерсионного подхода является то, что он позволяет сократить уровень вибрации, которая может приводить к некорректной работе накопителей или даже провоцировать их выход из строя. В целом, для работы системы погружного охлаждения требуется менее 5 % мощности, потребляемой самой СХД.

17.11.2022 [00:56], Руслан Авдеев

Сухо и комфортно: для экономии воды в ЦОД Meta✴ подняла температуру и снизила влажность в машинных залахНа мероприятии 7×24 Exchange Fall Conference Meta✴ поделилась секретами сбережения воды при эксплуатации дата-центров. Компания повысила температуру в серверных до +32,2 °C, а влажность, наоборот, снизила — до 13 %. Ожидается, что это позволит сэкономить миллиарды литров воды ежегодно. Попутно компания также внедряет передовую систему обработки и фильтрации воды, а в перспективе Meta✴ намерена «восстанавливать» больше воды для окружающей среды, чем потребляет. Для оптимизации работы собственных площадок Meta✴ прибегла к эксперименту — на половине территории некоторых ЦОД задавались различные значения температуры и влажности, после чего оценивались и сравнивались различные показатели, включая, например, процент отказов оборудования. Делается это всё ради уменьшение затрат энергии и воды на охлаждение. Поскольку у Meta✴ площадь ЦОД составляет более 3,7 млн м2, даже небольшие улучшения ведут к большой экономии.

Источник изображения: Erda Estremera/unsplash.com Это не первое повышение температуры и понижение влажности в дата-центрах компании. Ранее Meta✴ увеличила температуру до +29,4 °C, а влажность вообще планировалось поддерживать на уровне 20–30 %. Однако практические испытания показали, что оборудованию достаточно комфортно в новых условиях, и нет проблем, например, со статическими разрядами. Изначально все эти меры были предприняты для снижения энергопотребления, но они заодно помогают экономить и воду. Также в компании обновили процессы промышленной обработки воды, используемой в ЦОД — от фильтрации до «смягчения». Одним из важных изменений стал процесс оптимизации т.н. «обратной промывки» загрязнённых фильтров — в Meta✴ смогли организовать его таким образом, что фильтрационные системы стали использовать намного меньше воды. Помогла и оптимизация процесса смягчения воды в некоторых ЦОД. Всего компания использовала 2,57 млрд литров воды в 2021 году, но водные затраты на электроэнергию составили ещё 3,31 млрд литров. Проекты по восстановлению воды позволили «компенсировать» 2,33 млрд литров, а новые технологии, как ожидается, в перспективе обеспечат «возврат» более 3,2 млрд литров воды ежегодно, так что в Meta✴ рассчитывают стать «водно-положительной» к 2030 году — заявление сделали после критики нового ЦОД в одном из засушливых штатов США.

14.10.2022 [17:17], Сергей Карасёв

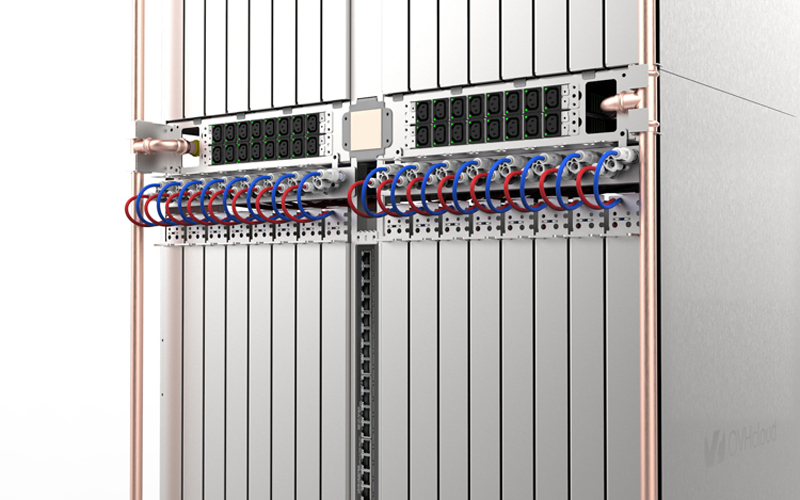

OVHcloud разрабатывает технологию гибридного иммерсионного охлаждения серверовКомпания OVHcloud, европейский поставщик облачных услуг, сообщила о разработке системы гибридного иммерсионного (погружного) охлаждения серверов в центрах обработки данных (ЦОД). Технология призвана повысить эффективность расхода электроэнергии и высвободить площади, занимаемые традиционным оборудованием. Суть метода сводится к использованию двух типов СЖО. На центральных процессорах и ускорителях монтируются стандартные водоблоки, которые образуют отдельный контур. При этом всё шасси целиком вместе с теплообменником помещают в резервуар со специальной нелетучей диэлектрической углеводородной жидкостью. Для каждого сервера применяется собственный резервуар, что, по словам создателей, обеспечивает хорошую масштабируемость, гибкость развёртывания и удобство мониторинга.

Изображения: OVHcloud Для системы предусмотрено применение трёхуровневой стойки библиотечного типа с возможностью монтажа 48 серверов формата 1U или 24 серверов стандарта 2U. Сами стойки имеют пассивный дизайн, то есть не содержат ни помп, ни вентиляторов, а значит, не затрачивают энергию на охлаждение. Потребление электроэнергии и капитальные затраты дополнительно снижаются за счёт исключения системы испарительного охлаждения в ЦОД, расположенных в регионах с температурой окружающего воздуха ниже +43 °С.  Утверждается, что новое решение позволяет сократить энергетические затраты дата-центра на охлаждение на 20,7 % по сравнению с обычным жидкостным охлаждением. Энергопотребление серверов снижается на 20 % в год по сравнению с воздушными системами охлаждения. Частичный коэффициент PUE (pPUE) заявлен на отметке 1,004, а коэффициент WUE — 0 для климатических зон с температурой окружающего воздуха ниже +43 °С. Отметим, что похожую систему охлаждения ранее представила Iceotope.

14.09.2022 [17:35], Руслан Авдеев

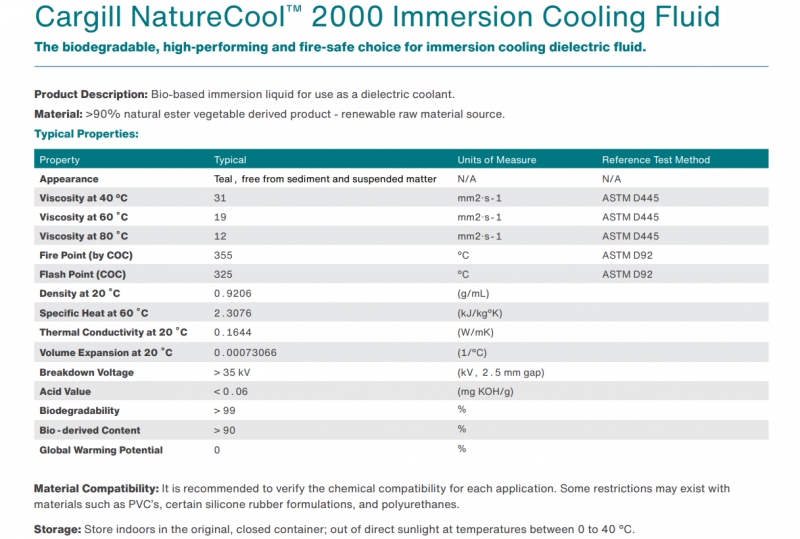

Cargill представила NatureCool 2000, жидкость растительного происхождения для иммерсионных СЖОКак сообщает DataCenter Dynamics, американская продовольственная компания Cargill разработала жидкость NatureCool 2000 для погружных СЖО, которая является более экологичной альтернативой для составов, полученных в результате перегонки углеводородов, поскольку на 90 % состоит из растительных масел. Разработчики подчёркивают, что, поскольку она получена из растений с естественным образом «связанным» углеродом, её можно назвать углеродно-нейтральной. Кроме того, новинка является биоразлагаемой. При этом показатели NatureCool 2000 не только не уступают самым передовым синтетическим альтернативам, но и превосходят их по теплоотдаче на 10 %. Кроме того, жидкость соответствует всем необходимым стандартам безопасности. В частности, говорится о том, что температура вспышки составляет 325°C, а сама жидкость гаснет после устранения источника высокой температуры, тогда как традиционные синтетические жидкости в этом случае могут продолжать гореть. Известно, что Cargill уже присоединилась к инициативе Open Compute Project, причём члены команды продовольственной компании принимают активное участие в развитии спецификаций погружных СЖО. Cargill постепенно осваивает нишу продуктов для ЦОД, хотя пока подобный профиль деятельности не является основным для компании.

16.08.2022 [16:14], Руслан Авдеев

ЦОД Microsoft в Нидерландах потребляют в разы больше воды, чем обещали власти и компанияКак выяснили СМИ Нидерландов, в 2021 году местный кластер дата-центров Microsoft потребовал намного больше воды, чем обещали до его строительства власти и сам техногигант. Как сообщает Data Center Dynamics, ранее говорилось, что ежегодный расход составит 12–20 тыс. м3, однако оказалось, что только в 2021 году объекты компании потребляли 84 тыс. м3. Предполагается, что в текущем году объект Microsoft в Холландс-Крон (Hollands Kroon) истратит ещё больше воды из-за засухи. Хотя проект в своё время встретил противодействие со стороны местных фермеров, строительство новых ЦОД было всё же одобрено в 2021 году рядом с уже существующим объектом. Здесь же расположены и мощности Google, тоже потребляющие огромные объёмы воды. Обычно ЦОД Microsoft довольствуются для охлаждения забортным воздухом, но когда температура превышает +25 °C, вынуждены использовать воду. В 2021 году такое случалось лишь несколько раз, однако расход воды всё равно оказался в разы выше заявленного: 75 тыс. м3 ушло на охлаждение и ещё 9 тыс. м3 — на «другие нужды». Всего расположенные в окрестностях 28 ЦОД Microsoft, Google и других компаний суммарно потребили 550 тыс. м3, т.е. 0,5 % от общего объёма поставок питьевой воды. В этом году ситуация, как ожидается, будет значительно хуже.

Источник изображения: E Mens/unsplash.com В июне совет Холландс-Крон объявил о приостановке строительства новых ЦОД в районе. Хотя девятимесячный мораторий на строительство ЦОД пока действует по всей стране, Холландс-Крон попал в число двух исключений из общего правила для гиперскейлеров, поэтому ограничения пришлось вносить самому совету. Второй «исключительный» проект планировала реализовать Meta✴ в Зееволде, но в прошлом месяце компания окончательно отказалась от его реализации, в том числе из-за активных протестов местного населения. Ранее Microsoft под давлением местных фермеров пообещала, что будет собирать дождевую воду для использования в системах охлаждения. Однако идея пока не пошла дальше проекта и пока неизвестно приблизительно, когда начнётся хотя бы тестовый период. Кроме того, в США компания собиралась построить установку для очистки сточных вод своих дата-центров. Microsoft обещала стать «водно-положительной» к 2030 году, схожее обещание сделано и Google.

28.07.2022 [18:12], Руслан Авдеев

Европейские дата-центры хотят снизить потребление воды до 400 мл/кВт·ч, но только к 2040 годуГруппа Climate Neutral Data Centre Pact (CNDCP), объединяющая 90 % европейских операторов ЦОД, предложила добровольно снизить потребление воды до 400 мл на 1 кВт·ч к 2040 году и добиться углеродной нейтральности намного раньше 2050 года. Соответствующая цель уже поставлена ЕС, но операторы намерены добиваться её без законодательного принуждения и с опережением графика, — сообщает Data Center Dynamics. Хотя использование воды способно оказать значительное влияние на экологию, этот фактор часто недооценивают, учитывая только расход энергии. При этом многие ЦОД активно используют воду для охлаждения оборудования, благодаря чему снижается расход всё той же энергии, но растут затраты самой жидкости, что имеет критическое значение для некоторых регионов. Группу CNDCP сформировали в 2021 году с намерением достичь углеродной нейтральности европейских ЦОД к 2030 году, а также обеспечить достойный ответ прочим экологическим вызовам, в том числе снизить расход воды. Для оценки эффективности использования воды используется коэффициент WUE, который отражает расход воды на каждый затраченный киловатт·час электричества. Например, исследование 2016 года показало, что на тот момент WUE для ЦОД в США составлял в среднем 1,8 л/кВт·ч.

Источник изображения: Christian Lue/unsplash.com Цели поставлены с учётом жизненного цикла уже действующих систем охлаждения, поскольку их немедленная массовая замена может принести больше вреда, чем пользы из-за ущерба экологии в процессе производства самих систем. Поэтому в CNDCP заявили, что все 74 оператора ЦОД, участвовавшие в заключении пакта, добьются потребления не более 400 мл/кВт·ч только к 2040 году. Такой показатель вывели с учётом разницы технологий, климатических и иных условий, характерных для тех или иных ЦОД. Отдельные участники рынка уже заявили о намерении добиться положительного водного баланса для своих дата-центров — ЦОД будут отдавать больше чистой воды, чем потреблять. Так, Meta✴ и Microsoft планируют добиться этой цели к 2030 году. Последняя также начала устанавливать станции для очистки сточных вод ЦОД. А вот Google отметилась тем, что пыталась всеми возможными способами скрыть расход воды своими дата-центрами даже от властей. Помимо ограничения расхода воды, подписанты CNDCP предложили ввести и другие цели для дата-центров. Например, уже сформированы две рабочие группы для подготовки к переходу на «циркулярную экономику» со вторичным использованием материалов и переработкой различных ресурсов. В частном порядке аналогичную инициативу уже несколько лет развивает Microsoft в рамках проекта Circular Center.

20.07.2022 [15:56], Владимир Мироненко

Аномальная жара привела к сбоям в лондонских дата-центрах Google и Oracle

google cloud platform

hardware

oracle cloud infrastructure

великобритания

облако

охлаждение

сбой

цод

Во вторник, 19 июля, в ЦОД Google Cloud Platform (GCP) в Лондоне произошёл сбой в системе охлаждения, в связи с чем несколько сервисов компании временно вышло из строя. В лондонском регионе облака Oracle тоже возникли проблемы с охлаждением оборудования ЦОД. Сбои произошли из-за рекордной жары в Великобритании — температура превысила +40°C. Некоторые операторы дата-центров были вынуждены принять нестандартные меры, начав обрызгивать водой внешние модули систем кондиционирования, установленные на крыше. Отключение ряда сервисов Google произошло в 18:13 по местному времени (20:13 мск). В журнале статуса оборудования сбой описан как «связанный с охлаждением». Google заявила, что сбой затронул лишь небольшое количество клиентов. В частности, отключение коснулось сервисов Persistent Disk и Autoscaling. Хотя Google утверждает, что сбой продолжался до 22:00 BST (24:00 мск), в означенное время всё ещё поступали жалобы на ошибки в работе Persistent Disk. С подобными проблемами в Лондоне столкнулась и облачная служба Oracle. Проблемы с перегревом у неё начались примерно в 17:00 по местному времени (19:00 мск). Oracle ранее арендовала ресурсы в ЦОД Equinix в лондонском кампусе Слау, но сейчас не раскрывает местонахождение своих мощностей. «В результате несезонных температур в регионе возникла проблема с частью инфраструктуры охлаждения в центре обработки данных на юге Великобритании (в Лондоне), — говорится в сообщении компании. — Это привело к тому, что часть нашей сервисной инфраструктуры пришлось отключить, чтобы предотвратить неконтролируемые сбои оборудования».

20.07.2022 [00:56], Владимир Мироненко

Из-за жары лондонские дата-центры вынуждены охлаждать оборудование на крыше, поливая его водой из шланговВ этом году в Великобритании наблюдается аномальная жара. 19 июля температура воздуха в стране установила новый рекорд, превысив 40° С. Как сообщает Bloomberg, в некоторых британских ЦОД выбрали оригинальный способ борьбы с перегревом оборудования, используя обрызгивание водой внешних модулей систем кондиционирования, установленных на крыше. По словам Адриана Тревельяна (Adrian Trevelyan), директора по послепродажному обслуживанию компании Airedale International, которая поставляет и обслуживает системы охлаждения для ЦОД, многие лондонские дата-центры вынуждены прибегнуть к такому необычному способу охлаждения. Небольшие ЦОД в густонаселённых городских районах, работающие почти на полную мощность, просто требуют экстренного орошения во время жары. Тревельян сообщил, что орошение позволяет снизить температуру воздуха вокруг змеевиков внешнего контура охлаждения, чтобы они продолжали эффективно рассеивать тепло. Он отказался назвать конкретные компании, применяющие такой способ охлаждения, но сказал, что это делают «в пределах (кольцевой автомагистрали) M25 и в городе». Однако от жары страдают не только малые, но и крупные дата-центры, которые всё же имеют запас по охлаждению ключевых подсистем — 10 июля в лондонском ЦОД AWS произошёл перебой питания из-за так называемого «теплового события» (thermal event). Использование полива шлангами может выручить в очень жаркий день, но негативно отразится на сроке службы оборудования, сообщила София Флюкер (Sophia Flucker), директор консалтинговой фирмы Operational Intelligence, отметив, что если используется вода повышенной жёсткости (как в Лондоне), это может привести к накоплению накипи. Флюкер также рассказала, что многие операторы колокации, сдающие мощности в аренду третьим лицам, сталкиваются со штрафами за несоблюдение температурного режима в машинных залах.

14.11.2021 [21:11], Владимир Мироненко

LiquidStack и Microsoft продемонстрировали ИИ-серверы с двухфазным иммерсионным охлаждениемLiquidStack, дочернее предприятие BitFury, специализирующееся на разработке иммерсионных СЖО, и Microsoft продемонстрировали на OCP Global Summit стандартизированное решение с двухфазным погружным жидкостным охлаждением. Демо-серверы Wiwynn, разработанные в соответствии со спецификациями OCP Open Accelerator Infrastructure (OAI), были погружены в бак LiquidStack DataTank 4U, способный отводить порядка 3 кВт/1U (эквивалент 126 кВт на стойку). LiquidStack сообщила, что она впервые оптимизировала серверы OCP OAI для охлаждения путем погружения в жидкость. По словам компании, её двухфазные иммерсионные СЖО DataTank предоставляют наиболее эффективное решение, которое требует немного пространства и потребляет меньше энергии, чем другие системы охлаждения, и вместе с тем повышает плотность размещения компонентов и их производительность.

Фото: LiquidStack В демо-серверах использовались ИИ-ускорители Intel Habana Gaudi, погружённые в жидкий диэлектрик (от 3M) с низкой температурой кипения, который наиболее эффективно отводит тепло благодаря фазовому переходу. Данное решение должно помочь достижению показателя PUE в пределах от 1,02 до 1,03, поскольку оно практически не потребляет энергию. LiquidStack утверждает, что у её СЖО эффективность теплоотвода примерно в 16 раз выше, чем у типичных систем воздушного охлаждения. По мнению компании, системы высокопроизводительных вычислений (HPC) уже сейчас слишком энергоёмки, чтобы их можно было охлаждать воздухом. Поэтому следует использовать платы, специально предназначенные для жидкостного охлаждения, а не пытаться адаптировать те, что были созданы с расчётом на воздушные системы — при использовании СЖО вычислительная инфраструктура может занимать на 60% меньше места.

Изображение: Microsoft LiquidStack и Wiwynn являются партнёрами. В апреле Wiwynn инвестировала в LiquidStack $10 млн. Также Wiwynn протестировала серверы с погружным жидкостным охлаждением в центре обработки данных Microsoft Azure в Куинси (штат Вашингтон). Microsoft, как и другие гиперскейлеры, уже некоторое время изучает возможности иммерсионных СЖО.

22.10.2021 [20:03], Руслан Авдеев

Для обеспечения работы суперкомпьютера El Capitan потребуется 28 тыс. тонн воды и 35 МВт энергииК моменту ввода в эксплуатацию в 2023 году суперкомпьютер El Capitan на базе AMD EPYC Zen4 и Radeon Instinct, как ожидается, будет иметь самую высокую в мире производительность — более 2 Эфлопс. А это означает, что ему потребуются гигантские мощности для питания и охлаждения. Ливерморская национальная лаборатория (LLNL), в которой и будет работать El Capitan, поделилась подробностями о масштабном проекте, призванном обеспечить HPC-центр необходимой инфраструктурой. В основе плана модернизации лежит проект Exascale Computing Facility Modernization (ECFM) стоимостью около $100 млн. В его рамках будет обновлена уже существующая в LLNL инфраструктура. Для реализации проекта необходимо получить очень много разрешений от местных регуляторов и очень тесно взаимодействовать с местными поставщиками электроэнергии. Тем не менее, LLNL заявляет, что проект «почти готов», по некоторым оценкам — на 93%. Функционировать новая инфраструктура должна с мая 2022 года (с опережением графика).  Сам проект стартовал ещё в 2019 году и, согласно планам, должен быть полностью завершён в июле 2022 года. В его рамках модернизируют территорию центра, введённого в эксплуатацию в 2004 году, общей площадью около 1,4 га. Если раньше центр, в котором работали системы вроде лучшего для 2012 года суперкомпьютера Sequoia (ныне выведенного из эксплуатации), обеспечивал подачу до 45 МВт, то теперь инфраструктура рассчитана уже на 85 МВт. Конечно, даже для El Capitan такие мощности будут избыточны — ожидается, что суперкомпьютер будет потреблять порядка 30-35 МВт. Однако LLNL заранее думает о «жизнеобеспечении» преемника El Capitan. Следующий суперкомпьютер планируется ввести в эксплуатацию до того, как его предшественник будет отключён в 2029 году. Кроме того, для новой системы потребуется установка нескольких 3000-тонных охладителей. Если раньше общая ёмкость системы охлаждения составляла 10 000 т воды, то теперь она вырастет до 28 000 т. |

|