Главной темой выставки SC в этом году стал искусственный интеллект (ИИ), а точнее его применение на практике. Правда, под ИИ чаще всего подразумевалось вовсе не то, что с таким упоением описывали фантасты, а всего лишь технологии глубинного обучения (Deep Learning) и обработки больших массивов данных. В конце концов, растущие вычислительные мощности нужны не ради красивых цифр в бенчмарках, а для более чем реальных задач. Впрочем, догадаться, куда всё движется, можно было и так — по анонсам и выпущенным с начала года продуктам крупных игроков. Ещё весной NVIDIA рассказала об ускорителях Tesla, адаптированных для работы с нейронными сетями, с упором на FP16-вычисления и большим объёмом быстрой набортной памяти.

Узел нового Cray CX50 c NVIDIA Tesla

А буквально за несколько дней до выставки компания поведала о своём суперкомпьютере DGX SATURNV с ускорителями Tesla P100 — самой энергоэффективной машине подобного класса, которая, по словам компании, более чем в два раза экономичнее аналогичного по производительности решения на базе Intel Xeon Phi KNL. Сама NVIDIA уже использует этот суперкомпьютер для проектирования новых чипов. Как объяснил представитель компании, схема любого чипа является всего лишь очень большим изображением, а обрабатывать картинки нейронные сети научились давно. Ну это если объяснять совсем уж простым языком. Вероятно, такой подход позволяет и сэкономить время, и к тому же значительно улучшить результат неручной разводки чипа.

Помимо самих вычислителей компания старается популяризировать и шину NVLink. На стендах в основном мелькали варианты референсной платформы IBM с процессорами POWER и ускорителями Tesla. Сама же IBM показала вариант OEM-платформы S822LC с жидкостным охлаждением. Хотя были и оригинальные решения. Например, Atos показала машину Bull X1115 с прямым NVLink-соединением между четырьмя GPU — по привычке и для простоты будем называть эти ускорители так, хотя это уже не совсем корректно. Впрочем, рядышком лежала и система Bull X1210 с Intel Xeon Phi. Да и вообще на выставке в этот раз «железных» новинок было совсем мало, а имеющих прямое отношение к HPC и того меньше.

Компании всё больше заключали договоры да рассказывали о том, как они помогают решать глобальные задачи вроде борьбы с раком. Естественно, с помощью ИИ. Intel даже провела отдельный AI Day одновременно с выставкой, да и в целом подготовила «убойный» ответ GPU вообще и NVIDIA в частности — связку из Xeon Phi Knights Mill, ASIC семейства Crest (в девичестве Nervana) и FPGA-карту. Фактически компания «объявила войну» GPU. Подробнее про новинки Intel рассказано в этом материале. Пожалуй, тяжелее всех придётся AMD, которая и так вынуждена работать на два фронта, создавая GPU и CPU.

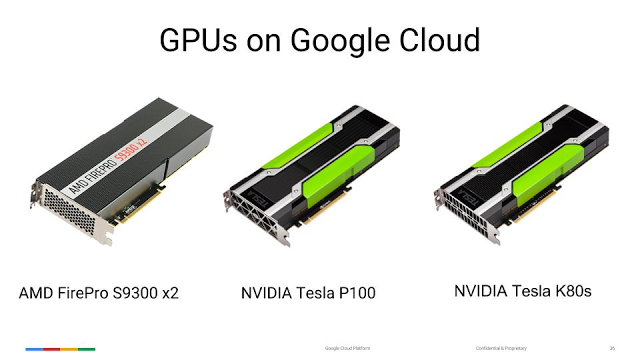

Есть и хорошие новости — Google теперь предлагает в своём облачном сервисе машины с GPU AMD и NVIDIA. К слову, Google удивила тем, что на SC16 она привезла и свой небольшой стенд, где показала собственное аппаратное решение для машинного обучения TPU, представленное ещё весной. Как и прочие участники, компания заявила о планах по развитию ПО для ИИ и обучающих программ. Хотя этим удивить трудно. Например, NVIDIA анонсировала ещё более масштабную программу обучения разработчиков — Deep Learning Institute. Она будет включать в себя как онлайн-курсы, так и наборы для офлайн-обучения, которые будут рассылаться университетам. Похожие программы есть и у других компаний.

Если Google удивила своим присутствием на SC16, то вот Samsung удивила своим отсутствием на выставке. Да и в целом ничего действительного нового в области памяти и хранилищ практически не было представлено. Тенденция к переходу исключительно на твердотельные накопители никуда не делась. Из интересного — IBM вживую показала представленную ещё летом СХД DeepFlash 150 (256 Тбайт в корпусе высотой 3U), да у Seagate ещё были «летние» же SSD большого объёма, а также решения для NVMe-over-Fabric. Аналогичный продукт по версии Intel мы уже видели на стенде РСК. Однако от HDD Seagate явно отказываться не собирается, так как компания представила гибридные СХД ClusterStor 300 и 10-Тбайт жёсткий диск IronWolf Pro.

Intel вообще ни слова не сказала о 3D XPoint, а Micron показывала на стенде всё то же, что полгода-год назад. Да и про HBM все немного подзабыли, всё же она пока дорога для действительно массового применения, а в качестве компромиссного решения есть GDDR5X. Зато на выставке появились новые лица — компания Smart IOPS показала образцы своих сверхбыстрых NVMe SSD с технологией TruRandom. В основе лежит привычная MLC-память, а вот контроллер у этих накопителей очень необычный. Разработчики используют Xilinx Kintex UltraScale FPGA для предсказания того, с какими данными будет идти работа. Smart IOPS предлагает как отдельные карты (2-10 Тбайт), так и стоечное хранилище (40-400 Тбайт). Для старшей версии СХД заявлены впечатляющие характеристики: 200 млн IOPS и пропускная способность 800 Гбайт/с. Компания обещает начать поставки новинок до конца 2016 года.

Ускорителями на базе FPGA сегодня никого не удивишь. На выставке наконец-то был продемонстрирован и фреймворк для работы с FPGA на платформе OpenPOWER — CAPI SNAP. Micron показала плату AC-520 с FPGA Intel Arria 10 GX1150, 2/4 Гбайт памяти Hybrid Memory Cube и слотом для установки до 16 Гбайт обычной DDR4. DINI Group, известная своими «монструозными» платами со множеством FPGA, на этот раз скромно выкатила небольшую плату HardwareShark для анализа сетевого трафика и универсальную Monster's Sour Caviar (FPGA Intel Arria 10). Среди других производителей необычных или, скорее, просто непривычных вычислителей на SC16 присутствовали PEZY и NEC. Про удивительную машину PEZY мы подробно рассказывали ещё летом, а NEC в этот раз привезла прототип векторного ускорителя для своего будущего суперкомпьютера Aurora и уже полностью укомплектованное шасси DX2000, которое было упомянуто в репортаже с ISC2016.

✴-media" data-instgrm-captioned=" " data-instgrm-version="7">

В стане ARM на этот раз было относительно тихо. Сама компания, как обычно, на выставке выкупила место под стенд и пригласила нескольких производителей. Рядышком расположился и стенд Cavium, на котором больше внимания уделили скорее не CPU, а продуктам поглощённой QLogic. Никаких громких анонсов не было, но это не значит, что ARM нигде не используется. Например, представители Aewin говорят, что их стоечные СХД тысячами скупает Alibaba для организации CDN по раздаче изображений. Правда, непосредственно к HPC это не относится. Зато Fujitsu обещает сделать в течение ближайших пяти лет новый суперкомпьютер с процессорами ARM собственной разработки.

А ещё Fujitsu показала прототип иммерсионной СЖО. В ванну 95 × 70 × 70 см залита жидкость 3M Fluorinert. Если верить «Википедии», именно эта жидкость использовалась для создания жидкостной системы дыхания в фильме «Бездна» (1989). В данном прототипе с помощью Fluorinert отводится до 25 киловатт тепла на одну ванну. Впрочем, на выставке в этот раз присутствовало на удивление много разработчиков погружных СЖО, включая и совсем маленькие компании. Наиболее впечатляющая демонстрация была на стенде компании Allied Control из BitFury Group, где в закрытом танке кипел сервер. Ну то есть кипела-то охлаждающая жидкость, конечно, — 3M Novec. Ещё один «кипящий» прототип показала LiquidMips. Среди главных отличий от других решений заявлена нормальная работа оптических подключений.

Одна из проблем иммерсионных СЖО как раз в том, что при погружении в них обычного «железа» есть немалый шанс попадания жидкости в оптический вход. Да и в целом подобные системы не очень удобны в эксплуатации. Компромиссный вариант предлагает LiquidCool Solutions. Вместо того чтобы погружать стойку или рэки целиком в одну ванну, LCS упаковывает один-два узла в герметичный корпус, который омывается жидкостью, проходящей сначала через блок CPU, а уже потом перемещающейся к остальным компонентам. Все порты ввода-вывода выносятся наружу через отдельные переходники. Правда, и в этом случае «оптики» замечено не было.

Что касается обычных, не погружных СЖО, то практически ничего нового представлено не было. Производители, которые занимаются созданием суперкомпьютеров от и до, продолжают это делать. А все остальные так или иначе довольствуются готовыми решениями сторонних компаний. С другой стороны, на каждом стенде был хотя бы один образец машины с СЖО, пусть и не собственной разработки. Например, CoolIT рассказала о специально доработанной СЖО для машин HPE Apollo 2000. Также компания совместно со STULZ представила гибридное решение Chip-to-Atmosphere — наиболее горячие компоненты охлаждаются жидкостью, а всё остальное воздухом. И всё это в пределах одного шкафа. Asetek новинок на выставку не привезла, как и Ebullient.

Заключение

Совсем уж буквально воспринимать заголовок данного материала не стоит, потому что компаниям всегда нужно простое и понятное публике словечко для описания того, над чем они сейчас работают. Как и говорилось в самом начале, за термином ИИ обычно скрывается глубинное обучение и нейронные сети, то есть штука, в общем, далеко не новая и во многом чисто математическая. Но есть во всём этом одно важное отличие от предыдущей модной темы BigData, которая тоже по большому счёту относится к области алгоритмов, а не «железа», очередной виток обновления которого, кажется, просто удачно подвязали к «большим данным». С глубинным обучением всё иначе — конкретно для этих задач крупные компании в течение года создавали отдельные аппаратные решения, пусть и основанные на уже имеющихся наработках.

И решения эти далеки от обычных CPU. Смотрите сами: у NVIDIA появилась Tesla P100, Google показала TPU, Microsoft оснащает свои дата-центры FPGA, а Intel фактически объявила войну GPU, представив связку из Xeon Phi Knights Mill, ASIC семейства Crest и всё той же FPGA. ARM и OpenPOWER тоже стремятся интегрировать в свои платформы поддержку FPGA и GPU. И все-все-все стараются сделать процесс создания и переноса ПО под эти ускорители как можно более простым: создаются новые средства разработки, вводятся обширные обучающие программы, ведётся работа по адаптации уже существующих алгоритмов и так далее. При всём при этом в лидерах TOP500 до сих пор находится загадочный китайский суперкомпьютер с процессорами собственной разработки.

Интересная тенденция, однако. Кризис привычных архитектур? Как знать, посмотрим, что покажут на следующей выставке. Пожалуй, сейчас самое время для активного продвижения тех же ARM и OpenPOWER. В остальном же практически ничего нового на SC16 не показали. Ну да, все производители переметнулись к жидкостным системам охлаждения. Ну да, всё активнее внедряются твердотельные накопители, которые в ближайшем будущем почти полностью вытеснят жёсткие диски. При этом ни одного свежего анонса в области быстрой локальной памяти не было. Из чего-то относительно нового, наверное, самое интересное — это удалённый доступ к СХД и очередная волна интереса к иммерсионным СЖО.