Материалы по тегу: микро-цод

|

26.01.2025 [12:50], Сергей Карасёв

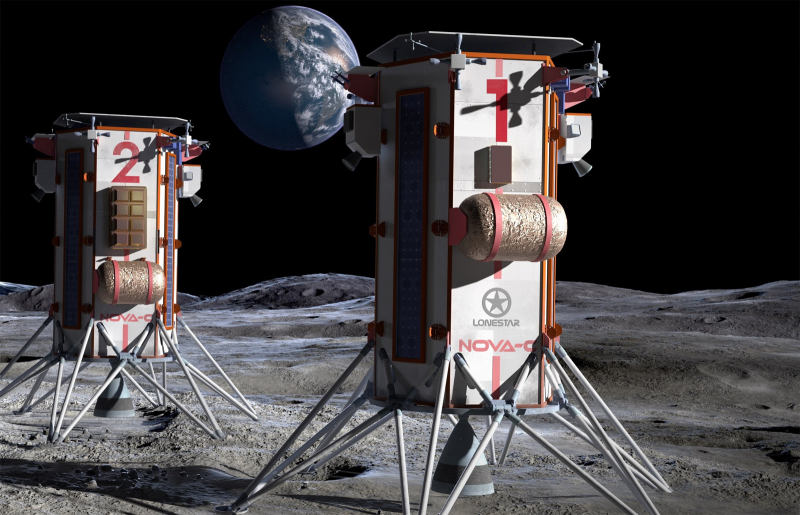

Первый в истории лунный дата-центр будет запущен в февралеСтартап Lonestar Data Holdings, по сообщению Reuters, намерен в феврале нынешнего года запустить первый в истории лунный микро-ЦОД. Эта система, по задумке компании, обеспечит ряд преимуществ перед традиционными наземными дата-центрами, включая непревзойденную безопасность и энергетическую эффективность. Lonestar Data Holdings из Флориды разрабатывает технологии хранения и обработки данных на Луне. Такой подход гарантирует исключительную физическую безопасность оборудования, а также защиту от стихийных бедствий и конфликтов, которые могут поставить под угрозу данные, хранящиеся на Земле. Стартап опробовал свои решения на борту Международной космической станции (МКС) в 2021 году и на базе лунного посадочного модуля Odysseus («Одиссей») в 2024-м. В рамках намеченной на февраль нынешнего года миссии Lonestar Data Holdings намерена использовать ракету SpaceX Falcon 9 для запуска полностью функциональной системы Freedom Data Center, интегрированной с лунным модулем Athena компании Intuitive Machines. Питание лунный ЦОД будет получать от солнечных батарей. В состав дата-центра включены высоконадёжные твердотельные накопители. В число первых клиентов Lonestar Data Holdings, которые изъявили желание хранить свою информацию на Луне, вошли власти штата Флорида, правительство острова Мэн, фирма Valkyrie, занимающаяся разработкой ИИ, и американская поп-рок-группа Imagine Dragons. Вместе с тем отмечается, что создание лунного дата-центра сопряжено с рядом серьёзных трудностей и ограничений. Это, в частности, суровые условия эксплуатации, фактическая невозможность оперативного обслуживания и высокие расходы. Кроме того, существуют риски, связанные с собственно запуском оборудования в космос. Поэтому информацию, хранящуюся в базе лунного ЦОД, планируется дублировать на объекте Flexential в Тампе (штат Флорида). Добавим, что в марте 2023 года Lonestar Data Holdings привлекла $5 млн от Scout Ventures, Seldor Capital, 2 Future Holding, The Veteran Fund, Irongate Capital, Atypical Ventures и KittyHawk Ventures. Позднее стартап получил на развитие ещё $825 тыс. В общей сложности на сегодняшний день Lonestar собрала почти $10 млн.

06.11.2024 [11:28], Сергей Карасёв

«Утилекс» отгрузил более 300 российских микро-ЦОД менее чем за полгодаРоссийский разработчик оборудования для дата-центров «Утилекс» сообщил о том, что объём поставок микро-ЦОД семейства DataStone за пять месяцев превысил 300 ед. Эти решения предназначены для размещения и обеспечения требуемой готовности вычислительного и сетевого оборудования, систем хранения, а также любых устройств типоразмера 19″. Изделия DataStone выполнены по стандарту IP65 в виде герметичного шкафа с шумоизоляцией. Реализована замкнутая ультразвуковая система адиабатического увлажнения, не требующая подключения к трассам водоснабжения и канализации. В шкафу размещаются не менее шести датчиков температуры и двух датчиков влажности. Поддерживается удалённый мониторинг через SNMP, Modbus TCP, RTU. Кроме того, упомянута возможность построения системы охлаждения с полным резервированием (2N).

Источник изображения: «Утилекс» Решения DataStone могут применяться для замены серверных комнат, развёртывания ЦОД в неподготовленных помещениях; создания инфраструктуры частного облака, периферийных вычислений и пр. Ключевыми преимуществами микро-ЦОД названы экономия капитальных затрат, возможность установки IT-оборудования с любой энергетической плотностью, высвобождение площадей, сжатые сроки создания ЦОД, возможность повторного использования и унификация решения. Отмечается, что с конца мая по конец октября 2024 года «Утилекс» поставил заказчикам более 300 модульных микро-ЦОД DataStone+ в разных конфигурациях. В их число, в частности, вошли:

25.07.2024 [16:41], Руслан Авдеев

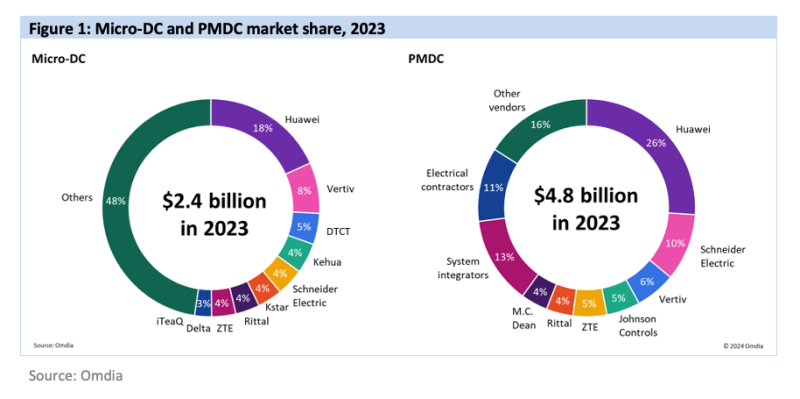

Omdia: спрос на готовые модульные дата-центры и микро-ЦОД вырос благодаря развитию рынка ИИИсследование компании Omdia показало, что рынок готовых модульных дата-центров (PMDC) и микро-ЦОД к 2027 году достигнет $11,7 млрд. По данным пресс-службы компании, пик спроса придется на 2023–2024 гг., причиной стремительного роста спроса станет бум ИИ-технологий. Рынок готовых, заранее собранных на производстве ЦОД включает как отдельные, так и многомодульные конструкции, которые могут выполнять как единичные функции (энергоснабжение, охлаждение), так и составлять ЦОД целиком. В Omdia рассчитывают, что в 2027 году объём продаж PMDC составит $8,6 млрд. Крупнейшей категорией считаются предсобранные модули питания, их сбыт растёт самыми быстрыми темпами — в сравнении со всеми другими модулями, продажи которых тоже отслеживаются Omdia. Основным фактором роста является то, что именно в таких модулях нуждаются как новые, так и действующие ЦОД, требующие увеличения энергетической ёмкости.

Источник изображения: Omdia Модульные микро-ЦОД (micro-DC) состоят или из одного или нескольких модулей, последние обычно поставляются уже в собранном состоянии. В Omdia прогнозируют, что их продажи составят в 2027 году $3,1 млрд. Такие объекты, по данным экспертов компании, подходят как облачным провайдерам, так и корпоративным клиентам. В Omdia утверждают, что подобные ЦОД на много стоек изначально использовались гиперскейлерами — предварительная сборка вдали от места установки ускоряла ввод в эксплуатацию на целевой территории. Подобные решения внедрялись как минимум с 2018 года. Лидером на рынке PMDC является Huawei, за ней следуют Schneider Electric и Veritiv. В Северной Америке крупнейшими вендорами подобных решений являются Johnson Controls, Schneider Electric и M.C. Dean, в Западной Европе — Vertiv и Rittal, а Huawei — в Азии и Океании, а также на рынке Европы, Ближнего Востока и Африки (EMEA) в целом. Что касается рынка модульных микро-ЦОД, он гораздо более насыщеннее вендорами благодаря довольно низкому порогу вхождения. Впрочем, из здесь лидирует Huawei, ненамного от которой отстают Vertiv и DTCT. В Omdia ожидают, что инновации в PMDC и micro-DC продолжатся. Акцент будет сделан на повышении энергетической плотности для того, чтобы обеспечить в новых ЦОД использование серверов с ресурсоёмким ИИ-оборудованием. В первую очередь ожидаются новые решения в сфере интеграции систем жидкостного охлаждения (СЖО) и аккумуляторов. В июне Omdia прогнозировала, что основной нагрузкой в ЦОД станут ИИ-приложения, которые подстегнут рост расходов на серверы.

15.07.2024 [21:20], Владимир Мироненко

Microsoft возглавила $40-млн раунд инвестиций в разработчика автономных микро-ЦОД Armada

armada

hardware

iiot

microsoft

microsoft azure

контейнер

микро-цод

модульный

облако

периферийные вычисления

финансы

Armada, стартап из Сан-Франциско (Калифорния, США), специализирующийся на разработке решений для периферийных вычислений, объявил об успешном раунде финансирования на $40 млн, который возглавил M12 (венчурный фонд Microsoft). С момента выхода в прошлом году из скрытого режима (stealth mode) стартап уже привлёк с учётом этой суммы более $100 млн инвестиций. В рамках инвестиционной сделки решения Armada появятся в маркетплейсе Azure Marketplace. Как сообщил стартап, это позволит клиентам Azure придерживаться выделенного бюджета на использование решений Armada и сделает его технологию «более доступной, чем когда-либо». Armada предлагает защищённые автономные модули ЦОД Galleon в стандартных 20′ и 40′ грузовых контейнерах, которые включают три и шесть стоек соответственно, платформу управления устройствами и вычислениями Edge и приложения Edge/AI, специально разработанные для использования на периферии и работающие локально или в облаке. Также Armada предлагает Commander Connect, комплексную платформу для мониторинга и управления IIoT-активами, включая терминалы Starlink, собственно ЦОД Galleon и другие подключённые устройства, такие как дроны, датчики, камеры и транспортные средства. Её основное назначение — предоставить доступ к интернету и облегчить удалённое или локальное управление экосистемой через «единое окно».

Источник изображения: Armada Как сообщает Armada, «используя надёжную инфраструктуру Azure, Commander Connect предлагает беспрецедентную масштабируемость, безопасность и производительность для периферийных вычислений корпоративного уровня». Стоимость использования Commander Edge начинается от $450 тыс./год, Commander Connect — $50 тыс./год. Ранее Armada объявила о партнёрстве с Halliburton, Pivotel, Edarat и Skydio, а также подписала соглашение с ближневосточной фирмой Edarat Group, занимающейся инженерным консалтингом в области ЦОД и облачных сервисов, о развёртывании 10 модулей Galleon в Персидском заливе и на Ближнем Востоке, уточняет DatacenterDynamics. При этом у Microsoft есть собственное предложение в этой области — микро-ЦОД Azure MDC в 40′ контейнере.

20.06.2024 [16:29], Руслан Авдеев

И посчитать, и погреться: HPE и Danfoss представили микро-ЦОД, способный отапливать зданияПо мере роста энергопотребления ЦОД развиваются и решения, способные компенсировать ущерб окружающей среде. Network World сообщает, что компании Hewlett Packard Enterprise (HPE) и датская Danfoss запустили серию усовершенствованных модульных дата-центров, позволяющих использовать тепло, генерируемое в процессе их работы, в любых целях. За основу была взята система утилизации «мусорного» тепла, применяемая в штаб-квартире Danfoss в Дании. По данным Международного энергетического агентства (IEA), к 2026 году ИИ-индустрия будет потреблять на порядок больше электроэнергии, чем в 2023 году. Дата-центры всегда вырабатывали много тепла, причём по мере роста вычислительных мощностей растёт и отдача тепловой энергии. Поэтому HPE и датская инжиниринговая компания Danfoss создали готовое решение в рамках HPE IT Sustainability Services — модульную систему Data Center Heat Recovery. Решение включает модульный дата-центр HPE (Modular Data Center) — компактный контейнер с высокой плотностью размещения оборудования с прямым жидкостным охлаждением, который, как заявляют в HPE, может быть развёрнут практически везде и позволит снизить общее потребление энергии на 20 %. Danfoss же предоставила модули отбора тепла для его передачи ближайшим зданиям и промышленным объектам. Безмасляные компрессоры Turbocor повышают эффективность систем охлаждения ЦОД при оптимистичном сценарии на целых 30 %. Выгода для пользователей очевидна, говорят компании, поскольку захваченное тепло позволяет не генерировать его специально. В HPE даже предложили измерять сэкономленное тепло в «негаваттах», т.к. затраты на его генерацию в данном случае отрицательны. С учётом огромных объёмов потребляемого ЦОД электричества, экономия 30 % энергии может стать существенной. Впрочем, технология имеет определённые ограничения и пригодится не всем. Если обогревать окружающие здания нет необходимости, то никакой экономии энергии и не будет. Подобные технологии уже активно применяют как в Северной Америке, так и в Европе и других регионах. Особенно эффективны они в странах с прохладным климатом. Впрочем, такие системы пока довольно дороги, а иногда и вовсе не имеют смысла по целому ряду причин, в том числе экономических.

18.06.2024 [17:43], Сергей Карасёв

Microsoft свернула проект подводного дата-центра Natick, хотя он доказал свою надёжностьКорпорация Microsoft, по сообщению Datacenter Dynamics, прекратила развитие проекта Natick по созданию подводного ЦОД. Причины данного решения не уточняются. Но редмондский гигант говорит, что полученные наработки и знания в перспективе найдут применение в других областях. Microsoft запустила инициативу Natick ещё в 2013 году, а в 2018-м развернула тестовую платформу у побережья Шотландии. Идея подводного дата-центра заключается в том, что оборудование функционирует на дне моря, где температура постоянна и достаточно низка. Концепция Natick доказала свою надёжность. В рамках тестирования только шесть серверов из 855 столкнулись со сбоями. Для сравнения: на суше в кластере из 135 машин из строя вышли восемь за аналогичный период эксплуатации. Более низкий процент отказов серверов в подводном ЦОД может объясняться стабильной температурой окружающей среды. Другая причина заключается в том, что Natick был заполнен инертным азотом, а не кислородом. В 2020 году Microsoft продемонстрировала Natick третьего поколения, но после этого корпорация практически не делилась информацией о проекте. И вот теперь Ноэль Уолш (Noelle Walsh), глава облачного подразделения Microsoft Cloud Operations + Innovation (CO+I), заявила, что компания пока не собирается строить подводные дата-центры. «Моя команда работала над проектом, и он подтвердил жизнеспособность. Мы узнали много нового о работе ниже уровня моря, вибрации и воздействиях на серверы. В дальнейшем мы применим эти знания в других областях», — сказала Уолш. В 2021 году Microsoft открыла некоторые из запатентованных технологий, которые были применены в Natick. Компания подчёркивает, что продолжит использовать проект в качестве исследовательской платформы «для изучения, тестирования и проверки новых концепций, касающихся надёжности и устойчивости ЦОД». Вместе с тем фактическая эксплуатация таких объектов прекращена. Нужно отметить, что идею дата-центров на морском дне развивают и другие компании. Это, в частности, китайская HiCloud Data Center Technology (подразделение Highlander), которая создаёт коммерческий подводный ЦОД у побережья города Санья (о. Хайнань). А Subsea Cloud занимается разработкой глубоководных дата-центров.

14.06.2024 [14:42], Руслан Авдеев

AWS, но в космосе: Phantom Space и Assured Space Access создадут космическое облако Phantom CloudКомпании Phantom Space и Assured Space Access договорились о сотрудничестве для создания облачного сервиса в космосе. По данным Datacenter Dynamics, облако Phantom Cloud будет служить резервным хранилищем данных для сторонних космических аппаратов и упростит передачу информации на Землю. В рамках соглашения Assured Space разработает и построит телекоммуникационное оборудование для 66 спутников группировки Phantom Cloud. Партнёры будут совместно работать над созданием, запуском и эксплуатацией новой группировки. В результате предполагается сформировать сеть, к которой смогут получать доступ другие спутники для трансляции данных на Землю в режиме реального времени. В соцсети X сообщалось, что облако Phantom Cloud должно стать «AWS для космоса», обеспечивая M2M-коммуникации и комбинируя соответствующие услуги с вычислениями и облачным хранилищем на орбите. Более того, по словам одного из основателей и главы Phantom Space Джима Кантрелла (Jim Cantrell), который участвовал в создании SpaceX, компании хотят обеспечить базовую функциональность наземных телекоммуникационных станций непосредственно в космосе. Предполагается, что проект станет дополнением группировки Starlink, но его участники будут уделять приоритетное внимание межмашинным коммуникациям, а не людей. По некоторым данным, Phantom Space на сегодня привлекла $27,7 млн инвестиций. Помимо разработки спутников она создаёт и космические аппараты, способные нести грузы различных типов. Идея не вполне уникальна. Космос привлекает всё большее внимание операторов ЦОД и облачных компаний. Например, в марте сообщалось, что Lumen Orbit намерена развернуть над Землёй сеть собственных ЦОД, а стартап Aethero намерен стать «Intel или NVIDIA в космической индустрии», создавая защищённые от экстремальных условий компьютеры.

05.06.2024 [20:20], Александр Бенедичук

Стартап EdgeCloudLink напечатал свой первый сверхэкологичный модульный дата-центр, работающий на водородеПо сообщению Datacenter Dynamics, первый дата-центр EdgeCloudLink (ECL) емкостью 1 МВт развернут для поставщика облачных услуг Cato Digital в Маунтин-Вью, Калифорния. Строительство объекта финансировалось Molex и Hyperwise, общая сумма инвестиций составила $7 млн. В ECL заявили, что ее модульные ЦОД спроектированы с нуля для высокоплотного размещения ускорителей, спрос на которые стимулирует рост генеративных ИИ-нагрузок. При этом дата-центры ECL имеют нулевой выброс CO2. Для снижения стоимости и сроков развертывания модульные дата-центры могут быть построены с использованием 3D-принтеров. По словам CEO и основателя компании Юваля Бачара (Yuval Bachar), компания намерена печатать модульные конструкции на 3D-принтере за пределами площадки для размещения, поскольку это наиболее экологичный способ. Для более крупных проектов ECL может развернуть множество модульных ЦОД суммарной ёмкостью до 100 МВт, причём в течение всего 12 месяцев. Кроме того, компания предлагает свои решения по модели ЦОД-как-услуга, в этом случае она управляет построенным дата-центром от имени клиента. Энергия поступает от водородных топливных элементов, расположенных в каждом ЦОД. Вода, получающаяся в результате их работы, направляется на охлаждение оборудования. Используются теплообменники на задних дверях стоек (RDHx). Нагретая вода может использоваться для других нужд. Каждая стойка имеет мощность от 5 до 75 кВт, а в будущем при использовании прямого жидкостного охлаждения мощность можно довести до 125 кВт. ECL утверждает, что ее дата-центры имеют PUE 1,05 и могут быть развернуты практически в любом месте. ВОЛС-подключение при необходимости компания берёт на себя. Также отмечается, что ЦОД ECL имеют низкий уровень шума.

Источник изображения: ECL Критики дата-центров, работающих на водороде, говорят, что они не так уж эффективны, поскольку сейчас добывать водород экономически выгоднее с использованием ископаемого топлива, так что итоговая экологичность подобных проектов находится под вопросом. Тем не менее, ECL намерена в течение года с небольшим развернуть 100–150 МВт для своих заказчиков, уточняет Fierce Network. По словам компании, её решения могут быть на треть и более дешевле в сравнении с традиционными дата-центрами.

12.07.2022 [00:28], Игорь Осколков

Суперкомпьютер в дорогу: РСК показала на Иннопроме обновлённый мобильный ЦОДГруппа компаний РСК, ведущий российский разработчик суперкомпьютеров и систем для высокопроизводительных вычислений (HPC), дата-центров, облачных платформ и систем хранения данных (СХД) показала на выставке Иннопром-2022 обновлённую версию своей платформы для автономных периферийных вычислений, которая позволяет оперативно, в течение часа силами двух человек, развернуть HPC-кластер практически в любом месте. Решение упаковано в несколько контейнеров (0,7 × 0,7 × 1,1 м), которые можно транспортировать независимо друг от друга и собирать уже на месте. Один контейнер вмещает собственно вычислительную часть, второй — полностью интегрированный модуль распределения теплоносителя с узлом управления, а третий, опциональный — ИБП с инвертором. Дополняет их компактный внешний модуль охлаждения. Вся система имеет весьма солидный запас по возможности отвода тепла — до 60 кВт. Правда, сейчас столько и не требуется. Вычислительный блок фактически является уменьшенной копией платформы «РСК Торнадо»: 2 колонны по 10 слотов. Поэтому мобильная платформа позволяет совмещать в одной системе серверы «Торнадо» с процессорами x86-64 (AMD EPYC и Intel Xeon) и «Эльбрус» (сейчас 8С/8СВ, в перспективе 16С) с любым уровнем TDP, GPGPU-серверы (по два PCIe-ускорителя на сервер, без ограничений по TDP) и серверы хранения (до 12 × M.2 All-Flash). В текущем варианте платформы каждый слот рассчитан на 2 кВт тепловой нагрузки (и столько же по питанию), хотя нынешние серверы укладываются в среднем в 700–800 Вт, а серверы следующего поколения потребуют чуть больше 1 кВт. Подсистема питания имеет два домена, по одному на колонну, и требует однофазный ввод AC 230 В/50 Гц, хотя фактически может работать в диапазоне 105–280 В. Запитать систему можно от генератора, а подстраховать — ИБП. Но возможно и специсполнение с поддержкой 48 В DC. Сетевая подсистема может быть представлена ToR-коммутаторами как двойной (на обе колонны) ширины, так и одиночной. В том числе есть варианты с жидкостным охлаждением. Доступен даже InfiniBand — у Mellanox есть коммутаторы в подходящем форм-факторе, рассчитанные на промышленное применение. Также предоставляется 1 GbE-коммутатор для развёртывания служебной сети. Самая интересная часть — это охлаждение. Как и в «большой» версии платформы здесь используется фирменная СЖО, которая покрывает все компоненты серверов, так что вычислительная часть не требует активного воздушного охлаждения и способна работать даже с закрытыми крышками контейнера. Защиты по какому-либо классу IP в стандартном варианте не предусмотрено, но опять-таки по заказу возможно специсполнение. СЖО всё так же поддерживает охлаждение горячей водой, причём на всех компонентах температура не превышает +45 °C. Для запуска вычислительного модуля необходимо, чтобы он находился в помещении с плюсовой температурой и чтобы не было образования конденсата. А вот внешний контур охлаждения менее прихотлив и способен работать при температурах от -65 °C. Верхний же предел — не менее +40 °C. Требования по питанию у него те же, что и у серверов. Узел управления автоматически отслеживает и регулирует параметры всех компонентов системы во время запуска и работы. По умолчанию используется сценарий защиты оборудования, так что при неблагоприятных условиях серверы могут выключаться. Но возможны и другие сценарии, например, «работа до последнего», когда потеря данных оказывается дороже потери оборудования. Управляется мобильная платформа фирменной системой оркестрации «РСК БазИС», которая позволяет задействовать все возможности компонуемой, программно определяемой инфраструктуры, в том числе для реализации HCI-платформы. «РСК БазИС» предлагает GUI, CLI, открытые API и SDK для интеграции с другими приложениями. Таким образом, заказчик получает полностью интегрированное программно-аппаратное решение, готовое к быстрому развёртыванию и использованию. Изначально платформа создавалась для нужд добывающего сектора, но этой сферой её возможности не ограничиваются. Она также подходит для научных экспедиций и промышленных предприятий (срочная обработка больших массивов данных), медиасферы и обслуживания массовых мероприятий (рендеринг, стриминг с множества камер) и т.д. В общем, везде, где на время требуется действительно мощная, но компактная и удобная в доставке, развёртывании и эксплуатации вычислительная платформа.

26.03.2022 [00:48], Владимир Агапов

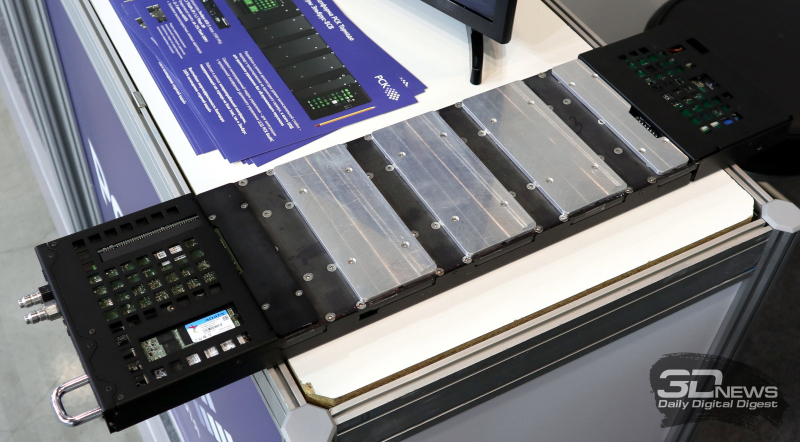

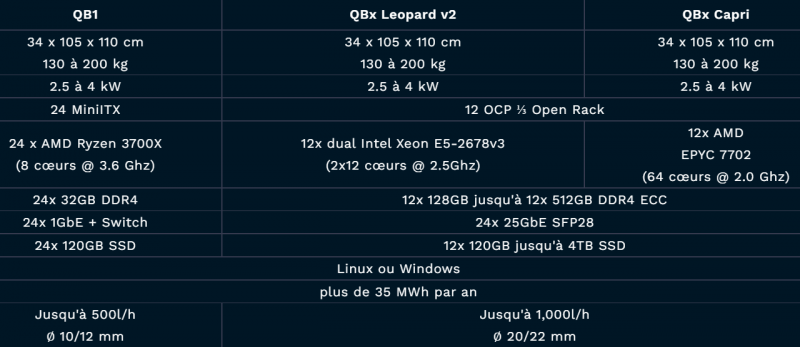

Микро-ЦОД вместо котельной — Qarnot предложила отапливать дома б/у серверами«Зелёная» экономика, переход на которую стремится осуществить всё больше стран, требует радикального сокращения вредного воздействия техносферы на окружающую среду. Один из эффективных способов достижения этой задачи связан с включением в полезный оборот побочных продуктов экономической деятельности. В случае дата-центров таким продуктом является тепло. Великобритания, Дания и другие страны направляют тепло от ЦОД в отопительные системы домов, а Норвегия обогревает им омаровые фермы и планирует обязать дата-центры отдавать «мусорное» тепло на общественные нужды. Французская компания Qarnot решила посмотреть на эту задачу под другим углом, разработав в 2017 г. концепцию электрообогревателя для жилых и офисных помещений на процессорах AMD и Intel. В 2018 г. Qarnot продолжила изыскания и выпустила криптообогреватель QC-1. А недавно она порадовала своих заказчиков следующим поколением отопительных устройств QB, которое создано в сотрудничестве с ITRenew. Новые модули используют OCP-серверы, которые ранее работали в дата-центрах гиперскейлеров. Оснащённые водяным охлаждением, они обогревают помещения пользователей и обеспечивают дополнительные мощности для периферийных облачных вычислений. Система отводит 96% тепла, производимого кластером серверов, которое попадает в систему циркуляции воды. IT-часть состоит из процессоров AMD EPYC/Ryzen или Intel Xeon E5 в составе OCP-платформ Leopard, Tioga Pass или Capri с показателем PUE, который, по словам разработчиков, стремится к 1,0. При этом вся система практически бесшумная, поскольку вентиляторы отсутствуют. В компании заявляют, что с февраля уже развёрнуто 12 000 ядер, и планируется довести их число до 100 000 в течении 2022 года. Среди предыдущих заказчиков систем отопления Qarnot числятся жилищные проекты во Франции и Финляндии, а также банк BNP и клиенты, занимающиеся цифровой обработкой изображений. По словам технического директора Qarnot Клемента Пеллегрини (Clement Pellegrini), QB приносит двойную пользу экологии, используя не только «мусорное» тепло, но и оборудование, которое обычно утилизируется. У ITRenew уже есть очень похожий совместный проект с Blockheating по обогреву теплиц такими же б/у серверами гиперскейлеров. |

|