Американская компания Cloudflare, предоставляющая услуги CDN, по сообщению Datacenter Dynamics, будет использовать ускорители NVIDIA в своей глобальной edge-сети для обработки ресурсоёмких нагрузок ИИ, в частности, больших языковых моделей (LLM). Как отмечает ресурс NetworkWorld, инициатива носит название Workers AI. Заказчики смогут получать доступ к мощностям устройств NVIDIA для реализации своих ИИ-проектов.

Cloudflare также задействует коммутаторы NVIDIA Ethernet и полный набор софта NVIDIA для инференса, включая TensorRT-LLM и Triton Inference. Поначалу не планируется поддержка пользовательских ИИ-моделей: клиентам будет предоставляться доступ только к Meta✴ Llama 2 7B и M2m100-1.2, OpenAI Whisper, Hugging Face Distilbert-sst-2-int8, Microsoft Resnet-50 и Baai bge-base-en-v1.5. В будущем этот перечень планируется расширять.

О моделях ускорителей, которые возьмёт на вооружение Cloudflare, ничего не говорится. Но отмечается, что к концу 2023 года решения NVIDIA будут внедрены более чем в 100 городах, а в течение 2024-го они появятся почти во всех зонах присутствия Cloudflare. Глобальная edge-сеть компании использует ЦОД более чем в 300 городах по всему миру.

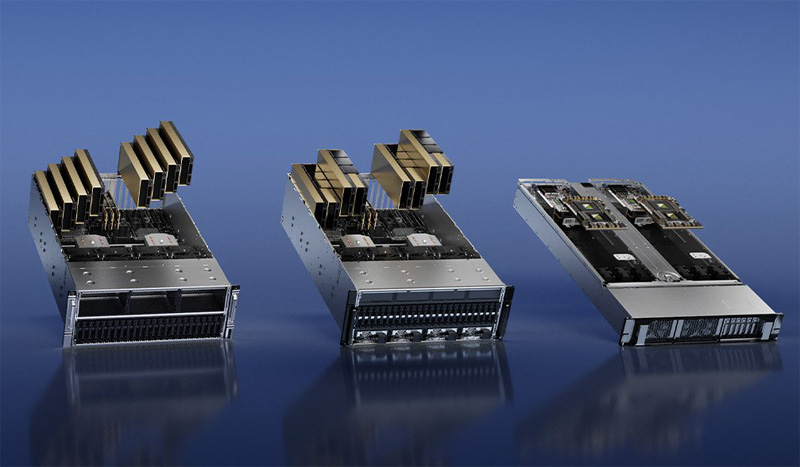

Источник изображения: NVIDIA

Ещё одной новой инициативой Cloudflare в области ИИ является Vectorize — векторная база данных. Она поможет разработчикам создавать приложения на основе ИИ полностью на платформе Cloudflare. Говорится, что Vectorize получит интеграцию с Workers AI. Наконец, готовится AI Gateway — система оптимизации и управления производительностью, предназначенная для работы с ИИ-приложениями, развёрнутыми в сети Cloudflare.

Источник: